美国人如何看待数据隐私——5101份针对美国人的调查报告分析

Pew研究中心的Colleen McClain、Monica Anderson等人于2023年10月18日发布了一份调查报告。2023年5月15日至5月21日,Pew研究中心调查了5101名美国成年人,该调查结果最终以性别、种族和民族、党派关系、教育程度和其他类别加权。报告总结了美国人对数据隐私的态度,分析了科技公司、人工智能技术、个人和监管对数据隐私的影响。

调查结果

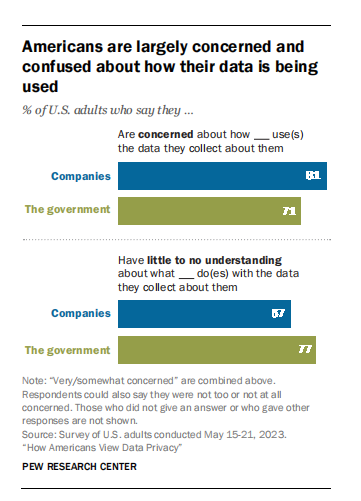

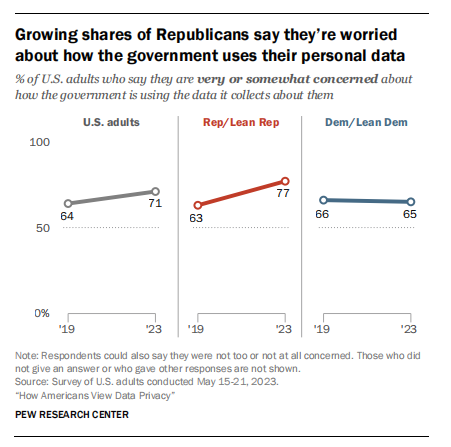

总体来看,美国人仍然对自己的个人数据感到不安,并认为他们对于个人数据如何被使用几乎没有控制权。81%的美国人对企业的数据使用行为感到不安、71%的美国人对政府的数据使用行为感到不安,这一比例相比于2019年的调查有所增加。57%的美国人对企业如何使用数据几乎没有了解,77%的美国人对政府如何使用数据几乎没有了解。共和党人对数据的担忧日益上升,民主党人的担忧程度近几年基本不变。

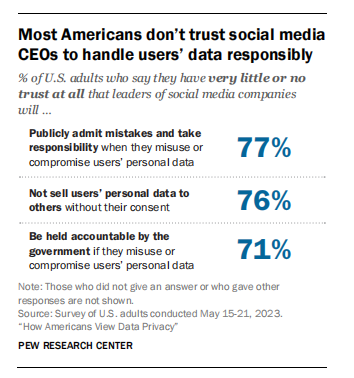

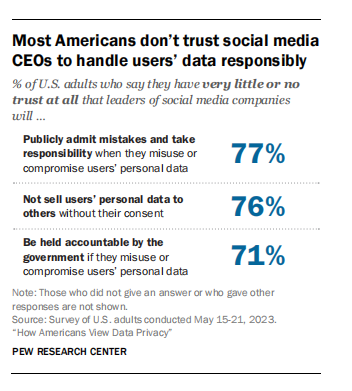

此外,美国人不相信社交媒体会负责任地处理用户隐私,77%的美国人不认为公司会公开承认他们滥用或泄露用户数据的行为,76%的人认为公司会未经用户同意将用户的个人数据出售给他人,71%的人质疑如果公司滥用或泄露用户的个人数据,政府是否将追究其责任。

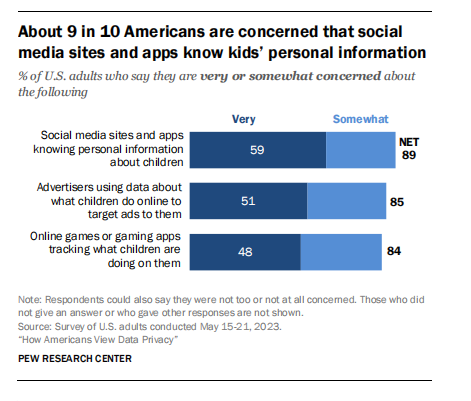

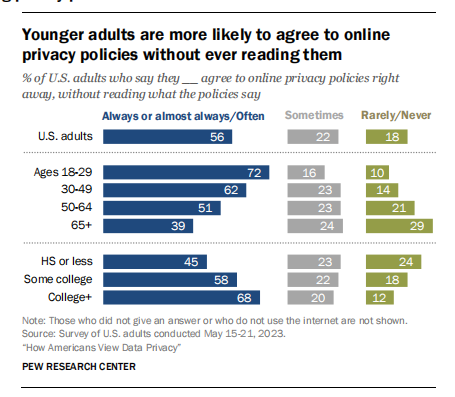

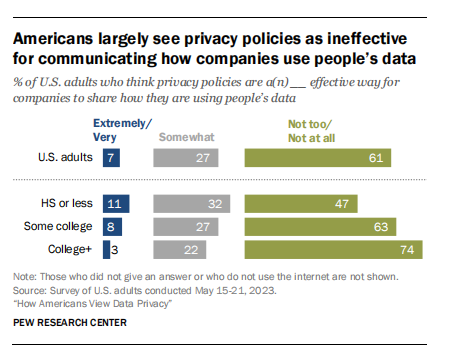

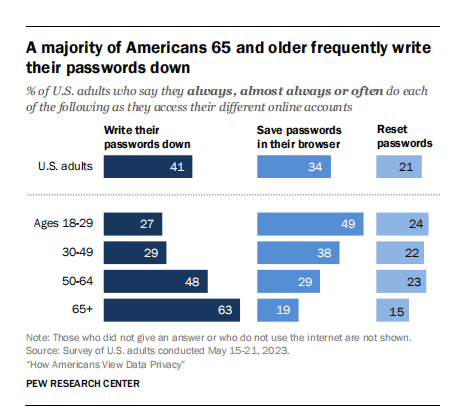

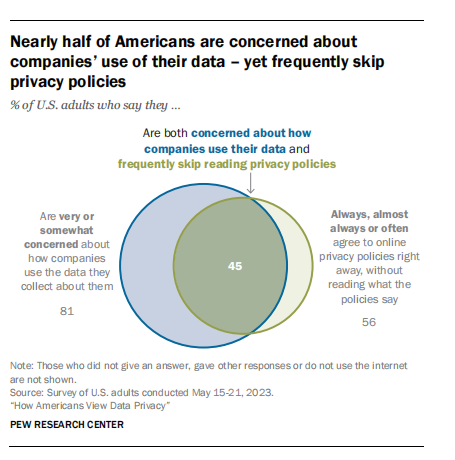

美国人非常担心儿童的网络隐私信息。约89%的人非常担心社交媒体平台、广告商和使用儿童数据的游戏应用程序知晓儿童的个人信息。尽管大多数美国人(85%)表示,父母对保护儿童的网络隐私信息负有很大责任,但59%的人认为科技公司负有责任,46%的人认为政府负有责任。针对政府监管力度的问题,两党都支持对公司如何处理人们的数据进行更多监管,只有7%的人认为应该减少监管。此外,大多数美国人完全忽略隐私政策,56%的人经常点击“同意”而没有真正阅读他们的内容,约61%的人认为隐私政策在解释公司如何使用数据方面无效。密码管理方面,约41%的美国人选择自行记录自己的密码,34%的人选择把密码存储在浏览器中,而使用密码管理器的人已从2019年的20%上升到今天的32%。

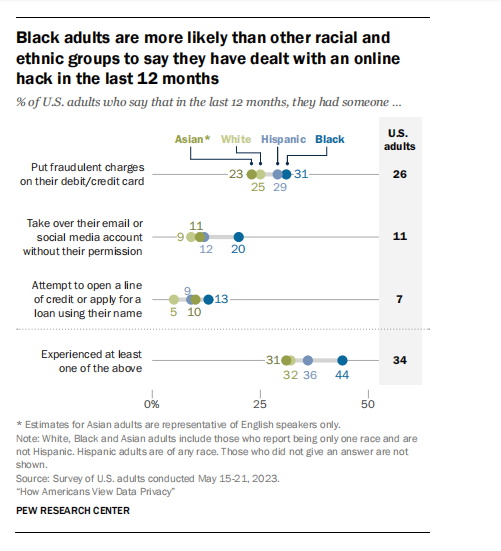

调查显示,美国目前的数据泄露风险很高。在过去12个月里,大约四分之一的美国人(26%)在借记卡或信用卡上收到了欺诈性收费。11%的人的电子邮件或社交媒体账户被盗用,7%的人曾被冒名以自己的名义开立信贷额度或申请贷款。总的来说,34%的人在过去一年中至少经历过一件数据泄露。

为了深入分析美国人对数据隐私的看法,本报告主要讨论了三个问题。第一,有关数据隐私风险、个人数据和数字隐私法律的讨论(第1章);第二,美国人如何保护他们的在线数据(第2章);第三,深入探讨在线隐私政策选择问题(第3章)。

有关数据隐私风险、个人数据和数字隐私法律的讨论

本章考察了美国人对执法部门的数据访问、政府监管以及公司可以收集哪些信息的问题讨论,并分析了不同群体对上述问题的不同看法。

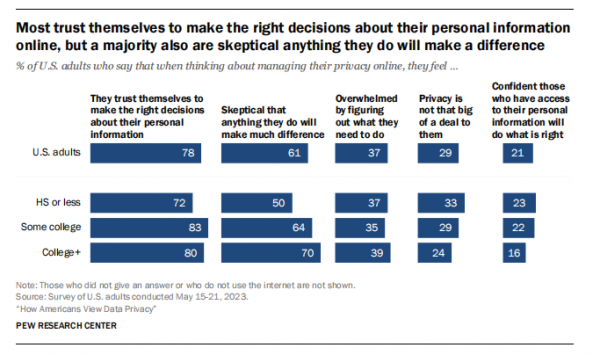

大多数美国人表示,他们相信自己会对个人信息做出正确的决定(78%),也有人认为他们并不在意隐私问题(29%),仅有21%的人相信企业会正确访问和使用个人信息。

拥有大学文凭的人中81%的人表示,他们相信自己会在网上对个人信息做出正确的决定,而在拥有高中文凭或以下学历的人中,这一比例为72%。该调查还探讨了人们对数据安全性的担忧,特别是公司在不知情的情况下将信息出售给他人、他人盗用自己的身份信息、执法部门监控他们在网上的行为三种情况。42%的美国人担心公司将在个人不知情的情况下将信息出售给他人,38%的人担心身份被盗窃,而担心执法部门监控的人最少,占15%。这一比例在西班牙裔、黑人或亚裔成年人中更高,大约一半的西班牙裔、黑人或亚裔成年人非常担心有人窃取他们的身份信息,而白人成年人中只有三分之一担心该问题。

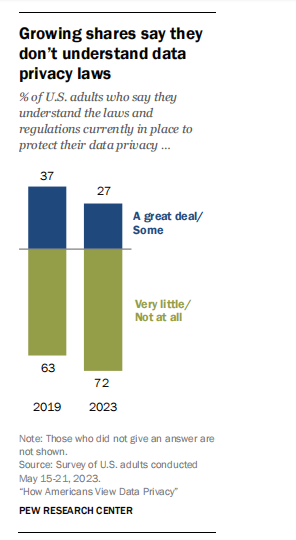

72%的美国人表示,他们对目前的数据隐私法律法规几乎一无所知,2019年这一比例为63%。美国人普遍赞成加强监管以保护个人信息(72%),该结果基本与2019年的调查结果持平。大多数美国人不相信社交媒体公司会负责任地处理用户的数据,46%的人表示他们认为社交媒体公司会随意出售用户的数据。

担心儿童数据被不当使用的比例非常高,89%的人担心社交媒体网站知道儿童的个人信息,85%的人担心广告商使用儿童的数据向他们投放广告,84%的人担心企业追踪儿童的信息。

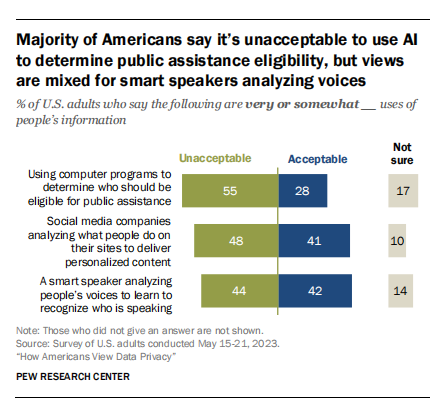

人工智能可以用来收集和分析人们的个人信息,部分美国人对公司使用人工智能的行为持谨慎态度。55%的人表示,使用计算机程序来确定谁有资格获得公共援助是不可接受的。大约一半(48%)的人认为社交媒体分析用户的情况,以推送个性化内容是不可接受的。涉及到人工智能利用话筒分析人声时,人们看法褒贬。从统计数据来看,44%的人认为这是不可接受,42%的人认为是可接受的。10%到17%的美国人不确定上述用途是否可以接受。

对于使用人工智能技术的公司,70%的人表示他们不相信公司会对人工智能的使用做出负责任的决定。关于使用人工智能分析个人信息可以让生活更便利的说法,人们的看法较为复杂,62%的人认为这种便利会实际发生,50岁以下的成年人比50岁及以上的人更乐观。

美国人如何保护他们的在线数据

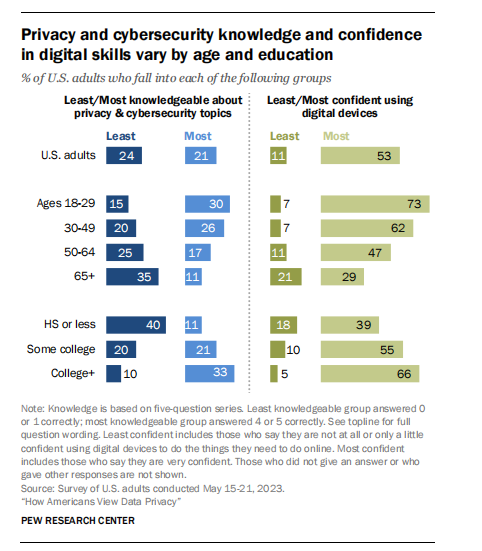

本章讨论了美国人对隐私政策、密码和网络安全的看法。在某些情况下,这些观点和经历因年龄、教育水平、种族而异。

这项调查首先揭示了人们关于隐私政策的几个关键见解,其一,人们经常跳过阅读隐私政策。约56%的美国人表示,他们总是、几乎总是或经常在没有阅读隐私政策的情况下立即点击同意,22%的人表示他们有时不会阅读,18%的人表示他们会在阅读隐私政策的基础上选择同意。其中,年轻人更有可能不经阅读便点击同意。其二,人们普遍认为隐私政策无效。61%的人认为隐私政策在了解公司如何使用人们的数据方面效果不大或根本无效。拥有学士学位及以上的人中,74%的人表示隐私政策效果不大或根本无效。有一定大学经历的人中这一比例降至63%,而在拥有高中文凭或以下的人中这一比例更低(47%)。

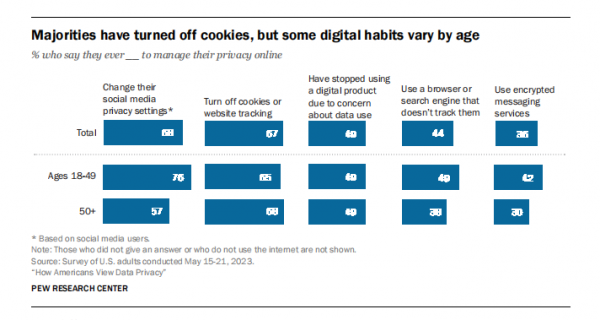

该调查还探讨了人们可以做些什么来更好地控制自己的个人隐私。68%的社交媒体用户表示,他们已经更改了社交媒体的隐私设置,以此来管理自己的在线隐私数据。同样比例的美国成年人(68%)表示,他们拒绝了网站上的cookie或其他跟踪功能。44%的人表示,他们已经停止使用部分数字设备,因为他们担心自己的个人信息被不当使用。44%的人不允许浏览器跟踪他们的操作,36%的人使用了加密的消息应用程序。并且年轻人在与隐私相关的设置上更为谨慎。

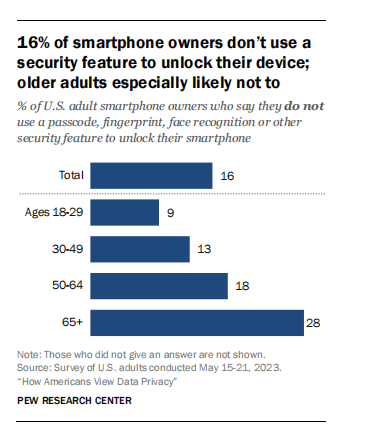

从密码到指纹再到人脸识别,美国人访问智能手机的方式多年来一直在演变。调查显示,大多数智能手机用户(83%)表示,他们会采取密码、指纹、人脸识别等安全功能保护自己的移动设备。但16%的人完全放弃了安全功能,他们从不使用密码、指纹或人脸识别等安全功能解锁手机。

针对密码过载问题,69%的人表示他们认为需要记录的密码数量过多。与此同时,45%的人表示他们并不确定自己的密码是否足够强大和安全。为了处理这一问题,该调查研究了三种不同的密码管理策略:手动记下密码、将密码保存在浏览器中和重置密码。约41%的美国人表示他们总是手动写下密码,较少的人表示他们会将密码保存在浏览器中或经常重置密码,而越来越多的美国人使用数字化工具来追踪他们的密码,使用密码管理器的美国人比例已从2019年的20%上升到2023年的32%。

针对数据泄露和黑客攻击问题,调查显示在过去12个月中,26%的美国人在借记卡或信用卡上收到了欺诈性收费,11%的人表示有人未经许可使用了他们的电子邮件或社交媒体账户,7%的人表示有人试图用他们的名义开立信贷额度或申请贷款。总的来说,34%的人在过去一年中至少经历过一次攻击行为,其中黑人收到数据泄露或黑客攻击的比例整体更高。

深入探讨在线隐私政策选择问题

企业往往通过发送隐私政策的方式达到合规要求,该报告探讨了三件可能影响用户隐私选择的情况,并据此划分出留个关键群体:

-

对隐私和网络安全最了解的人与最不了解的人。

-

对自己的隐私保护技术最自信与最不自信的人。

-

最关心和最不关心公司处理员工数据的人。

在知识水平与隐私保护的关系中,知道很多相关知识的人与知之甚少的人相比更有可能采取行动保护自己的数据。然而,知识也会滋生怀疑,富有知识的人往往不太相信访问他们数据的人会做正确的事情。信心也与人们对网络隐私的行为和感受有关。对自己的隐私保护技能最有信心的美国人更有可能采用密码管理器等新事物,在使用过程中也较少感到不知所措,而不自信的人往往选择拒绝网站上的cookie或其他跟踪。但怀疑论普遍存在于不同自信水平的人群中,人们普遍性的怀疑自己做的事情是否会产生实际影响。

对公司数据收集行为的担忧往往导致更保守的选择,如停止使用数字设备、拒绝使用cookie、使用私人浏览器或更改社交媒体隐私设置等。但其中有一半的人表示不知道自己应当如何管理自己的隐私。同时他们经常在不阅读隐私政策的情况下同意隐私政策。

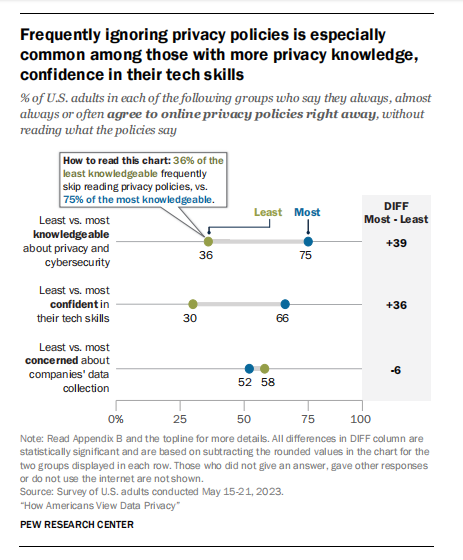

经常忽视隐私政策在对自己的隐私知识和保护技能更有信心的人中尤其常见,四分之三的人表示他们经常在不阅读隐私政策的情况下点击“同意”。18至29岁人群中约84%的人经常跳过隐私政策,30岁至49岁的人群中约75%的人不阅读隐私政策,在50岁至64岁人群中这一比例为70%,在65岁及以上的人群中这一比例进一步下降到59%。

最后,报告附上了调查问卷的具体结果数据,以及分析问卷数据的具体方法。

好文章,需要你的鼓励

浙大、港科大等联合机构告诉你:AI学“看“3D场景,到底该怎样聪明地“选角度“?

这项联合研究提出了COVER方法和CM-EVS数据集,用贪心算法从3D场景中智能筛选全景视角,每场景仅需25帧即可完整覆盖室内场景,并附完整溯源日志。

芬兰计划扩大小型核能区域供热应用规模

芬兰能源公司Steady Energy与于韦斯屈莱市能源集团Alva签署意向书,拟研究小型核电作为该市区域供热来源的可行性。计划部署2至6台LDR-50反应堆,可提供100至300兆瓦热能。双方将启动为期一年的预研,涵盖监管、居民意见、选址、技术及成本等多方面评估。LDR-50是全球设计最简单的小型供热核反应堆,建于地下,建设周期约4至5年。

伦敦大学学院等多机构联合揭示:AI“调音旋钮“让大模型推理训练不再崩溃

HolderPO通过引入可调参数p的霍尔德均值替代固定的算术平均,解决了大模型推理训练中信号放大与稳定性之间的根本矛盾,配合动态退火策略在数学推理和代理任务上均创造了新的最优记录。