日本《人工智能运营商指南(草案)》解读

2024年1月19日,日本内务和通信部(MIC)与经济、贸易和工业部(METI)发布了《人工智能运营商指南(草案)》(以下简称“指南草案”),并面向公众征集意见。指南草案旨在应对以生成式人工智能为首的技术变化,通过整合更新现有的《面向国际讨论的人工智能开发指南》《人工智能活用指南》《实施人工智能原则的治理指南》,为人工智能开发人员、提供商和业务用户提供统一的人工智能治理指导原则,以促进人工智能的安全使用;指南草案内容总共分为五部分,第一部分题目为“什么是人工智能”,旨在以用语定义的介绍为核心,帮助读者更好理解关键术语;第二部分题目为“借助人工智能实现的社会愿景以及各行为主体应采取的事项”,细分“A.基本理念B.原则C.共同准则D.高级人工智能系统运营商的共同准则E.人工智能治理的构建”五个子命题;第三部分至第五部分分别就人工智能研发者、人工智能提供者、人工智能使用者(即人工智能业务用户)的行为准则进行规定。本文旨在对于指南草案的撰写背景、原则理念、具体规范作以综述,以期为我国相应规制提供动向参考。

撰写背景

指南草案指出,伴随着人工智能(Artificial Intelligence,以下多简称为“AI”)技术尤其是生成式人工智能的飞速发展,企业的商业模式发生迅猛变化,个人的生产力也得到巨大提升。相应地,人工智能带来的诸如知识产权侵权、信息错误、虚假信息等新风险引发多方探讨,“人工智能民主化”等概念得到重视,人工智能的治理策略成为各国政府所关注的重要问题[1]。2016年1月,日本政府在《第5期科学技术基本计划》(『第5期科学技術基本計画』)[2]中推出“Society5.0”构想,提出以物联网、大数据和人工智能为突破口打造智慧数字社会“Society5.0”,并将其作为未来日本应完成的目标社会形态;为实现“Society5.0”,2019年3月,日本内阁府发布名为《以人为中心的人工智能社会原则》(『人間中心のAI社会原則』)的文件,其中提出了七项人工智能社会原则及人工智能开发利用原则[3],以打造能够使人工智能有效且安全应用的“AI-Ready社会”。此外,日本总务省主导发布了《面向国际讨论的人工智能开发指南》(『国際的な議論のための AI 開発ガイドライン案』,2017年7月发布)《人工智能活用指南》(『AI 利活用ガイドライン~AI 利活用のためのプラクティカルリファレンス~』,2019年8月发布),经济产业省主导发布了《实施人工智能原则的治理指南》(『AI 原則実践のためのガバナンス?ガイドラインVer. 1.1』,2022年1月发布)等系列文件(以下简称“系列文件”),为人工智能治理提供支撑。

2023年12月,日本首相岸田文雄在第七届人工智能战略会议上表示“我在G7广岛峰会上提出的‘广岛AI进程’已经取得了重要成果,形成了国际首个旨在应对人工智能风险的政策框架。”“英国和美国已经成立了AI安全研究机构。日本也将与这些机构合作,在2024年1月之前设立一个AI安全研究所,旨在研究AI安全评估方法并制定相关标准。”“基于广岛AI进程协议,我们将为包括AI开发者、提供者和使用者在内的所有相关方制定业务指南,作为国内规则。[4]”上述讲话反映了日本“为了实现可信赖的AI,正在主导推进规则的制定”的决心。本次指南草案,正是日本总务省与经济产业省在广岛AI进程协议框架下,考虑国外AI治理动向与AI成熟度对应的风险趋势,基于《以人为中心的人工智能社会原则》,整理统合系列文件所得。

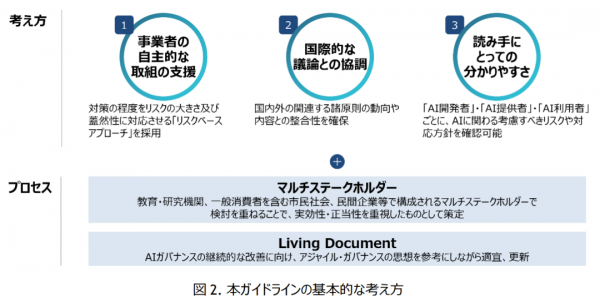

图1 指南草案第5页所列出的撰写思路过程

原则与理念

指南草案第二部分记述了“A.基本理念(即应借助AI实现的社会愿景)”、“B.原则(即为实现上述社会愿景各主体应遵循的基本原则)”、“C.共同准则(即由B.原则部分衍生出的内容)”。此外,指南草案还介绍了“D.高级人工智能系统运营商的共同准则(即高级人工智能系统运营商应遵循的原则理念)”与“E.人工智能治理的构建”。指南草案指出,“E.人工智能治理的构建”这一板块的内容,对于实现“C.共同准则”,安全可靠地利用人工智能非常重要。细分各板块内容如下所示:

“A.基本理念”强调其构想基于人工智能服务于实现“Society5.0”社会形态与将人工智能作为人类的公共产品加以利用,通过真正的创新,实现社会状态的质变和全球可持续发展之愿景[5],提出三种价值观,并指出“应建立一个追求实现这些价值观的社会”;三种价值观分别为:尊重个人人格尊严的社会(Dignity)、多元化的人能自由追求多元幸福的社会(Diversity and Inclusion)、可持续的社会(Sustainability)。指南草案指出,上述“基本理念”应作为日本国内立法及多边框架协议的大方向而得到尊重。

“B.原则”基于《以人为中心的人工智能社会原则》,参考OECD的AI原则等域外相关类似原则重新构建而成。指南草案指出,为了实现“A.基本理念”,需要各行为主体在遵循上述基本理念前提下采取相应行动。为此,将各行为主体所考虑的“原则”整理为各行为主体所应采取的行动和应与社会合作完成的行动。“各行为主体所应采取的行动”重点包括:以人为本(人間中心)、确保安全和公平(安全性?公平性といった価値を確保する)、隐私保护(プライバシー保護)、提高透明度(透明性を向上させ)、履行问责制(アカウンタビリティを果たす);“应与社会合作完成的行动”重点包括:提供提升公众教育水平和素养的机会(教育?リテラシー確保の機会を提供する)、确保公平竞争(公正競争の確保)、促进创新(イノベーションの促進)。

“C.共同准则”包括十项,分别为“以人为本”“安全性(侧重于个人生命、身体、财产、精神等关怀)”“公平性”“隐私保护”“安全保障(侧重于网络安全和数据安全)”“透明度”“问责制”“(提升)教育·素养”“确保公平竞争”“创新”。指南草案列出了这十项准则下的各项细分内容和有关主体的相关行动。指南草案提出,各行为主体应根据“以人为本”原则建立人工智能系统,以建立尊重法治、人权、民主、多样性、公平公正的社会为宗旨,开发·提供·利用人工智能系统服务;此外,各行为主体应遵守宪法、知识产权法、个人信息保护法、与AI相关的现有法令等,并对国际准则加以留意。本文谨以“以人为本”“透明度”两项准则为例,展示指南草案就其所讨论的各项细分事项:

(一)“以人为本”

“以人为本”强调各行为主体都应确保人工智能系统和服务的研发、提供和使用至少不违反宪法保障或国际公认的人权,并以此为基础处理所有事项;并且各行为主体要以人工智能扩展人们能力的方式行事,使不同的人能够追求不同的福祉(well-being)[6]。“以人为本”有六项内涵:①人格尊严和个人自决(人間の尊厳と個人の自律)。②注意AI的决策、情感操控等(AI による意思決定?感情の操作等への留意)。本项指出人工智能系统和服务的研发、提供或使用不得以无理操纵人类决策、认知或其他情感为目的或前提;在研发、提供和使用人工智能系统和服务时,应采取必要措施,防范如自动化偏差等过度依赖人工智能的风险;谨防人工智能的使用助长信息茧房和价值观偏差,限制人类(包括人工智能业务用户)本应拥有的选择权;仔细考虑人工智能的输出,特别是在它们可能与具有重大社会影响的流程相关时,包括选举和社区决策[7]。③防范虚假信息等的措施。④确保多样性和包容性。⑤提供用户支持。⑥确保可持续性。

笔者以为,本次指南草案中提出的“以人为本”准则与现今前沿国家在人工智能治理方面的趋势相吻合,对我国具有一定的参考价值。人工智能初创公司OpenAI首席执行官山姆·奥特曼(Sam Altman)于2024年2月13日参加迪拜举行的世界政府峰会(WGS)时指出,人工智能领域的“社会失调”现象可能导致智能系统对社会造成巨大破坏。这正是与第二项内涵相呼应;据《日经新闻》消息,为了解决围绕 AI的虚假信息和侵权等问题,日本执政党将在2024年提议出台监管生成式AI技术的新法律[8]。这与“以人为本”第三项内涵相对照;此外,意大利隐私保护监管机构Garante日前批准了为中介招聘和人员选拔活动中的数据处理行为准则,其中明确使用自动化决策要详细释明,并要求人工干预。体现出域外部分国家对“以人为本”观念的重视。

(二)透明度

指南草案中的“透明度”要求①确保可检验性(検証可能性の確保)。②向相关利益相关方提供信息(関連するステークホルダーへの情報提供)。③合理与诚实地处理问题(合理的かつ誠実な対応)。④加强对相关利益相关方的可解释性(関連するステークホルダーへの説明可能性?解釈可能性の向上)。事实上,人工智能透明度原则被认为是人工智能核心原则之一,但是对于其如何定义在不同立法例中存在分歧。部分学者指出其核心特征在于可解释性、可开放性、可访问性等[9]。本次指南草案对“透明度”概念进行了清晰的界定,并将“可解释性”作为其细分内涵之一,这与域外的一些立法例存在出入:2019年4月,欧盟发布《人工智能道德准则》(Ethics Guidelines For Trustworthy AI),明确提出人工智能的发展方向应该是“可信赖的”,包含安全、隐私和透明度、可解释性等方面;2023年11月22日,英国议会审议的《人工智能(监管)法案》中规定了人工智能管理局在监管人工智能时必须考虑的原则,其中包括适当的透明度和可解释性。在上述文件中,可解释性与透明度是两个概念,而非前者是后者的细分内涵之一。

由上文亦可知,人工智能透明度准则在多国的AI监管文件中都有体现。其亦被部分人工智能运营商所应用于实践:谷歌于2017年开始为开源的机器学习代码发布新工具,“作为更广泛研究的一部分,满足对可解释性的政策目标”[10];IBM于2018年9月发布了云计算人工智能工具,可以向用户展示哪些主要因素影响了人工智能做出的建议,助力实现人工智能透明度;2023年,Meta在政治广告中推行人工智能披露政策,以提高透明度和真实性[11]。我国立法层面业已对人工智能透明度概念有所关注:2022年3月,中共中央办公厅、国务院办公厅印发了《关于加强科技伦理治理的意见》,强调要保持公开透明,公布科技活动相关信息时应提高透明度,做到客观真实;2023年8月15日,《生成式人工智能服务管理暂行办法》正式施行,其中第七条强调增强训练数据的真实性、准确性、客观性、多样性。笔者以为,我国可以在现有立法基础上,参照域外(含日本)针对人工智能透明度的相应诠释规定,结合国情实践进行细化修改。

相关主要主体的具体规范

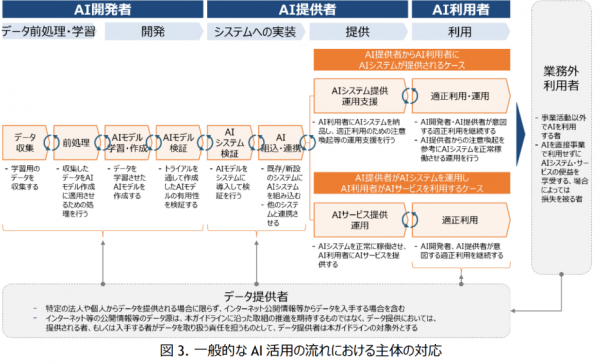

指南草案第三至五部分主要涉及对人工智能研发者、人工智能提供者、人工智能使用者(即人工智能业务用户)过程性行为准则的相关规定。具体规范内容如下所示:

(一)人工智能研发者[12]

1.AI学习过程及数据预处理阶段

人工智能研发者须保证AI学习数据的适当性(適切なデータの学習):即通过隐私设计等,适当地收集AI学习所需数据。在收集到的数据包含第三方机密信息、个人信息、知识产权等内容时,通过确保在整个AI生命周期中实施合法适当的保护措施,使得数据处理具备安全性;此外,人工智能研发者可考虑引入数据管理和限制功能。

人工智能研发者应考虑数据中包含的偏见(データに含まれるバイアスへの配慮):注意学习数据本身和AI模型的学习过程中可能包含偏见性内容,并采取适当措施以管理数据质量。考虑到无法从学习数据和AI模型的学习过程中完全消除偏见,根据需要,可基于多种方法并行而不是单一方法进行研发。

2.AI开发过程阶段

人工智能研发者须在研发时考虑人类的生命、身体、财产、精神以及环境因素(人間の生命?身体?財産、精神及び環境に配慮した開発):考虑能够满足各种环境(包括意外环境)中使用预期的性能要求,以及将风险(AI不适当地输出等)最小化的方法(如AI护栏);此外,人工智能研发者须坚持有助于AI得到合理利用的开发(適正利用に資する開発)、考虑AI模型算法中包含的偏见(AIモデルのアルゴリズム等に含まれるバイアスへの配慮)、部署安全防范机制(セキュリティ対策のための仕組みの導入)、确保AI的可解释性(検証可能性の確保)。

3.AI开发完成阶段

人工智能研发者应做到:①留意最新动向(最新動向への留意):鉴于针对人工智能系统的新攻击方法每天都在产生,为了应对这些风险,需要确认开发各工序中须留意的事项;②向利益相关者提供有关AI系统程序可能的变化、安全确保机制、为避免不可预见的风险而设定的AI使用范围、故障原因及应对状况、AI系统更新时的相关内容及更新理由等信息;③针对是否满足指南草案“C.共同准则”要求向AI提供者作出说明;④将AI系统开发过程的相关信息等文档化。

(二)人工智能提供者[13]

1.AI系统安装阶段

人工智能提供者须讨论人类生命、身体、财产、精神及环境的风险对策;研究能够满足各种环境(包括意外环境)中使用预期的性能水平,以及将风险(AI不适当地输出等)最小化的方法;人工智能提供者须确保提供的AI得到适当、有效的利用,即正确设定AI服务使用时的注意事项、在AI开发者设定的范围内充分利用AI,确保数据准确性的同时,考虑AI开发者预期的使用环境与AI使用者的实际使用环境是否存在差异等;此外,人工智能提供者须考虑AI系统·服务的结构中以及包含的数据中可能存在的偏见:在AI模型的输入输出、判断依据等方面考虑数据的公平性,定期评估参考信息、外部服务等方面的偏见;定期评估AI模型的输入输出和判断依据,监测偏见的发生;在接收AI模型输出结果的AI系统等中,考虑是否包含可能会任意限制用户判断的偏见[14];人工智能提供者还应引入隐私保护机制和措施、引入安全防范机制、将系统架构等文档化。

2.提供AI系统服务后

在这一阶段,人工智能提供者仍须确保所提供的AI得到合适、有效地利用,即定期验证人工智能系统服务的使用目的是否合理;人工智能提供者应形成防止侵犯隐私、AI脆弱性的对策、向相关利益相关者提供信息、针对是否满足指南草案“C.共同准则”要求向AI使用者作出说明、确定面向人工智能业务用户、业务外用户的服务条款(同时明示隐私政策)。

(三)人工智能业务用户

人工智能业务用户须安全、合理地使用人工智能:即遵守人工智能提供者制定的使用注意事项,在人工智能提供者设定的范围内使用;理解AI输出的精度和风险程度;在确认各种风险因素的基础上使用。此外,人工智能业务用户须留意输入数据和提示中包含的偏见。针对个人信息不当输入人工智能系统,以至于侵犯私生活的风险,人工智能业务用户应注意不要在AI系统·服务中不当输入个人信息;针对涉及AI系统·服务的隐私侵犯方面进行适当的信息收集,讨论防范措施;为应对诸多风险,人工智能业务用户须遵守人工智能提供者提供的安全注意事项。

图2 指南草案第7页列出的AI研发利用流程及相关主体

结语

2023年7月10日,国家互联网信息办公室会同国家发展和改革委员会等部委共同发布了《生成式人工智能服务管理暂行办法》(以下简称“暂行办法”),并于2023年8月15日正式实施。暂行办法立足于促进生成式人工智能健康发展和规范应用,在总则中明确了国家坚持发展和安全并重、促进创新和依法治理相结合的原则,并在技术发展与治理一章中提出了一系列鼓励措施。但除了对生成式人工智能进行专门规制之外,针对人工智能利用环节各主体的相应约束、人工智能相关准则等并未得到清晰的规定成文,日本的上述做法对我们具有参考价值。

[1] 『AI 事業者ガイドライン案』,根据「はじめに」第一段内容作概括式翻译,详见https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240119_1.pdf,最后访问日期2024年2月25日。

[2] 『第5期科学技術基本計画』,载内閣府ホーム,详见https://www8.cao.go.jp/cstp/kihonkeikaku/index5.html,最后访问日期2024年2月25日。

[3] 『人間中心のAI 社会原則』,详见https://www8.cao.go.jp/cstp/aigensoku.pdf,最后访问日期2024年2月25日。

[4] 《岸田首相出席人工智能战略会议实录》,载内阁官房内阁广报室ホームページ,详见https://www.kantei.go.jp/cn/101_kishida/actions/202312/_00029.html,最后访问日期2024年2月25日。

[5] 参照《全链条、自律性指南|日本人工智能战略委员会发布〈人工智能运营商指南(草案)〉》,载网络法实务圈,详见https://mp.weixin.qq.com/s/TQgJ9-Rshce_TR6FX6jUEw,最后访问日期2024年2月25日;根据AI 事業者ガイドライン案第十二页有所更改,详见https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240119_1.pdf。原文为:我が国が2019年3月に策定した「人間中心のAI社会原則」においては、AIがSociety 5.0の実現に貢献することが期待されている。また、AIを人類の公共財として活用し、社会の在り方の質的変化や真のイノベーションを通じて地球規模の持続可能性へとつなげることが重要であることが述べられている。そして、以下の3つの価値を「基本理念」として尊重し、「その実現を追求する社会を構築していくべき」としている。

[6] 参照《全链条、自律性指南|日本人工智能战略委员会发布〈人工智能运营商指南(草案)〉》,载网络法实务圈,详见https://mp.weixin.qq.com/s/TQgJ9-Rshce_TR6FX6jUEw,最后访问日期2024年2月25日;根据AI 事業者ガイドライン案有所更改,详见https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240119_1.pdf。

[7] 参照《全链条、自律性指南|日本人工智能战略委员会发布〈人工智能运营商指南(草案)〉》,载网络法实务圈,详见https://mp.weixin.qq.com/s/TQgJ9-Rshce_TR6FX6jUEw,最后访问日期2024年2月25日;根据AI 事業者ガイドライン案有所更改,详见https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240119_1.pdf。

[8] 《日本今年将推动AI监管立法 目标是解决虚假信息和侵权等问题》,详见https://www.techweb.com.cn/it/2024-02-16/2940920.shtml,最后访问日期2024年2月25日。

[9] 王绍源、任宇东:《人工智能自主决策系统的“透明度”伦理设计》,载《科学·经济·社会》2022年第4期,第47-58页。

[10] 《GGAI趋势 | AI透明度引发关注 科技巨头推工具解释算法决策过程》,载“高工移动机器人”公众号,详见https://mp.weixin.qq.com/s/PxOpQk8AuAGt3PTF0NMOMg,最后访问日期2024年2月25日。

[11] 《Meta在政治广告中披露人工智能的新规则》,载Marketing in Asia网站,详见https://mp.weixin.qq.com/s/axvD8UUnnaeugwe_P8ZGQQ,最后访问日期2024年2月25日。

[12] 『AI 事業者ガイドライン案』,根据「第3部 AI 開発者に関する事項」内容作概括式翻译,详见https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240119_1.pdf,最后访问日期2024年2月25日。

[13] 『AI 事業者ガイドライン案』,根据「第4部 AI 提供者に関する事項」内容作概括式翻译,详见https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20240119_1.pdf,最后访问日期2024年2月25日。

[14] 《日本发布人工智能运营商指南,AI开发者、提供者、使用者必读》,载微信公众号“ACG法实务”,详见https://mp.weixin.qq.com/s/7G_UCkJmYhpk9kiiXIubHw,最后访问日期2024年2月25日,参照原文作改动。

好文章,需要你的鼓励

Glean年收入突破3亿美元,削减AI成本成核心卖点

企业AI搜索公司Glean宣布年度经常性收入(ARR)达3亿美元,较15个月前的1亿美元增长三倍。尽管谷歌、微软、OpenAI等科技巨头纷纷入局企业AI搜索市场,Glean凭借"上下文图谱"技术深度理解企业业务需求,并帮助客户显著降低AI计算成本。该公司提供按用量计费和混合定价两种模式,客户涵盖Databricks、Reddit、Pinterest及三星等企业。Glean上轮融资后估值达72亿美元。

香港中文大学与MiniMax联手破解AI图像描述的“说多错多、说少漏多“困局

香港中文大学与MiniMax提出ClaimDiff-RL框架,将图像描述的AI训练从整体打分升级为逐条核查,有效解决了传统方式导致AI"少说保平安"的问题,同时在多项基准测试上超越Gemini-3-Pro-Preview。

蓝色起源“新格伦“火箭在佛罗里达测试中发生爆炸

杰夫·贝索斯旗下的蓝色起源公司在佛罗里达卡纳维拉尔角进行静态点火测试时,新格伦重型火箭发生爆炸。这是美国历史上最大规模的火箭爆炸之一,也是蓝色起源公司遭遇的最严重失败。所有人员安全,但该事故可能导致新格伦火箭项目长期暂停。此前该火箭已成功完成三次发射,并实现了助推器回收和重复使用。

NTU、HKU等多所顶校联手,让AI同时“多角度看片“——视频理解的并行探针革命

ParaVT是一个由南洋理工等多校联合提出的并行视频工具调用框架,通过让AI同时分析多段视频并引入PARA-GRPO算法解决训练中的格式崩溃与工具跳过问题,在六项长视频理解测试中平均提升约7.9%。