AI视频的质量,离世界顶级的渲染大赛还有多远的路?

这两天,有很多人哐哐给我发一些视频,问我是不是AI做的。

或者就是问,想用AI做成这样,要学啥。

这些视频里面的一些片段,大概是这样的:

我直接看笑了,因为太熟了。

这特娘的是第八届世界渲染大赛的作品啊。

很多人可能不知道这个比赛,但是你如果是个玩3D的人,一定都会知道。

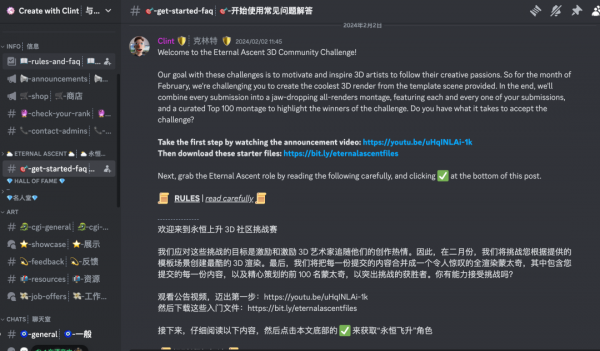

2020年底,pwnisher向广大的艺术家发起挑战(主要是疫情,闲的)。他会给出一个工程模板,然后大家按他的镜头、角色动画、背景去扩展创作自己的故事。

没想到,第一届,就收到了125个艺术家的作品参与。

这哥们就直接把大家的作品剪了一个合集。

结果就,自然而然的爆了。

因为实在是,太TM牛逼了。无论是技术、还是创意。

第二届再举办的时候,主题叫Alternate Realities(交替现实),直接收到了2400多份作品。

从此,世界3D渲染大赛,成了全世界最顶级的3D渲染赛事。

我印象中,第六届的ENDLESS ENGINES(无限引擎)应该是参与人数的巅峰,收到了4280个作品,但是能最终只能选出TOP100,入选率2.3%,也特么挺离谱的。。。

一晃三年,世界3D渲染大赛,已经举办到了第八届,这次的主题是:Eternal Ascent(无尽阶梯)。

而上面的片段,就是第八届的一些作品。

需要注意的是,这些作品并不是最终的TOP100,只是很多玩家在提交后,发出来的自己的作品,然后别人收集了一波剪辑了一下。

正式开奖日期我记得没错的话,应该是3月9号。

所以,回到文章最开始的那两个问题。

这是AI做的吗?

答:不是。

想用AI做成这样,要学啥?

答:就用AI的话,学啥你也做不出来。

世界渲染大赛的作品,倒是跟现在的AI视频有一个共性是:都只有4~5秒钟。

但是世界渲染大赛的作品,用郭帆在《流浪地球2制作手记》中的话说,叫:

无限细节。

几秒中的视频里,有脑洞、有创意、有故事、有细节、有彩蛋,埋了太多太多的点子了。

很多时候你要看个三四遍,才能把细节全部看全。

甚至背景上,很多时候也都是戏。

这需要工具本身有极高的可控性,人还有极高的想象力。

这两者我觉得缺一不可。

而可控性,从来都是AI,最薄弱的一环。人们都只看AI一键直出有多爽,但是忘了在真正的商业化交付中,可控,是至关重要的一环。

AI视频,确实在很多时候可以降低一些创作者的门槛,但是我从不来认为,这个时代就已经被瞬间颠覆了。

技术永远是一道渐变的灰。

按现在AI视频的的模型进化速度,以及可控性的进化速度,想真正冲击到一些顶级作品的时间点,我个人预估还需要2~3年时间。

甚至,需要等AI 3D的成熟。

所以,不要高估了技术的短期影响,但是也不要低估了技术的长期影响。

等待,但拥抱。

好文章,需要你的鼓励

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

无人机食品配送服务商Flytrex与全球知名披萨连锁品牌Little Caesars宣布合作,推出全新Sky2无人机,最大载重达4公斤,可一次配送两个大披萨及饮料,满足全家用餐需求。Sky2支持最远6.4公里的配送范围,平均从起飞到送达仅需4.5分钟。首个试点门店已在德克萨斯州怀利市上线,并实现与Little Caesars订单系统的直接集成。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

欧洲最大3D打印公寓楼提前数月竣工

法国社会住房项目ViliaSprint?已正式完工,成为欧洲最大的3D打印多户住宅建筑,共12套公寓,建筑面积800平方米。项目由PERI 3D Construction使用COBOD BOD2打印机完成,整体工期较传统建造缩短3个月,实际打印仅用34天(原计划50天),现场操作人员从6人减至3人,建筑废料率从10%降至5%。建筑采用可打印混凝土,集成光伏板及热泵系统,能源自给率约达60%。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。