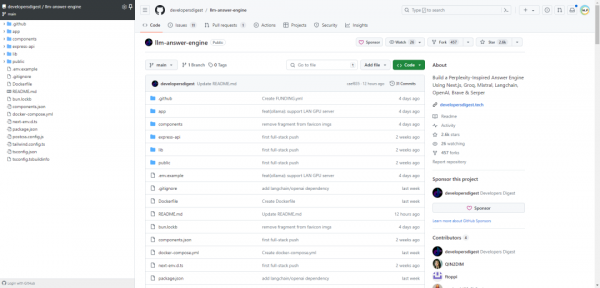

llm-answer-engine:一个Perplexity风格的回答引擎项目

llm-answer-engine是一个使用Next.js、Groq、Mixtral、Langchain、OpenAI、Brave和Serper构建的Perplexity风格的回答引擎项目。如下所示:

-

项目旨在创建一个高级回答引擎,能够有效返回基于用户查询的来源、答案、图像、视频和后续问题。

-

使用Next.js构建服务器端渲染和静态Web应用程序。

-

利用Tailwind CSS框架快速构建自定义用户界面。

-

包含Groq和Mixtral技术,用于处理和理解用户查询。

-

Langchain.JS库重点关注文本操作,如文本分割和嵌入。

-

使用Brave Search提供隐私保护的搜索引擎,获取相关内容和图像。

-

Serper API用于根据用户查询获取相关的视频和图像结果。

-

OpenAI Embeddings用于创建文本块的向量表示。

-

提供了安装和设置运行服务器的详细指南,包括获取API密钥和安装依赖。

-

遵循MIT许可证。

参考文献:

[1] https://www.developersdigest.tech/

[2] https://github.com/developersdigest/llm-answer-engine

来源:NLP工程化

好文章,需要你的鼓励

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

本期《Quick Charge》播客涵盖多个热点话题:特斯拉疑似试图删除FSD欺诈相关证据以规避巨额赔付;卡特彼勒持续推进建筑领域电气化布局;住宅太阳能30%税收抵免即将到期。此外,嘉宾Tom Pacheco就高压系统与电池技术培训展开探讨,强调电动车技术人才培养的紧迫性。节目同时提醒有意安装太阳能的用户尽快行动,可通过EnergySage平台比较多家安装商报价。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。