书生·浦语基于InternLM2模型迭代出了InternLM2.5系统

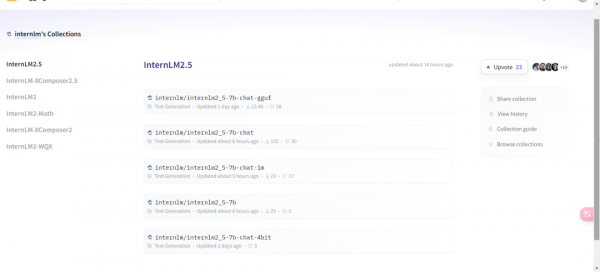

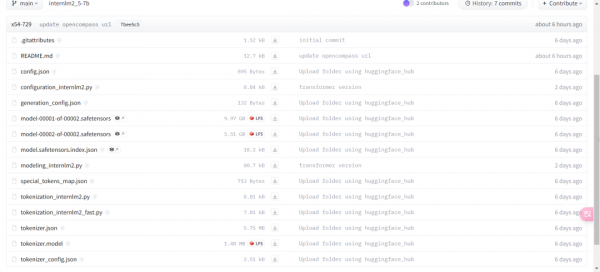

书生·浦语基于InternLM2模型迭代出了InternLM2.5系统,7B参数!模型刚刚在 huggingface 上发布。该系列包含5个模型。

-

与上一代 InternLM2 相比,推理性能提高了20%。数学推理性能超过了Llama3、Gemma2-9B等

-

在1M上下文中实现高精度的“大海捞针”,在 LongBench 和 L-Eval 评测中达到同规模模型的领先水平

-

支持从100多个网页收集信息,在指令执行、工具选择和反思方面展现了更好的工具使用能力

参考文献:

[1] https://huggingface.co/collections/internlm/internlm25-66853f32717072d17581bc13

好文章,需要你的鼓励

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

本期《Quick Charge》播客涵盖多个热点话题:特斯拉疑似试图删除FSD欺诈相关证据以规避巨额赔付;卡特彼勒持续推进建筑领域电气化布局;住宅太阳能30%税收抵免即将到期。此外,嘉宾Tom Pacheco就高压系统与电池技术培训展开探讨,强调电动车技术人才培养的紧迫性。节目同时提醒有意安装太阳能的用户尽快行动,可通过EnergySage平台比较多家安装商报价。

土耳其语AI翻译官诞生记:伊尔德兹技术大学团队用200美元造出了一个“会说土耳其话“的智能模型

伊尔德兹技术大学团队通过词典手术和离线蒸馏,以不足20美元成本打造出专为土耳其语优化的200M参数句子嵌入模型,在语义相似度任务上超越了参数量更大的原版教师模型。