大模型时代,推理的成本决定最终的胜利

移动互联网时代,谁获得用户和流量,谁就能获得成功。底层逻辑是移动互联网的系统边际成本很低。因此,“通过免费吸引客户,然后再获取收益”,成为了最典型的商业模式。

大模型时代,底层逻辑发生了很大的变化。系统的成本几乎和客户使用量成线性关系,边际成本依然很高。这里的成本绝大部分都是推理的算力消耗。

在大模型时代,谁能把推理成本降到极致,谁就能获得最终的胜利。

1 推理的成本,决定最终的胜利

- AI大模型训练相对较少,仅有屈指可数的几个大厂可以做(训练)自己的模型。而更多的公司则主要是基于开源大模型来完成自有AI推理和应用。

- 大模型应用,没有“复制”门槛。目前,大模型应用还没有规模化落地的案例,但可以确定的是,一旦有爆款的应用落地,必将有无数个类似的应用迅速出现。应用创新不是决定大模型成功的核心因素。

- 大模型时代,跟之前的移动互联网时代最大的不同在于:

- 移动互联网时代,谁获得用户和流量,谁就能获得成功。底层逻辑是移动互联网的系统边际成本很低。因此,“通过免费吸引客户,然后再获取收益”,成为了最典型的商业模式。

- 而大模型时代,底层逻辑发生了很大的变化。系统的成本几乎和客户使用量成线性关系,边际成本依然很高。这里的成本绝大部分来源是推理的算力消耗。

在大模型时代,谁能把推理成本降到极致,谁就能获得最终的胜利。

2 智算平台的选择

目前对AI智算平台的选择,简单来说,就两个:NVIDIA GPU或其他GPU/AI芯片(NVIDIA之外,统称其他)。

2.1 选择一,NVIDIA GPU

CUDA是NVIDIA GPU的计算框架,通过CUDA,可以将GPU强大的计算能力释放出来。基于NVIDIA GPU的CUDA及其所构成的生态是NVIDIA的护城河。CUDA生态,也是目前智算领域几乎独占的计算生态。

这里讲一个案例,来说明NVIDIA CUDA生态的强大。

目前流行的大模型算法基本上都是基于Transformer结构或其变种,Transformer之所以大行其道的原因,与其说是算法本身的价值,不如说是Transformer能够把GPU强大的并行计算能力充分发挥出来。Transformer具有NVIDIA GPU的亲和性,从而才能脱颖而出。

可以这样说,只有NVIDIA GPU+CUDA亲和的AI算法才有可能走出来;反过来说,如果不是NVIDIA GPU+CUDA亲和的算法,即使算法本身的优势再大,也很难被大规模的使用。

NVIDIA GPU+CUDA生态的强大能力,可见一斑!

智算中心选择NVIDIA平台的最大优势是:兼容性好。目前,主流的大模型算法都是基于NVIDIA GPU和CUDA框架开发的,开源的大模型更是如此。这样,在NVIDIA GPU平台上,开源大模型拿过来,就可以很快跑起来。

NVIDIA GPU还有一个重要的优势是场景覆盖广。不管是做AIGC、AI Agent,或者其他可能的大模型应用,都有丰富的基于NVIDIA GPU和CUDA的开源模型和开源应用等相关资源可供选择。开发者可以快速原型验证,然后在此基础上继续调优。

NVIDIA GPU场景覆盖广,既和CUDA生态相关,也跟其GPU的架构特性相关。NVIDIA GPU为GPGPU,其CUDA Core,就是尺寸较小、效率更高、可软件编程的CPU核,其Tensor Core就和CPU的协处理器是一样的效果。NVIDIA GPU具有非常好的可编程能力,能通过软件编程实现非常多的功能,覆盖尽可能多的场景。

智算中心采用NVIDIA GPU的劣势,主要是成本原因。一方面,受美国芯片禁令以及大模型刚刚兴起影响,NVIDIA GPU服务器价格水涨船高,直接推高了智算的单位算力成本。另一方面,NVIDIA足够主流,落地也足够低门槛,行业里大家都能够达到,智算中心企业也很难基于NVIDIA GPU构建自己的“巨大”成本优势以及“显著”的差异化竞争力。

2.2 选择二,其他GPU/AI芯片

2.2.1 GPU芯片和专用AI芯片

- GPU类,跟NVIDIA相同的GPGPU技术路径。

- AI专用芯片类。跟谷歌TPU类似的专用于AI的加速芯片,也称为AI-DSA。

GPU的微架构是数以千计、万计的线程核。通过超大规模的小CPU核的并行,比传统CPU的大核并行更加高效。能够在同样的能耗下,实现数量级提升的更高性能。

- 一方面AI专用芯片,把很多算法逻辑固化成电路。但AI算法更新迭代很快,旧有的固化的算法结构无法适配新型的算法,从而导致实际的性能(也即算力)利用率很低。在实际的性能方面,反而不如GPU。

- 另一方面,AI专用芯片,因为其把相对复杂的算法逻辑固化,从而导致其设计规模无法做的(相对)更大。以及多芯片互联等可扩展性问题等等,导致其在千卡、万卡集群方面的性能表现(相对)不够好。

- (国内)其他GPU芯片公司,基本都在做CUDA兼容的框架。当然,不排除有的公司两条腿走路,也有完全自研的框架。

- 而做专用AI芯片的公司,做的都是非CUDA兼容的自有框架。专用AI芯片公司“不约而同”的走自有框架,核心原因在于专用芯片算子约束更加严格,没法做到GPU级别的编程自由度。所以,不是不兼容,而是无法兼容。

目前情况下,AI算法仍然快速多变,最合适的加速方案仍然是GPU,专用AI芯片无法解决算法的横向(不同算法间的差异)和纵向(算法的迭代)差异性问题。

(扩展阅读:能不能面向通用人工智能AGI,定义一款新的AI处理器?。)

2.2.2 其他算力芯片的优劣势总结

其他的GPU/AI专用芯片和NVIDIA GPU相比,劣势主要在于其芯片、框架和生态都不够成熟,并且在性能上也有劣势,并且其场景覆盖也较少。

各方面原因,NVIDIA GPU目前相对较贵,其他这些算力芯片唯一的优势可以说是价格,也就是折算到单位算力的成本优势。

3 NVIDIA GPU和其他算力芯片的异构协同

NVIDIA GPU场景覆盖广,但单位算力成本高;其他GPU/AI算力芯片场景覆盖少,但单位算力成本低。那有没有办法把这两者的优势合并?既达到NVIDIA GPU一样的场景覆盖,又能像其它算力芯片一样低成本。

答案是肯定的。

3.1 训练和推理计算方式的差异

通俗的讲,大模型训练是很多台服务器干一件事情。训练可以理解为一个非常庞大的计算任务分解的很多分支任务在不同的服务器节点上进行计算,并且这些分支任务之间还需要紧密的通信和协同。因此,训练对计算架构的一致性,和节点间的高速互联,要求相对较高。

而大模型推理,(通过优化)可以做到一台机器干很多件事情。这样,服务器节点之间的耦合性要求降低;与此同时,对服务器节点的计算架构一致性的要求也随之降低。

- 基于混合异构协同的大模型训练优化,是一件事倍功半的事情。原因一、混合异构协同的大模型训练技术难度高;原因二,训练集群的效率和成本优化效果有限;原因三,国内大模型训练整体市场规模相对较小,高投入低收益。

- 基于混合异构协同的大模型推理优化,则是一件事半功倍的事情。原因一,混合异构协同的大模型推理技术难度相对较低;原因二,推理集群的效率和成本优化效果会非常显著;原因三,国内主要是AI大模型推理,其市场规模将远大于训练,低投入高收益。

3.2 异构协同推理

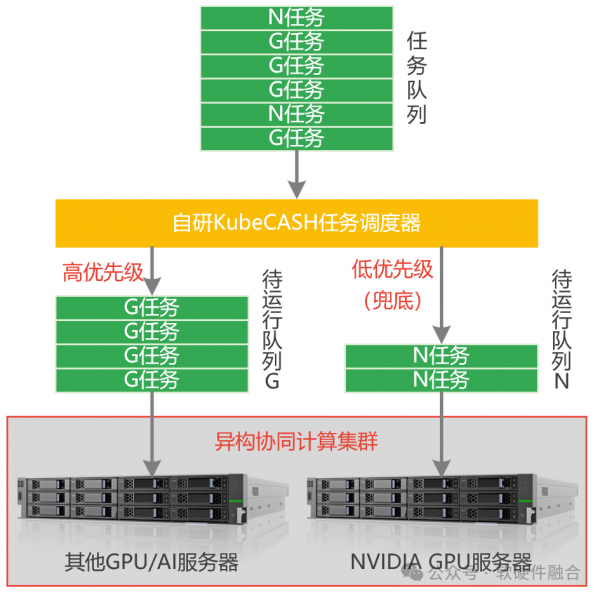

- 其他算力芯片的高优先级。也就是所有的计算任务送到集群的时候,由其他算力芯片所在的计算节点先挑选,“自己可以胜任的工作就自己做,无法胜任的工作就交给NVIDIA做”。

- NVIDIA GPU的最低优先级。其主要作用是在系统里承担“兜底”的角色,其他算力芯片挑剩下的工作任务,都统一交付到NVIDIA GPU所在的计算节点执行。

受二八定律影响,其他算力芯片覆盖的通常是热点场景,虽然其场景覆盖少,但这些场景的计算量通常会占据整体计算量的大部分。从而使得,通过异构协同的方式,能够显著的降低成本。

- 能够实现全场景覆盖(以NVIDIA GPU为基准,NV-GPU兜底,所以全场景覆盖);

- 能够最大程度降低成本(计算主力为其他GPU/AI芯片);

- 部分解决算力芯片卡脖子问题(降低NVIDIA芯片的使用量)。

4 更进一步,多元异构协同

4.1 算力芯片的类型和架构越来越多,亟需整合

在通用计算的时代,x86占据绝大部分市场,基本上不存在多样性算力平台的问题。但随着ARM CPU、RISC-v CPU的逐渐成熟,不同架构的CPU也逐渐共存于同一个算力中心。随着深度学习和大模型的流行,GPU异构计算逐渐成为主流。但NVIDIA GPU成本很高,其他品牌/架构GPU也越来越多的得到应用。此外,还有专用于AI等场合的专用加速处理器器,也开始得到重视。计算平台越来越多的呈现出多样性的特征。

站在竞争和供应链安全的角度,多样性算力是好事情,但站在基础设施和业务层软件的角度,多样性算力则是挑战。如果实现软件定义硬件,做硬件平台架构无关的软件层工作,让更多的硬件平台可以无缝接入,是亟需解决的问题。

4.2 多元异构协同的混合算力调度

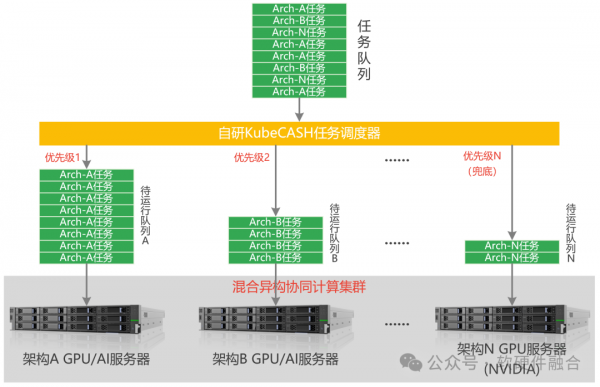

从两种计算芯片的异构协同推理开始,我们可以持续扩展,最终形成的必然是多元异构协同计算框架,从而实现多种加速芯片的混合计算,给客户提供一致性的和云边端协同调度,实现最优的算力成本。

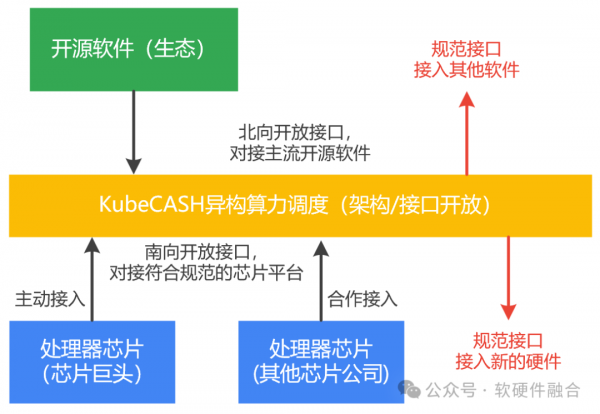

- 对上,提供开放的北向接口,对接主流的开源软件,并以开源软件为蓝本,提供开放的业务应用软件接入API规范,支持更多的客户自研软件的接入。

- 对下,提供开放的南向接口,对接主流的大厂的芯片,如x86 CPU、ARM CPU、NVIDIA GPU等。对于其他芯片公司的芯片,平台方和芯片厂家可以建立深度合作关系,把其他的GPU/AI算力芯片逐步接入。在此基础上,形成南向的接口和架构规范,从而支持更多硬件的接入。

- 对下,不需要关心芯片的各种差异性,只要有开放的算力调度平台,就可以实现各类芯片的轻松接入。这样,智算中心只关心芯片的性能和成本。

- 对上,也不需要担心智算中心的硬件是否能够匹配客户的业务场景。开放的算力调度平台决定了,能够实现对绝大部分场景的支持。

好文章,需要你的鼓励

Aqara智能门锁U400发布:支持Apple Wallet全自动解锁

绿米推出智能门锁U400,采用超宽带技术检测携带iPhone或Apple Watch的用户实现全自动解锁。该产品支持苹果钱包添加家庭钥匙,兼容Siri语音控制。除UWB解锁外,还提供实体钥匙、指纹识别、密码等多种开锁方式。基于Thread协议需配合兼容设备使用,要求iPhone 11及以上版本或Apple Watch Series 6及以上。售价270美元,现已在美国等地上市。

剑桥大学突破性研究:如何让AI在对话中学会真正的自信判断

剑桥大学研究团队首次系统探索AI在多轮对话中的信心判断问题。研究发现当前AI系统在评估自己答案可靠性方面存在严重缺陷,容易被对话长度而非信息质量误导。团队提出P(SUFFICIENT)等新方法,但整体问题仍待解决。该研究为AI在医疗、法律等关键领域的安全应用提供重要指导,强调了开发更可信AI系统的紧迫性。

AI代码编辑器扩展推荐漏洞引发供应链安全风险

热门AI驱动的VS Code衍生工具如Cursor、Windsurf等被发现推荐Open VSX注册表中不存在的扩展程序,为恶意攻击者发布同名恶意软件包创造机会。这些IDE继承了微软扩展市场的官方推荐列表,但这些扩展在Open VSX中并不存在。攻击者可利用此漏洞上传恶意扩展,当开发者安装推荐扩展时可能导致敏感数据泄露。

威斯康星大学研究团队破解洪水监测难题:AI模型终于学会了“眼观六路“

威斯康星大学研究团队开发出Prithvi-CAFE洪水监测系统,通过"双视觉协作"机制解决了AI地理基础模型在洪水识别上的局限性。该系统巧妙融合全局理解和局部细节能力,在国际标准数据集上创造最佳成绩,参数效率提升93%,为全球洪水预警和防灾减灾提供了更准确可靠的技术方案。