OpenAI首席科学家MIT演讲:揭示 o1模型训练核心秘密

前不久,OpenAI的首席科学家Hyung Won Chung在MIT的一场演讲引发了不少思考。

他揭示了一个培养通用人工智能(AGI)的关键策略:通过激励模型自主学习,才能让机器具备解决多任务的通用技能。

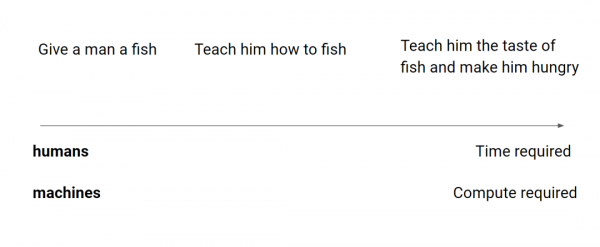

他打了一个非常形象的比喻:大家都听过“授人以鱼,不如授人以渔”

但他更进一步,

提出:“要让他知道鱼有多美味,并且让他保持饥饿”,这样他就会主动学会钓鱼。

这不仅让他学会如何获取鱼,还会激发他学习更多相关的技能,比如阅读天气、了解鱼类习性等。最重要的是,有些技能是通用的,能够应用到其他任务中。

这个类比不仅适用于人类学习,也适用于AI系统。

通过激励机制,AI模型能够在应对不同任务时,自主学习和适应环境变化。

这就是未来AI发展的核心——弱激励学习。

通用智能:让机器学会更多“钓鱼”的方法

在演讲中,Hyung Won Chung详细阐述了通用智能和专用智能的区别。

专用智能是为了特定任务设计的,就像是教人只会一种“钓鱼”方法。

而通用智能则更类似于教会机器在任何环境下灵活运用多种技巧,能应对各种未知的场景。

这种灵活性让通用智能模型能够自适应,不再需要人为教授每个具体任务。

他提出,最好的方法不是直接教模型某个技能,而是通过弱激励机制,让模型在大量的数据和任务中,自己摸索和发展出解决问题的能力。

这种自主学习的能力,是未来通用智能的关键。

计算力:AI的“精神与时间之屋”

Hyung Won Chung还提到了计算能力在AI发展中的关键作用。

他引用了一个有趣的类比:大家还记得《龙珠》里的“精神与时间之屋”吗?在那里训练一年,外界只过了一天。

对于AI来说,计算资源的扩展,让它的“训练时间”大幅缩短——相当于几天时间,它就可以在某些领域超越人类专家。

如今,计算力的指数级增长,已经让AI可以轻松做到这点。

未来,我们可以通过更多的计算资源,让AI模型在短时间内学习海量任务,从而具备超越专家的能力。

涌现能力:机器“学会”人类没教的技能

Hyung Won Chung还提到了一个有趣的现象——涌现能力。

随着模型规模的扩大,AI模型往往会自发表现出一些没有被直接教授的能力。

比如,像GPT-4这样的模型,虽然没有专门教它数学和推理,但它却能自然地表现出这些能力。

这表明,随着模型规模的扩展,机器会自动学会解决新问题的能力,这也让人类对AI的潜力充满期待。

“鱼的美味”与激励学习

Hyung Won Chung特别强调了激励结构的设计。

他认为,未来的AI训练,需要给模型设计更复杂、更有深度的激励结构。

举个例子,现在的语言模型会产生“幻觉问题”,即在没有答案时也会编造出内容。

解决这个问题的办法,就是让模型学会在不确定的情况下回答“我不知道”。

通过调整激励结构,让模型不仅追求正确答案,还要学会在面对未知时保持谨慎,这样AI的可靠性和可信度才能提高。

正如他所说:“教会模型判断自己是否知道答案,远比教它一个特定的技能更为重要。”

这种激励学习的方式,正是让AI模型具备通用能力的关键。

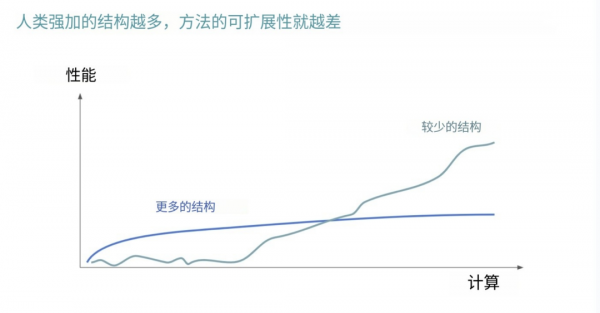

扩展:不仅仅是计算力

通常我们谈到AI的“扩展”,指的是增加更多的计算力,让模型变得更强大。

但Hyung Won Chung提出了一种更深层的扩展理念。他认为,真正的扩展不是简单地增加计算资源,而是要重新设计模型架构,消除那些限制模型进一步提升的障碍。

通过更好的设计,让AI在数据和计算资源的增加中,自动适应并提升性能。

不断“去学习”:迎接AI的快速迭代

Hyung Won Chung还提到了一个非常有意思的观点——去学习。

他解释说,随着AI的发展,研究人员需要学会不断丢掉过去的认知,适应新模型带来的新能力。

每一次新模型的推出,都会颠覆我们对AI的认知。只有保持“去学习”的心态,才能跟上AI领域的快速变化。

深思:激励是最强的驱动力

正如Hyung Won Chung所言,最有效的学习方式是通过激励驱动,这不仅适用于人类,也同样适用于AI。

通过设计精妙的激励结构,模型能够在面对各种任务时自主探索、学习,并逐渐发展出通用能力。这种自主学习的过程让AI具备了更强的适应性和解决问题的能力。

作家赫尔曼·黑塞在《悉达多》中提到的一句话:

“智者追寻的不是永恒的真理,而是一个不断学习和成长的过程。”

对于AI来说,激励机制就像这个追寻的过程,它并不依赖于直接获得某个答案,而是在大量任务中不断寻找、摸索,最终通过自我学习变得更强大。

好文章,需要你的鼓励

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

WhatsApp正式向更多iOS用户推送Liquid Glass界面重设计的第一阶段更新。此前,Meta自去年10月起在小范围内测试该设计,将其应用于底部导航栏及聊天标签页部分元素。目前,多名用户已在社交平台确认收到更新,新界面覆盖底部导航栏、聊天内部分元素及主界面顶部导航栏,但语音消息播放器和消息反应菜单等组件仍沿用旧设计,预计后续将陆续跟进更新。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

OpenAI为ChatGPT Pro推出个人财务管理新功能

OpenAI近日在ChatGPT Pro中推出个人财务功能预览版,目前面向部分美国用户开放测试。用户需通过Plaid连接银行账户,ChatGPT可接入逾12,000家银行数据,并生成支出图表、投资组合分析等可视化看板。用户可用自然语言查询财务状况、识别可取消的订阅或检测高风险股票。该功能由GPT-5.5 Thinking驱动,未来将支持自动提交信用卡申请等主动操作,并计划向所有用户开放。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。