搭建一个 AI 问答机器人,需要几步?

搭建一个企业内部AI 问答机器人、知识库的场景,我们可以选择大厂的云服务,这相对于大多数用户来说,是最省事的方案。但很多企业可能会有一些私有化的数据,或者受限于企业内部的安全性要求,只能走模型私有化部署的方式。

很多人想到模型私有化部署,会以为要数据中心的多台服务器来做,其实不然。

赞奇科技基于 NVIDIA ChatRTX 搭建的企业问答机器人

但搭建一个AI 问答机器人又是一个涉及硬件选择、安装、开发环境部署的综合过程。

最近赞奇的工程师团队测试了几款主流大模型,就采用 AI 工作站搭建一个本地问答机器人提供了一些建议参考,这里抓一些重点给大家:

第一步

确定需求与目标

这一步至关重要,需要确定以下关键点:

- 性能要求:了解所做任务的复杂度,如知识库所需要采样的数据库的大小,未来的用户并发量等,以此来预估所需的计算资源和存储空间等,通常我们可以用现有机器跑任务测试的方式来评估。

- 预算范围:明确愿意投入的资金等成本范围。对预算没有概念的小伙伴可以通过询问,或者参考公开市场价格等方式来加速了解。

第二步

选择合适的硬件

根据需求我们来制定硬件配置,AI 工作站比较关键的配置有 GPU、CPU、内存、机箱等。

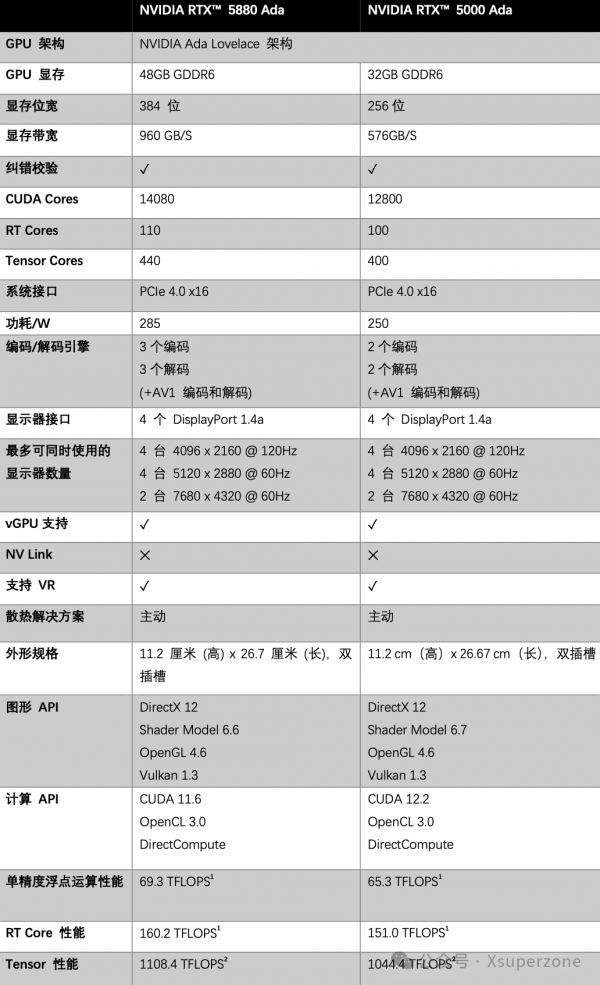

GPU

GPU 是 AI 工作站中非常核心的算力,也是 AI 工作站中需要首先考虑的配件。目前适用于专业 AI 工作站的显卡主要有 NVIDIA RTX(TM) 5880 Ada (48GB) 及 NVIDIA RTX(TM) 5000 Ada (32GB) 等,这两款显卡属于 NVIDIA 专业级显卡,主动散热、功耗很低而且非常稳定,静音也适合办公室使用。

我们可以看看两款显卡的参数:

我们需要根据算力需求来配置工作站中的显卡,包括显卡型号和数量。AI 工作站可至多支持 4 张高性能专业显卡,同时一个工作站中需要配置同一型号的显卡,并且一般采用单卡、双卡和四卡的配置。

这就需要我们同时要了解不同型号显卡的性能,才能来匹配任务需求。这是个极大的挑战。很多人对显卡性能并不熟悉,而且在不同的任务情况下,显卡的表现也会有所不同。我们可以参考与我们类似的任务在显卡上的测评数据来评估。有条件的话,在购买时建议最好提前测试下。

显卡实测数据

很多企业采用 AI 工作站来做知识库、智能问答等应用,主要任务是本地的模型微调和推理,模型大小普遍选择在 7B/8B,13B,32B 和 70B。

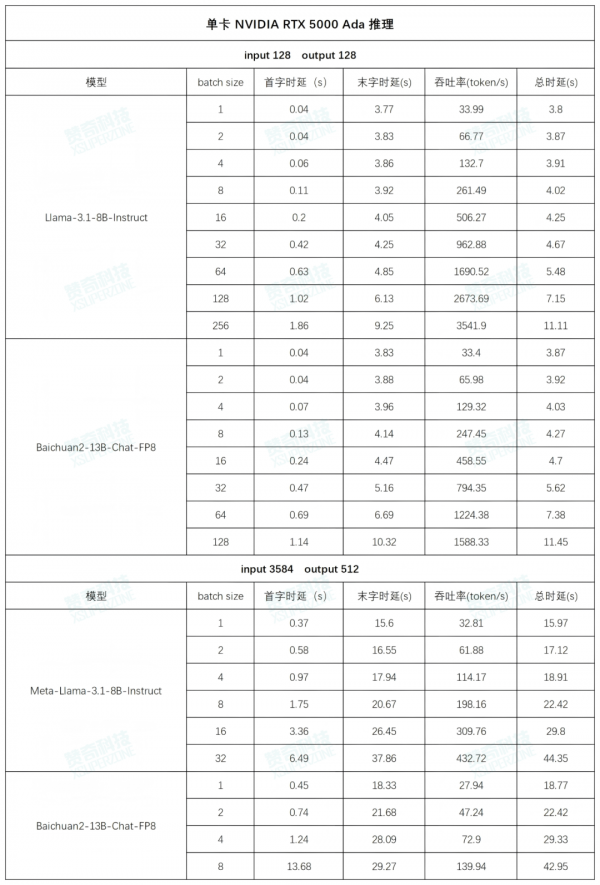

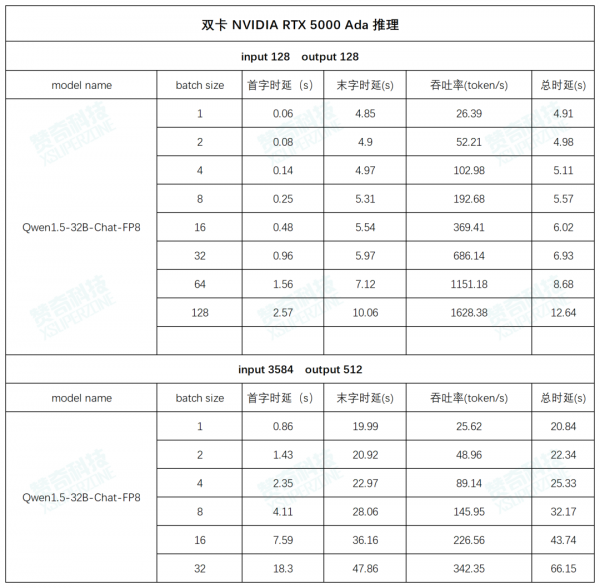

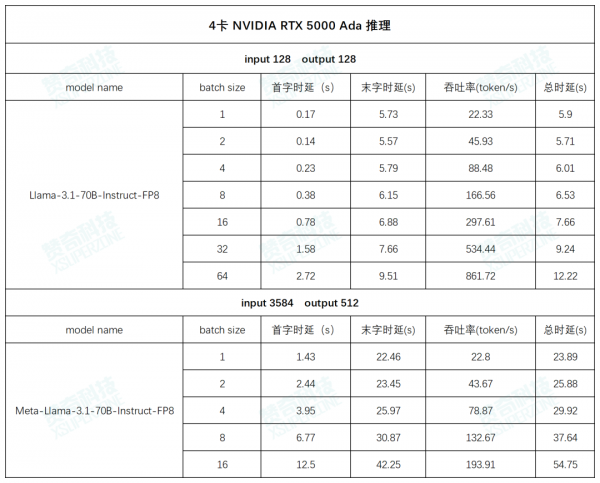

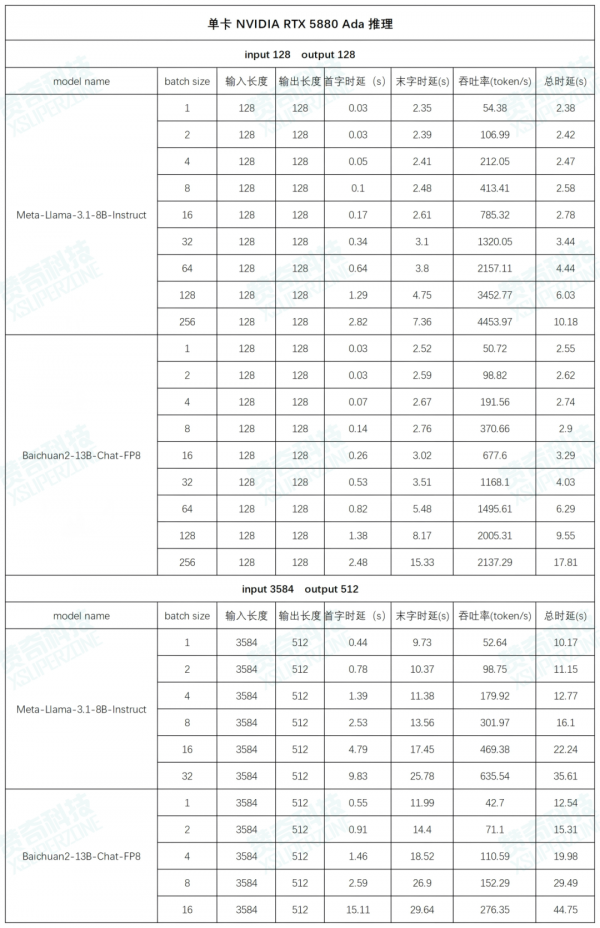

NVIDIA 解决方案合作伙伴赞奇科技,分别对 AI 工作站中搭载 NVIDIA RTX 5880 Ada、NVIDIA RTX 5000 Ada 的单卡、双卡、四卡配置进行了模型训练和推理的测试,测试数据供大家在选型时参考。

AI 工作站搭载 NVIDIA RTX 5000 Ada 的实测

NVIDIA RTX 5000 Ada

(图片源于 NVIDIA)

测试环境:

CPU: Intel(R) Xeon(R) w5-3433

内存:64G DDR5 * 8

GPU: NVIDIA RTX 5000 Ada * 4

操作系统:ubuntu22.04

Driver Version: 550.107.02

CUDA: 12.1

推理框架:vllm

测试数据(以下数据均为多次测试数据的平均值):

左右滑动查看更多测试数据

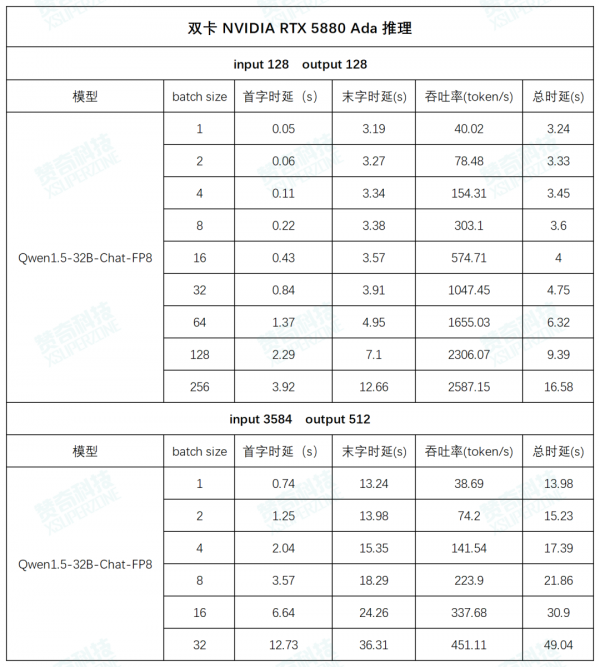

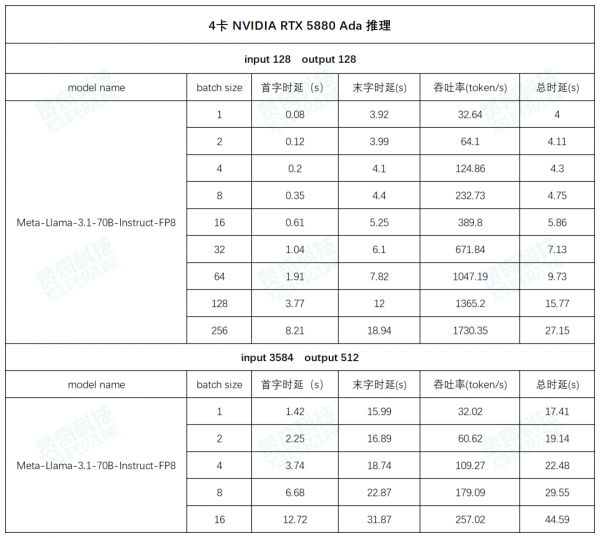

AI 工作站搭载 NVIDIA RTX 5880 Ada 的实测

NVIDIA RTX 5880 Ada

(图片源于 NVIDIA)

测试环境:

- CPU: Intel(R) Xeon(R) w5-3433

- 内存:64G DDR5 * 8

- GPU: NVIDIA RTX 5880 Ada * 4

- 操作系统:ubuntu 22.04

- Driver Version: 550.107.02

- CUDA: 12.1

- 推理框架:vllm

测试数据(以下数据均为多次测试数据的平均值):

左右滑动查看更多测试数据

噪音测试

无论是搭载 4 张 NVIDIA RTX 5880 Ada, 还是 4 张 NVIDIA RTX 5000 Ada 的品牌 AI 工作站,在压测情况下机器出风口测得的噪音水平控制在 50-60 分贝,基本上接近环境音的水平,办公室噪音?那是没有的!

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

康奈尔大学造出“会看图纸的AI设计师“:一张照片,自动还原可编辑的3D场景

康奈尔大学提出SEIG框架,让视觉语言模型通过分阶段重建几何、材质、构图和灯光,从单张图片自动生成可编辑的Blender 3D场景。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

AI会写3D建模代码了?谷歌DeepMind等机构推出首个专业评测平台,结果出人意料

谷歌DeepMind等机构推出3DCodeBench,评测12款顶级AI用代码生成3D模型的能力,揭示当前AI在几何推理上的核心短板与改进方向。