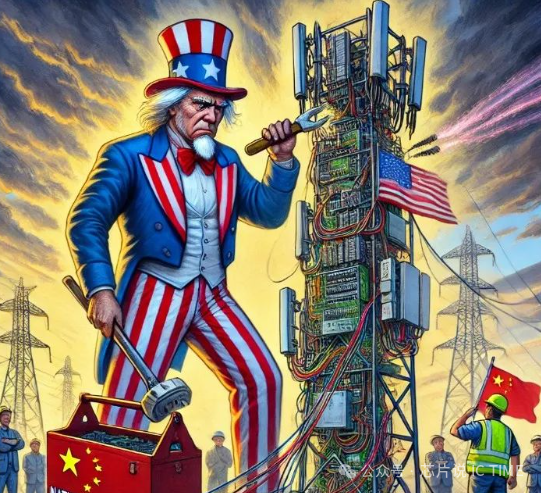

美国拟30亿美元移除中国电信设备

根据相关报道,美国众议院准备投票拨款30亿美元,用于移除中国电信设备。这一消息引起了广泛关注。这一计划源于2019年美国国会通过的一项法律,该法律要求接受联邦补贴的美国电信运营商清除其网络中的中国电信设备,主要是华为和中兴的产品。这一决定背后的主要动机是出于国家安全考虑,但实施过程却远比想象中复杂。

据美国联邦通信委员会(FCC)透露,在获得联邦支持的美国电信公司中,有近40%需要额外的政府资金来拆除中企制造的设备。设备拆除工作预计耗资高达49.8亿美元,但美国国会目前仅批准了19亿美元用于“拆除和更换”计划。这意味着,即使众议院通过拨款30亿美元,仍然存在约9.8亿美元的资金缺口。

FCC主席杰西卡·罗森沃塞尔多次呼吁国会紧急提供额外资金,并警告说,如果资金不足,参与报销计划的一些运营商可能会被迫关闭网络,这将给美国广大用户带来严重不便。特别是那些服务范围覆盖美国许多农村和偏远地区的电信公司,它们可能是这些地区唯一的移动宽带服务提供商。如果这些网络被关闭,这些地区可能会失去唯一的网络服务。

这一决策不仅涉及高昂的资金投入,还引发了对国家安全的深刻思考。美国政府为了维护自身利益,决定排斥华为、中兴等中国公司的产品,但所面临的挑战和成本也逐渐显露出来。在全球产业链日益紧密的今天,单方面禁用特定厂商的设备不仅仅是技术问题,更是牵一发而动全身的复杂议题。

此外,美国电信公司在拆除和更换设备过程中还面临新设备供应链延迟的问题。许多运营商依赖中国公司的“低成本”设备,而寻找新的设备供应商并非易事。据估计,即使资金到位,实际置换工作预计至少耗时四到五年。

美国此举不仅在国内引发争议,也在国际上引起广泛关注。中方多次对此表示不满,认为美方在没有证据的情况下滥用国家力量打压特定国家和特定企业,违背了市场经济原则。外交部发言人表示,禁止美国运营商购买华为和中兴设备,并不能真正改善美国网络安全状况,反而会对美国农村和欠发达地区的网络服务产生严重影响。

转自:半导体创芯网

好文章,需要你的鼓励

奥运级别的努力:首席信息官为2026年AI颠覆做准备

AI颠覆预计将在2026年持续,推动企业适应不断演进的技术并扩大规模。国际奥委会、Moderna和Sportradar的领导者在纽约路透社峰会上分享了他们的AI策略。讨论焦点包括自建AI与购买第三方资源的选择,AI在内部流程优化和外部产品开发中的应用,以及小型模型在日常应用中的潜力。专家建议,企业应将AI建设融入企业文化,以创新而非成本节约为驱动力。

字节跳动发布GAR:让AI能像人类一样精准理解图像任何区域的突破性技术

字节跳动等机构联合发布GAR技术,让AI能同时理解图像的全局和局部信息,实现对多个区域间复杂关系的准确分析。该技术通过RoI对齐特征重放方法,在保持全局视野的同时提取精确细节,在多项测试中表现出色,甚至在某些指标上超越了体积更大的模型,为AI视觉理解能力带来重要突破。

Spotify推出AI播放列表功能让用户掌控推荐算法

Spotify在新西兰测试推出AI提示播放列表功能,用户可通过文字描述需求让AI根据指令和听歌历史生成个性化播放列表。该功能允许用户设置定期刷新,相当于创建可控制算法的每周发现播放列表。这是Spotify赋予用户更多控制权努力的一部分,此前其AI DJ功能也增加了语音提示选项,反映了各平台让用户更好控制算法推荐的趋势。

Inclusion AI推出万亿参数思维模型Ring-1T:首个开源的超大规模推理引擎如何重塑AI思考边界

Inclusion AI团队推出首个开源万亿参数思维模型Ring-1T,通过IcePop、C3PO++和ASystem三项核心技术突破,解决了超大规模强化学习训练的稳定性和效率难题。该模型在AIME-2025获得93.4分,IMO-2025达到银牌水平,CodeForces获得2088分,展现出卓越的数学推理和编程能力,为AI推理能力发展树立了新的里程碑。