国产开源之光:DeepSeek-V3划重点

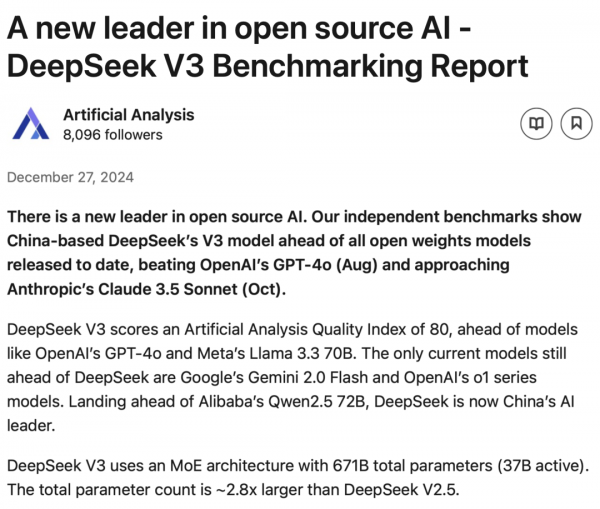

DeepSeek-V3 采用了 671B 参数 MoE 架构,配备约 37B 激活单元,训练使用14.8T Token数据。

一路走来,从一个低调、但能引起行业普遍降价的选手,到现在的国产+开源之光引发全球瞩目。最近刚刚其最新的DeepSeek-V3发布后,海内外一片刷屏。本篇就划几处重点:

一句话介绍:DeepSeek-V3 采用了 671B 参数 MoE 架构,配备约 37B 激活单元,训练使用14.8T Token数据。

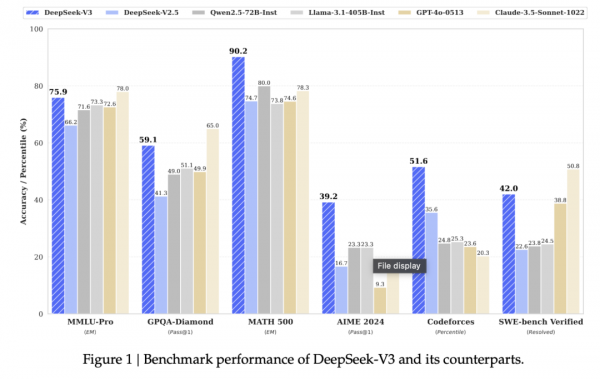

数学能力 / MATH 500、AIME 2024 等测试:显著优于 Claude 3.5 Sonnet 和 GPT-4o;

代码能力 / Codeforces: 同样优于其他主流大模型,刷新了SOTA。

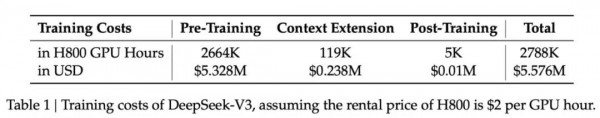

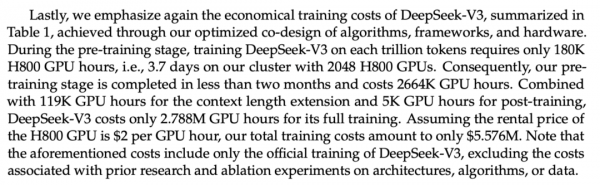

3、极佳训练成本优势:总计消耗了 278.8 万 GPU 小时。按照 NVIDIA H800 每小时 2 美元的租赁价格计算,训练成本约为 560 万美元。(相比之下,Llama 3模型的计算消耗了3930万H100小时...)

低训练成本可能是本次DeepSeek-V3在海外产生的最大反响的一点:

DeepSeek-V3的训练仅使用了2048张H800 (然而,H800 的互连带宽较低:300 GB/s,对比 H100 的 900 GB/s,这在训练过程中可能成为性能瓶颈,因为节点间的通信效率会受到影响,为此DeepSeek提出了多种优化方案,例如自主研发通信内核而非依赖张量并行,以及采用混合精度(FP8)训练等技术来提升效率。)

(搬运官方信息)通过算法和工程上的创新,DeepSeek-V3 的生成吐字速度从 20 TPS 大幅提高至 60 TPS,相比 V2.5 模型实现了 3 倍的提升,为用户带来更加迅速流畅的使用体验。

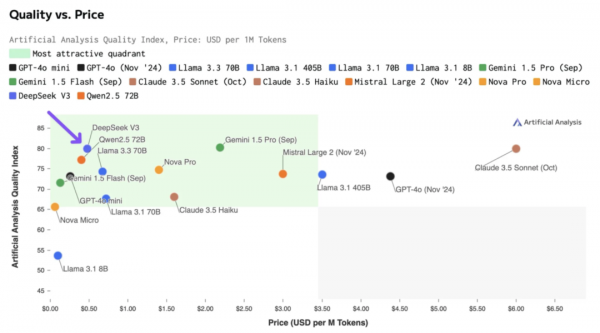

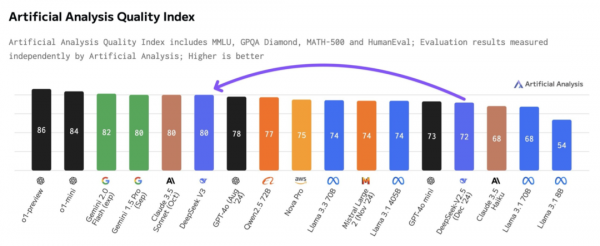

最后,根据Artifical Analysis的独立测评报告“A new leader in open source AI”:

DeepSeek-V3在其Quality Index榜单上超过GPT-4o,仅次于o1和Gemini 2.0 Flash,与Claude 3.5 Sonnet持平。

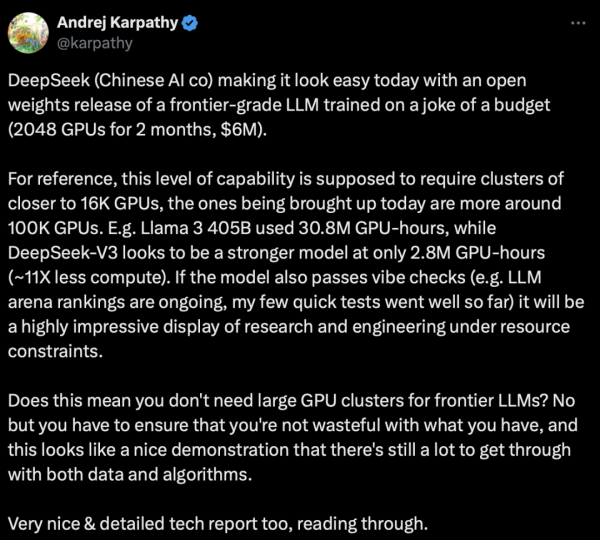

在此前DeepSeek-V2的文章中曾经提到过其核心技术创新MLA(可见开源模型社区又一位重量级选手掀桌子),这些技术在V2得到验证后,现在也成为了V3的技术核心。此外互联网上,包括大神Andrej Karpathy也给予了极高评价:

应该表示祝贺!Congratulations to DeepSeek,也祝那些真正走在星辰大海路上的选手创造更多佳绩!

0赞

0赞好文章,需要你的鼓励

推荐文章

推荐文章

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

Mind Lab提出三轴PEFT框架,通过增强共享基础模型、缩小个人适配器、扩展持久化适配器种群,探索百万个人AI模型的可行路径。

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

K-BROWSECOMP是一套专门测试AI在韩语网络中多步搜索推理能力的基准测试集,包含400道题,揭示全球顶尖AI模型在韩语环境下存在严重性能下滑,韩国本土模型得分更低至0%至10%。