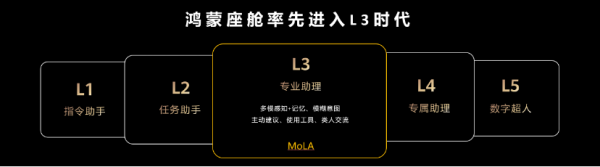

华为乾崑生态大会发布MoLA架构, 鸿蒙座舱率先迈入 L3 智能时代

2025 年 11 月 20 日,华为乾崑生态大会在广州盛大启幕,会上鸿蒙座舱携 MoLA 混合大模型 Agent 架构重磅亮相,不仅首推座舱智能化 L1 - L5 五级分级标准,更以全感官体验、自然交互与主动服务三大方向,重塑智能座舱行业发展格局。目前鸿蒙座舱用户数已突破 120 万,2025 年 1 - 10 月问界车型搭载版本的平均净推荐值达 93.6%,成用户口碑之选。

作为 HarmonySpace 5 起采用的核心架构,MoLA 通过融合多模态感知、通用大模型与垂域智能体,搭建起从用户意图到硬件执行的完整链路。其独创的全域免唤醒、导航三模式纠错等功能,让语音交互告别指令束缚。用户说 “车里有点暗” 即可开启阅读灯,导航时可随时改口调整目的地,彻底实现口语化控车。

此次大会明确鸿蒙座舱率先进入 L3 专业助理阶段。相较于前两级,L3 阶段具备长期记忆、模糊意图理解等核心能力,可主动提供服务。依托感知力、记忆力等六大类人能力,座舱能记住用户通勤习惯并主动创建场景,还可通过图文视频混合形式解答用车疑问,甚至联动外部工具完成咖啡预订等跨场景任务。

生态构建上,鸿蒙座舱以 MoLA 为核心,联动北向与南向双生态。北向新增 HUAWEI SOUND 空间音专区及云游戏,腾讯云游戏上线后可即点即玩热门网游;南向则实现智能香氛与氛围灯联动等外设智能交互,打通人车家无缝协同。

华为通过行业 Know - How、全栈 AI 算法等能力,让 MoLA 架构实现软硬件深度融合。此次发布不仅展示了导航、车控等五大智能体的实战能力,更以标准化分级为行业提供参考,推动智能座舱从出行工具向 “第三生活空间” 加速演进。

好文章,需要你的鼓励

让自动驾驶AI学会“聚焦重点“,速度提升7倍却更加安全

来自北京大学多媒体信息处理国家重点实验室和小鹏汽车的研究团队发布了一项重要研究成果,提出了一种名为FastDriveVLA的创新框架,让自动驾驶AI能够像人类司机一样,学会在纷繁复杂的道路场景中快速识别并聚焦于真正重要的视觉信息。

清华团队让机器学会“透视眼“:用视频AI破解透明物体深度估计难题

清华团队开发DKT模型,利用视频扩散AI技术成功解决透明物体深度估计难题。该研究创建了首个透明物体视频数据集TransPhy3D,通过改造预训练视频生成模型,实现了准确的透明物体深度和法向量估计。在机器人抓取实验中,DKT将成功率提升至73%,为智能系统处理复杂视觉场景开辟新路径。

TechCrunch创业战场大赛消费和教育科技领域26强公司榜单

TechCrunch年度创业战场大赛从数千份申请中筛选出200强,其中20强进入决赛角逐10万美元大奖。本次消费科技和教育科技领域共有26家公司入选,涵盖无障碍出行、AI视频制作、服装租赁、护肤推荐、纹身预约等创新应用,以及AI语言学习、个性化数学教育、职场沟通培训等教育科技解决方案,展现了科技创新在日常生活和教育领域的广泛应用前景。

ByteDance推出全新混合专家模型训练法:让AI专家团队各司其职,大幅提升大语言模型性能

字节跳动研究团队提出了专家-路由器耦合损失方法,解决混合专家模型中路由器无法准确理解专家能力的问题。该方法通过让每个专家对其代表性任务产生最强响应,同时确保代表性任务在对应专家处获得最佳处理,建立了专家与路由器的紧密联系。实验表明该方法显著提升了从30亿到150亿参数模型的性能,训练开销仅增加0.2%-0.8%,为混合专家模型优化提供了高效实用的解决方案。

TechCrunch创业战场大赛消费和教育科技领域26强公司榜单

新Mac开箱必备:完美工作桌面升级指南

如何使用ChatGPT新增应用集成功能

谷歌地图AI工具让节日和新年出行规划变得轻松便捷

2025年七大IT灾难回顾

openGauss熊伟:oGRAC+超节点,AI数据库的下一个五年

R语言重获关注 Tiobe编程语言排行榜重返前十

JDK 26:Java 26的新特性详解

AWS在re:Invent 2025后仍难构建企业AI完整解决方案

Linux基金会推出自主式AI基金会

GitHub个人访问Token被曝光后威胁激增,攻击者可直达云环境

Manus被收购,枫清科技将获过亿元投资:资本市场重估中国AI智能体

数智惠闽企,展车进福州|华为坤灵中国行2025·福建站成功举办,推动闽企智能化发展新征程

众智有为 致敬同路人|四川赛狄:从“碰撞”到“同路”,一位华为同路人的蜕变之旅

华为中国行2025·安徽新质生产力峰会 共绘新质生产力发展新图景

众智有为 致敬同路人|从ICT集成商到数智化赋能者,众诚科技的三十载进化论

众智有为 致敬同路人 | 同行之路:坚持长期主义,共赴电力产业新未来

云栖大会上,感受AI汽车的"乐与路"

传祺向往S9上市22.99万起 首批搭载华为乾崑智驾ADS 4+ HarmonySpace 5

华为发布 “4+10+N”中小企业智能化方案,打通迈向智能世界“最后一公里”

2025华为坤灵秋季新品发布会

众智有为 致敬同路人 | 15年砥砺征程,一舟电子携手华为,助力“数字湖南”铺设“数字高速公路”