昇思MindSpore安全技术助力OCR云服务通过国际最高水平安全认证

近日,昇思MindSpore支撑华为OCR云服务正式通过独立机构的AI C4审计认证,安全目标100%达成。这标志着昇思MindSpore的安全能力达到了业界领先水平,能够满足业界最高水平的AI云服务审计要求。此前,在德国,华为基于业务用例的试点项目向德国联邦信息安全办公室(BSI) 提供建议,支持其发布了AI云服务合规标准目录(AI C4),这是业界首个面向AI云服务的安全标准。

伴随着人工智能不断发展,在极大提升人们生产生活品质的同时,AI具有的技术特性如通用目的性、算法黑箱性以及数据依赖性等,在社会、企业、个人等维度引发了不小的风险与挑战,仅凭C5标准还不足以完全应对。为此,德国联邦信息安全局制定了一项特定于AI云服务的审计标准AI C4(AI Cloud Service Compliance Criteria Catalogue)——该标准设定了安全的基线水平,可通过独立审计机构对于AI云服务在其生命周期内的安全性进行可靠评估。

OCR服务是利用光学设备对图像进行捕获并完成文字识别的过程,可兼顾达成人力节约与效率提升的双目标。但痛点就在于,当攻击者对待识别的文字做出肉眼不易察觉的修改时,将会导致实施算法的模型无法对该修改做出正确的识别或处理,造成OCR服务对文字的识别准确率下降,但使用人员却很难看到这问题背后的真因。

昇思MindSpore从开源AI框架的角度出发,围绕AI全生命周期,构建出以下重点技术能力:

①模型安全

通过鲁棒性评测、对抗测评、对抗训练、模型加密等,实现模型保护;

②隐私保护

构建了隐私评估、差分隐私训练、联邦学习等技术,保障数据隐私;

③可解释性

通过原创语义级可解释技术、可解释方法工具集等,提高模型的可解释性,增强用户理解度,让用户更信任并有效地使用模型。

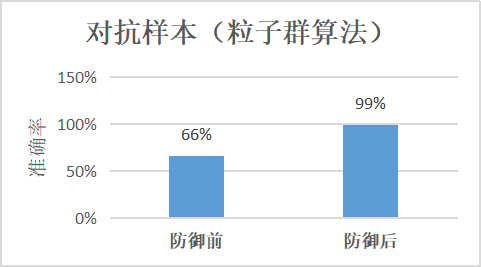

本次认证中,华为技术团队使用了昇思MindSpore模型安全评测工具MindSpore Armour对OCR服务进行安全性测评。从中发现,目前大多数OCR服务的算法模型均存在识别自然扰动和防御样本对抗能力差的问题,如文本框检测模型在校验噪声、PGD、PSO(粒子群)等攻击算法下的准确率小于66%。华为技术团队针对这些问题对模型开发进行指导,通过对抗样本检测、数据增强训练等技术,使模型对恶意样本的识别准确率达到 95+%,提高了模型及OCR服务的鲁棒性,达成了AI C4标准对AI云服务安全和鲁棒性的要求。

除助力华为OCR云服务通过AI C4认证外,昇思MindSpore率先出击,携手法荷多方权威评估和认证机构,在2021年完成了AI框架领域的认证标准制定,并于今年4月获得荷兰NSCIB颁发的CC EAL2+认证证书,填补了AI框架领域在安全标准上的空白,成为全球首个获得CC认证的AI框架,实现从0到1的突破。

此外,昇思MindSpore经过云计算开源产业联盟(OSCAR)评估,荣获全国首批《可信开源社区评估体系》认证。

在智能时代的浪潮中,昇思MindSpore致力于实现可信AI的最高要求,从安全技术和安全治理上不断提升AI安全水平。未来,昇思MindSpore仍将持续创新,与行业客户共同应对人工智能领域安全的风险与挑战,为客户提供更安全更可信的应用及服务。

来源:业界供稿

好文章,需要你的鼓励

Glean年收入突破3亿美元,削减AI成本成核心卖点

企业AI搜索公司Glean宣布年度经常性收入(ARR)达3亿美元,较15个月前的1亿美元增长三倍。尽管谷歌、微软、OpenAI等科技巨头纷纷入局企业AI搜索市场,Glean凭借"上下文图谱"技术深度理解企业业务需求,并帮助客户显著降低AI计算成本。该公司提供按用量计费和混合定价两种模式,客户涵盖Databricks、Reddit、Pinterest及三星等企业。Glean上轮融资后估值达72亿美元。

香港中文大学与MiniMax联手破解AI图像描述的“说多错多、说少漏多“困局

香港中文大学与MiniMax提出ClaimDiff-RL框架,将图像描述的AI训练从整体打分升级为逐条核查,有效解决了传统方式导致AI"少说保平安"的问题,同时在多项基准测试上超越Gemini-3-Pro-Preview。

蓝色起源“新格伦“火箭在佛罗里达测试中发生爆炸

杰夫·贝索斯旗下的蓝色起源公司在佛罗里达卡纳维拉尔角进行静态点火测试时,新格伦重型火箭发生爆炸。这是美国历史上最大规模的火箭爆炸之一,也是蓝色起源公司遭遇的最严重失败。所有人员安全,但该事故可能导致新格伦火箭项目长期暂停。此前该火箭已成功完成三次发射,并实现了助推器回收和重复使用。

NTU、HKU等多所顶校联手,让AI同时“多角度看片“——视频理解的并行探针革命

ParaVT是一个由南洋理工等多校联合提出的并行视频工具调用框架,通过让AI同时分析多段视频并引入PARA-GRPO算法解决训练中的格式崩溃与工具跳过问题,在六项长视频理解测试中平均提升约7.9%。

Glean年收入突破3亿美元,削减AI成本成核心卖点

蓝色起源"新格伦"火箭在佛罗里达测试中发生爆炸

智能体AI正在重塑企业架构与Token经济学

堪培拉理工学院如何借助技术革新重塑课堂教学体验

Gemma 4携手Arm:优化端侧AI,加速移动应用体验

制药公司与初创企业如何携手推动AI落地

《星球大战》导演盛赞生成式AI:电影制作的革命性工具

Salesforce借助Informatica布局企业级无头数据管理架构

几乎所有M5 MacBook Air配置现在都降价近200美元

企业用好Agent,关键不在“买一个智能体”|原点Talk 分享会

大模型评测风向变了,Testin云测如何构建企业级AI质量标尺?

因民事养老金管理失误,英国政府拒绝向Capita授予5.63亿英镑合同

昇思MindSpore 2.3全新发布 | 昇思人工智能框架峰会2024圆满举办

中国光谷·多模态人工智能大会暨多模态人工智能产业联合体第三次全体会议圆满召开

Nature子刊发表!基于昇思MindSpore打造的AI+科学计算新成果PeRCNN面世

WAIC2023最高荣誉SAIL奖揭晓!昇思MindSpore使能大模型、AI4S打造流体仿真重器

人工智能框架生态峰会2023·昇思MindSpore科学智能专题论坛顺利举办

人工智能框架生态峰会MindSpore TechDay成功举办,一起昇思,无尽创新

人工智能框架生态峰会2023顺利举办,助力产教融合,使能千百行业

人工智能框架生态峰会2023丨软通动力成为昇思MindSpore开源社区理事会首批成员单位

基于昇思AI框架的全模态大模型“紫东.太初2.0”正式发布

昇思MindSpore与产学界共同探索大模型&科学智能原生创新