Open-Sora Plan项目:旨在重现 OpenAI 的视频生成模型Sora

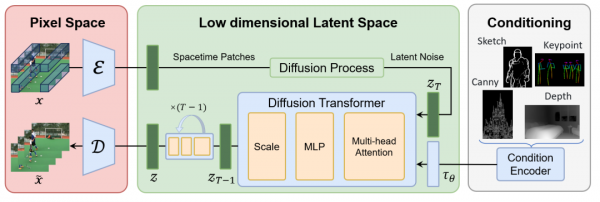

国内一个由北大和Rabbitpre AI发起的Open-Sora Plan的项目,旨在重现 OpenAI 的视频生成模型Sora。技术框架,如下所示:

Video VQ-VAE,这将视频压缩成潜在的时间和空间维度。

Denoising Diffusion Transformer。

Condition Encoder(条件编码器),这支持多个条件输入。

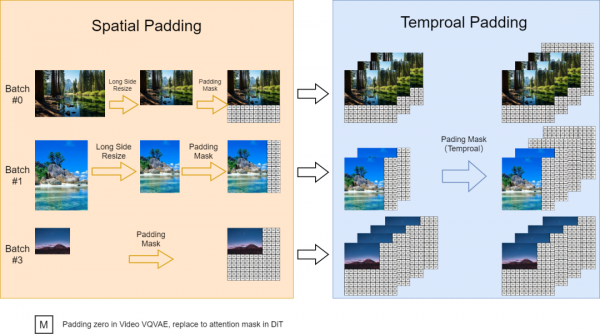

支持可变长宽比、可变分辨率和可变时长,如下所示:

可变长宽比,实现了并行批量训练的动态掩蔽策略,同时参考FIT保持灵活的纵横比。具体来说,调整高分辨率视频的大小,使其最长边为 256 像素,保持宽高比,然后在右侧和底部填充零,以实现一致的 256x256 分辨率。这有助于 videovae 批量编码视频,并方便扩散模型使用自己的注意力掩模对批量潜伏进行去噪。

可变分辨率,在推理过程中,使用位置插值来启用可变分辨率采样,尽管是在固定的 256x256 分辨率上进行训练。将可变分辨率噪声潜伏的位置索引从 [0, seq_length-1] 缩小到 [0, 255],以使它们与预训练范围对齐。这种调整使得基于注意力的扩散模型能够处理更高分辨率的序列。

可变时长,在VideoGPT中使用视频 VQ-VAE将视频压缩为潜在视频,从而实现多持续时间生成。将空间位置插值扩展到时空版本,以处理可变持续时间的视频。

参考文献:

[1] 项目地址:https://pku-yuangroup.github.io/Open-Sora-Plan/

[2] 代码:https://github.com/PKU-YuanGroup/Open-Sora-Plan

来源:NLP工程化

好文章,需要你的鼓励

用谷歌街景模拟真实世界场景,Project Genie 全面升级

谷歌发布Project Genie新功能,将其世界生成模型与Google街景视图相结合,使AI智能体能够在基于真实地点的虚拟环境中导航与交互。用户可选择美国任意地点,结合"沙漠""石器时代"等风格,生成富有创意的沉浸式世界。该功能目前已向全球符合条件的Google AI Ultra订阅用户(200美元/月)逐步开放,未来计划扩展至更多地区。

新加坡国立大学发布首个视频“潜台词“理解基准测试:AI究竟能不能读懂视频背后的弦外之音?

新加坡国立大学构建了首个视频隐喻理解基准ViMU,含588段视频与2352道题,测试16个主流AI模型均未超过50%,揭示AI在视频潜台词理解上的系统性短板。

保加利亚启用谷歌云强化国家网络安全防御

保加利亚国家系统集成商BIS已部署谷歌云Cybershield服务,成为欧洲首批落地该方案的国家之一。项目获欧盟资金支持,旨在整合网络情报与遥测数据,覆盖54个政府及公共部门实体,将威胁检测与响应从被动转为主动。BIS将借助谷歌云安全运营平台及Mandiant威胁情报,构建联邦化跨机构安全运营中心,以AI驱动的防御能力应对日益复杂的网络威胁。

浙江大学联合多所顶校:让AI真正“看懂“360度全景图,机器人导航和视觉搜索迎来新突破

浙江大学等机构联合提出PanoWorld,通过球面空间交叉注意力和57万张全景图训练数据,让AI能直接理解360度全景图的空间结构,在导航和视觉搜索任务中大幅超越现有方法。