马斯克打脸OpenAI,全球最大巨无霸模型Grok-1开源!3140亿参数8个MoE,GitHub狂揽6k星

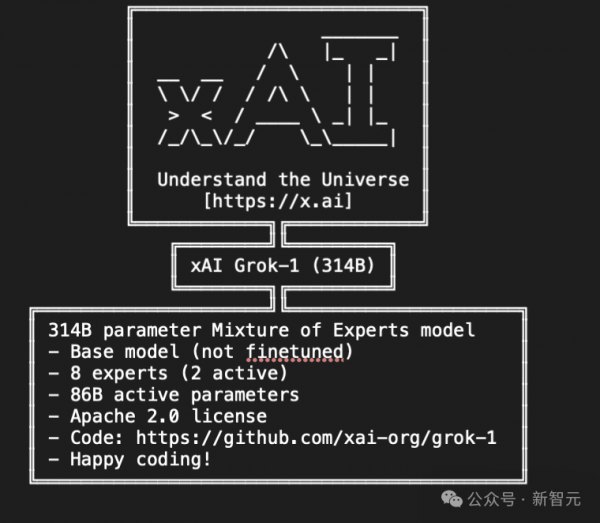

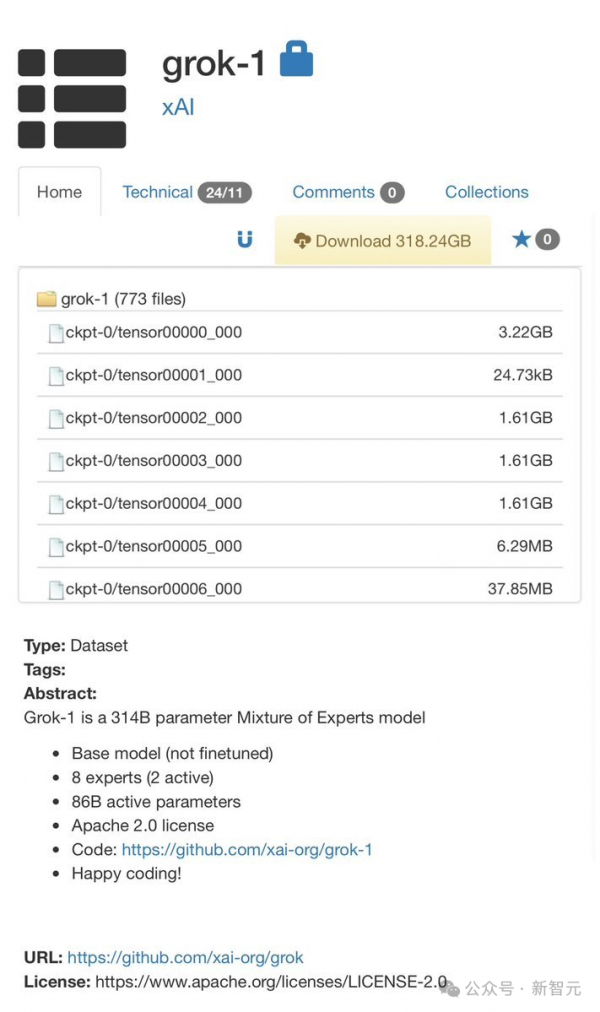

就在刚刚,xAI正式发布3140亿参数混合专家模型Grok-1的权重和架构。

3140亿的参数,让Grok-1成为迄今参数量最大的开源LLM,是Llama 2的4倍。

目前,xAI关于Grok-1没有透露更多信息。

官网放出的信息如下——

- 基础模型在大量文本数据上训练,未针对任何特定任务进行微调。

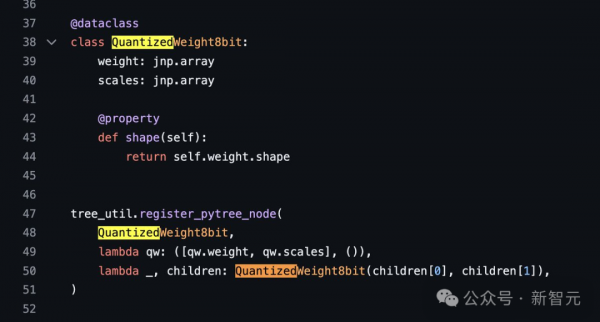

- 314B参数的MoE,有25%的权重在给定token上处于激活状态。

- 2023年10月,xAI使用JAX和Rust之上的自定义训练堆栈从头开始训练。

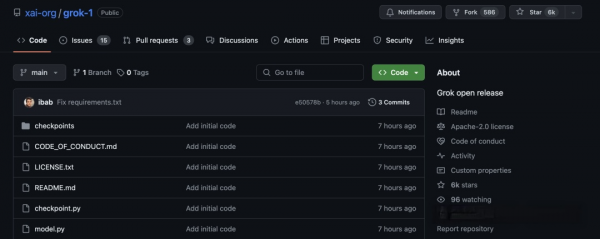

一经上线GitHub,Grok就狂揽了6k星,586个Fork。

项目地址:https://github.com/xai-org/grok-1

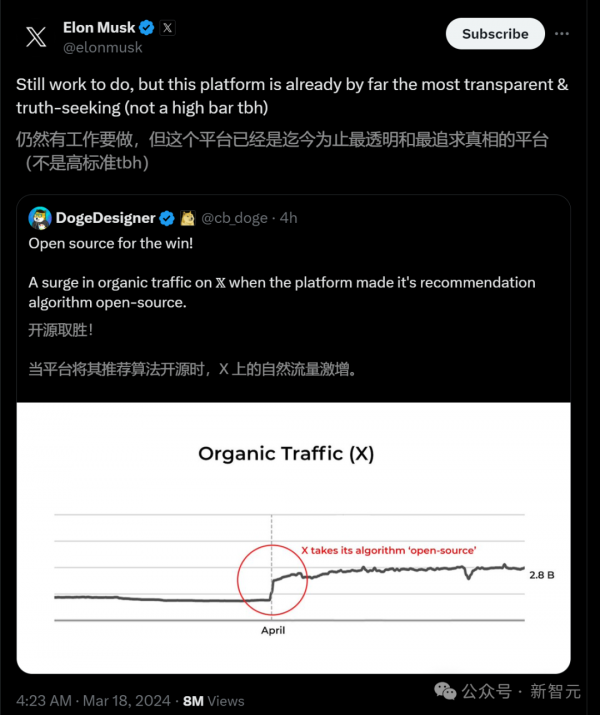

马斯克还不忘嘲讽OpenAI一番,「告诉我们更多关于OpenAI的「open」部分...」

纽约时报点评道,开源Gork背后的原始代码,是这个世界上最富有的人控制AI未来战斗的升级。

开源究竟会让技术更安全,还是会让它更滥用?

「开源支持者」马斯克,以身作则地卷入了AI界的这场激烈辩论,并用行动给出了答案。

小扎刚刚也对Grok做出了评价,「并没有给人留下真正深刻的印象,3140亿参数太多了,你需要一堆H100,不过我已经买下了」。

一条磁力链,全球首个最大模型开源

pip install -r requirements.txtpython run.py

这个脚本会在测试输入上,加载checkpoint和模型中的样本。

magnet:?xt=urn:btih:5f96d43576e3d386c9ba65b883210a393b68210e&tr=https%3A%2F%2Facademictorrents.com%2Fannounce.php&tr=udp%3A%2F%2Ftracker.coppersurfer.tk%3A6969&tr=udp%3A%2F%2Ftracker.opentrackr.org%3A1337%2Fannounce

更多细节

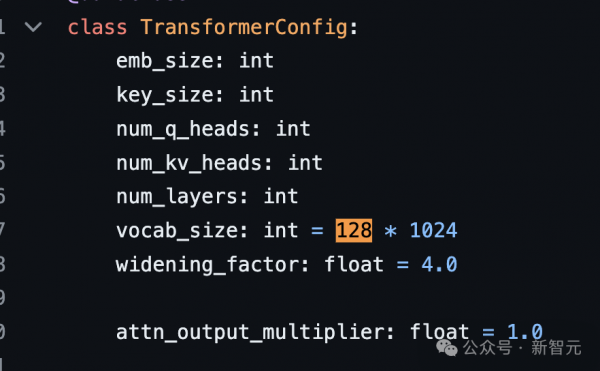

- tokenizer词汇量:131,072(于GPT-4类似)相当于2^17

- 嵌入大小:6144(48*128)

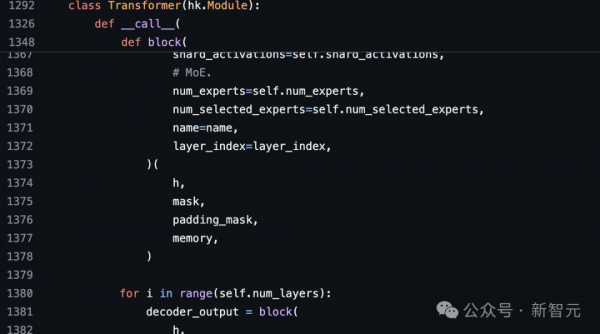

- Transformer层:64(每一层都有一个解码层:多头注意块和密度块)

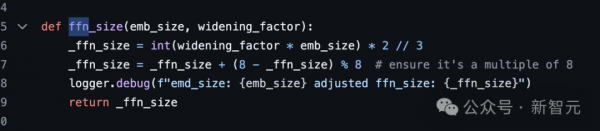

密集块(密集前馈块):

- 宽度因子(Widening Factor):8

- 上下文长度:8192个token

网友:开源争霸战要来

AI社区已经沸腾了!

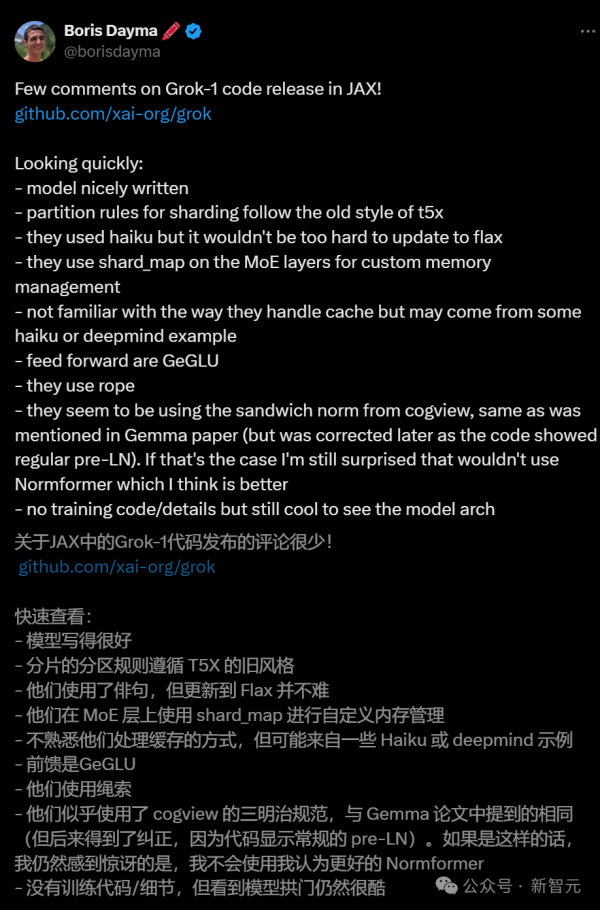

技术界指出,Grok的亮点是在前向反馈层中使用了GeGLU以及归一化方法,并且使用了有趣的三明治范式技术(sandwich norm technique)。

连OpenAI的员工,都表示了自己对Grok的强烈兴趣。

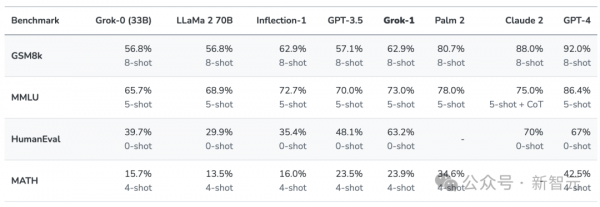

第一代Grok已超越Llama-2-70B

马斯克为何选择开源?

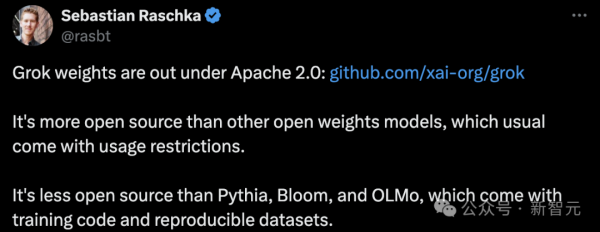

在数次嘲讽OpenAI是「CloseAI」之后,马斯克果真选择了开源自家大模型。

好文章,需要你的鼓励

NDC布局助手上线:Kollmorgen推出移动机器人路线优化工具

Kollmorgen发布NDC布局助手软件工具,专为工厂和仓库中的自动导引车(AGV)及自主移动机器人(AMR)的路线规划与优化而设计。该工具通过分段分析路线,帮助工程师在系统部署前识别瓶颈与低效环节,提供行驶时间、车速及优化潜力等关键数据,并以可视化方式标注问题区域,从而缩短布局设计与验证周期。Kollmorgen表示,该工具未来还将融入AI驱动的优化能力。

加州大学圣地亚哥分校等机构联合发布:AI大模型强化学习训练中那个被忽视的关键环节,终于被系统梳理清楚了

这篇由加州大学圣地亚哥分校等六所机构联合发布的综述(arXiv:2605.02913,2026年4月),首次系统梳理了大型语言模型强化学习训练中长期被忽视的轨迹设计问题,提出了GFCR四模块框架(生成、过滤、控制、回放),覆盖数学、代码、多模态和智能代理等多个应用场景,并附有实用的故障诊断手册,为AI训练工程师提供系统性的方法论指导。

仓储自动化革新:将存储空间转化为战略优势

现代仓储已从幕后走向前台,配送速度成为品牌竞争核心。面对次日达甚至两小时送达的市场压力,领先履约中心借鉴敏捷开发理念,以周为单位迭代代码、机器人与工作流程。IoT信标、边缘计算与视觉识别模块构建双层架构,实现厘米级货盘追踪与低延迟决策。人机协作模式让员工从重体力劳动转向异常处理与数据分析,拣选准确率突破99%。同时,自动化系统实时采集碳排放数据,在提速的同时实现可量化的减排目标。

中科大联手FrameX.AI:让AI视频生成器像“优等生“一样边学边挑老师作业的新方法

中国科学技术大学与FrameX.AI联合提出Stream-R1框架,针对AI视频生成蒸馏训练中"一视同仁"的核心缺陷,引入奖励模型对训练样本进行双重加权:在样本层面根据质量分数筛选可靠的学习信号,在像素与帧层面通过梯度显著性热力图集中优化最需改进的区域,使4步快速学生模型在VBench多项指标上超越慢速多步教师模型,推理速度提升30倍且不增加任何额外计算开销。