АЂРядЦЗЂВМЭЈвхЧЇЮЪ2.5ЃЌадФмШЋУцИЯГЌGPT-4 Turbo

5дТ9ШеЯћЯЂЃЌАЂРядЦе§ЪНЗЂВМЭЈвхЧЇЮЪ2.5ЃЌФЃаЭадФмШЋУцИЯГЌGPT-4 TurboЃЌГЩЮЊЕиБэзюЧПжаЮФДѓФЃаЭЁЃЭЌЪБЃЌЭЈвхЧЇЮЪзюаТПЊдДЕФ1100вкВЮЪ§ФЃаЭдкЖрИіЛљзМВтЦРЪеЛёзюМбГЩМЈЃЌГЌдНMetaЕФLlama-3-70BЃЌГЩЮЊПЊдДСьгђзюЧПДѓФЃаЭЁЃ

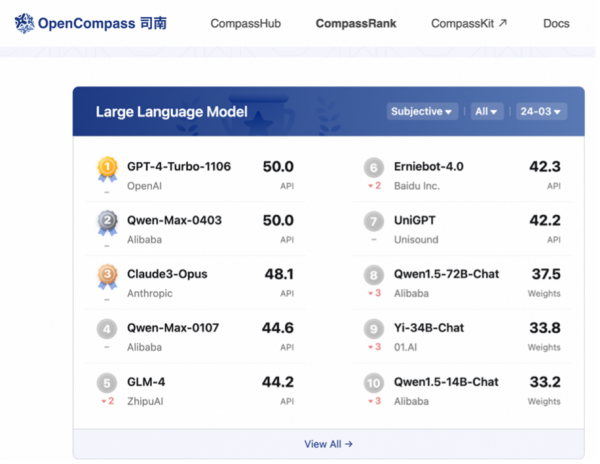

ЯрБШЭЈвхЧЇЮЪ2.1АцБОЃЌЭЈвхЧЇЮЪ2.5ЕФРэНтФмСІЁЂТпМЭЦРэЁЂжИСюзёбЁЂДњТыФмСІЗжБ№ЬсЩ§9%ЁЂ16%ЁЂ19%ЁЂ10%ЃЌжаЮФФмСІИќЪЧГжајСьЯШвЕНчЁЃдкШЈЭўЛљзМOpenCompassЩЯЃЌЭЈвхЧЇЮЪ2.5ЕУЗжзЗЦНGPT-4 TurboЃЌЪЧИУЛљзМЪзДЮТМЕУЙњВњДѓФЃаЭШЁЕУШчДЫГіЩЋЕФГЩМЈЁЃ

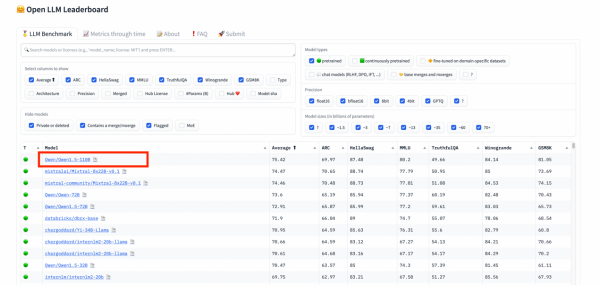

ЭЈвхЛЙЗЂВМСЫзюаТПюПЊдДФЃаЭЃЌ1100вкВЮЪ§ЕФQwen1.5-110BЃЌИУФЃаЭдкMMLUЁЂTheoremQAЁЂGPQAЕШЛљзМВтЦРжаГЌдНСЫMetaЕФLlama-3-70BФЃаЭЃЛдкHuggingFaceЭЦГіЕФПЊдДДѓФЃаЭХХааАёOpen LLM LeaderboardЩЯЃЌQwen1.5-110BГхЩЯАёЪзЃЌдйЖШжЄУїЭЈвхПЊдДЯЕСавЕНчзюЧПЕФОКељСІЁЃ

ЭЈвхЕФЖрФЃЬЌФЃаЭКЭзЈгаФмСІФЃаЭвВОпБИвЕНчЖЅМтгАЯьСІЁЃЭЈвхЧЇЮЪЪгОѕРэНтФЃаЭQwen-VL-MaxдкЖрИіЖрФЃЬЌБъзМВтЪджаГЌдНGemini UltraКЭGPT-4VЃЌФПЧАвбдкЖрМвЦѓвЕТфЕигІгУЃЛЭЈвхЧЇЮЪДњТыДѓФЃаЭCodeQwen1.5-7BдђЪЧHuggingFaceДњТыФЃаЭАёЕЅBig CodeЕФЭЗУћбЁЪжЃЌЛЙЪЧЙњФкгУЛЇЙцФЃЕквЛЕФжЧФмБрТыжњЪжЭЈвхСщТыЕФЕззљЁЃ

ЭЈвхДѓФЃаЭЮЪЪРвЛФъЖрРДЃЌЛЙЗЂеЙГіСЫвЕНчСьЯШЕФЮФЩњЭМЁЂжЧФмБрТыЁЂЮФЕЕНтЮіЁЂвєЪгЦЕРэНтЕШФмСІЃЌЦѓвЕПЭЛЇКЭПЊЗЂепПЩвдЭЈЙ§APIЕїгУЁЂФЃаЭЯТдиЕШЗНЪННгШыЭЈвхЃЌИіШЫгУЛЇПЩДгЭЈвхAPPЁЂЙйЭјКЭаЁГЬађУтЗбЪЙгУЭЈвхМвзхШЋеЛЗўЮёЁЃ

КУЮФеТЃЌашвЊФуЕФЙФРј

ТѕЯђTokenОМУЪБДњЃЌF5вдЁАAIИГФмНЛИЖЁБжўЛљжЧФмаТЩњЬЌ

ЦѓвЕЬИAIЛљДЁЩшЪЉЪБЃЌзЂвтСІЭљЭљЪзЯШМЏжадкФЃаЭЁЂGPUКЭЫуСІМЏШКЩЯЁЃЕЋЕБДѓФЃаЭгІгУзпЯђЙцФЃЛЏЭЦРэЃЌвЛИіЦПОБПЊЪМИЁЯжЃКЫуСІВЩЙКЭъГЩЃЌВЂВЛвтЮЖзХTokenФмЙЛБЛЮШЖЈЁЂЕЭГЩБОЁЂПЩПиЕиНЛИЖГіШЅЁЃ

ЕБAIЛњЦїШЫЁАздаХЕиЁАзВЯђЧНБкЃКSTATE16баОПдКНвЪОЮяРэAIЯЕЭГжаФЧаЉЮоЩљЮоЯЂЕФжТУќДэЮѓ

STATE16баОПдКетЦЊзлЪіЗЂЯжЃЌЮяРэAIЯЕЭГДцдк"ОВФЌЪЇаЇ"ЗчЯеЁЊЁЊAIвдИпЖШздаХжДааЛљгкДэЮѓЪРНчаХЯЂЕФЖЏзїЃЌШДВЛДЅЗЂШЮКЮБЈОЏЃЌВЂЬсГідкAIЪфГігыЮяРэжДаажЎМфНЈСЂЖРСЂЪкШЈВуЕФПђМмЁЃ

УзРЁЄФТРЬсжиЗЕЙЋжкЪгвАЃЌНїЩїЗЂЩљ

ФТРЕйЪБИє18ИідТЪзДЮНгЪмжиДѓУНЬхВЩЗУЃЌНщЩмЦфДДСЂЕФThinking Machines Labе§дкПЊЗЂЕФ"НЛЛЅФЃаЭ"ЁЃИУФЃаЭФмвд200КСУыМфИєДІРэвєЦЕЁЂЮФБОКЭЪгЦЕСїЃЌВЖзНШЫРрНЛСїжаЕФжаЖЯЁЂаое§КЭЭЃЖйЁЃЫ§ЛЙЬИМАOpenAI"еўБфжм"ОРњЃЌЧПЕїаавЕОіВпШЈЙ§гкМЏжаЕФЕЃгЧЃЌВЂЛигІСЫЙЋЫОНќЦкбаОПШЫдБРыжАЮЪЬтЃЌБэЪОетЪЧГѕДДЪЕбщЪвЕФе§ГЃВЈЖЏЁЃ

ЕБAIбЇЛсЁАБпИЩБпбЇЁАЃКUIUCгыЮЂШэСЊКЯДђдьЕФЭјвГжЧФмЬхбЕСЗаТЗЖЪН

UIUCгыЮЂШэСЊКЯбаЗЂЕФOpenWebRLПђМмШУ4BаЁФЃаЭНіЦО400ЬѕГѕЪМЪ§ОнЃЌЭЈЙ§дкецЪЕЭјеОЩЯБпзіБпбЇЕФЧПЛЏбЇЯАЗНЪНЃЌдкЭјвГжЧФмЬхЛљзМЩЯГЌдНСЫгУ27ЭђЬѕЪ§ОнбЕСЗЕФОКељЖдЪжЁЃ

Ш§аЧHealthгІгУгРДAIЩ§МЖЃЌGalaxy Watch 9ЗЂВМЧАЯІИќаТЬсЧАНвЯў

MetaжЧФмблОЕБЛЦиКЌ"ШЫСГЪЖБ№"зЗзйДњТыЃЌвўЫНЗчЯев§ЗЂОЏЪО

GeminiЦѓвЕжЧФмЬхЦНЬЈЕФжЧФмЬхRAGШчКЮЪЕЯжПЩППЯьгІ

ТщЪЁРэЙЄбЇдКAIгыМЦЫубаЬжЛсЃКММЪѕНјВНжаВЛПЩЛђШБЕФШЫЮФвђЫи

бЧТэбЗШЋаТЪ§ОнжааФТЗгЩМмЙЙНЕЕЭAWSЭјТчФмКФ40%

iOS 27МДНЋЗЂВМЃЌЖрПюiPhoneгІгУНЋгРДШЋаТЩшМЦЩ§МЖ

СЌНгадвбГЩЮЊгыМЦЫуКЭДцДЂЭЌЕШживЊЕФAIЛљДЁЩшЪЉКЫаФвЊЫи

ПЊЗЂепШддкЕШД§MetaзюаТAIФЃаЭЕФAPIЗУЮЪШЈЯо

ТѕЯђTokenОМУЪБДњЃЌF5вдЁАAIИГФмНЛИЖЁБжўЛљжЧФмаТЩњЬЌ

УзРЁЄФТРЬсжиЗЕЙЋжкЪгвАЃЌНїЩїЗЂЩљ

ЬиЫЙРвЩЫЦЩОГ§FSDжЄОнЃЌПЈЬиБЫРеМгЫйЕчЖЏЛЏВМОжЃЌИпбЙЯЕЭГММЪѕХрбЕПЬВЛШнЛК

жЧФмЬхЭјТчСїСПЪзГЌецШЫЗУЮЪЃЌ"ЫРЭіЛЅСЊЭј"РэТлв§ЗЂаТељвщ

DeepSeekжЎКѓЃЌжаЙњШЫаЮЛњЦїШЫвдЁАШКЬхжЧФмЁБдйДЮЯЦЦ№ММЪѕРЫГБ

QwQ-32BФЃаЭГЩБОЕиВПЪ№ИЃвєЃЌЭЈвхAppПЩЕквЛЪБМфЬхбщ

ШыОжжЧМнЕФгЁЦцЃЌПДЕНСЫдѕбљЕФЮДРДЃП

ГЩБОДђЕН6ЭђвдЯТЃЌЪжАбЪжНЬФугУ4ТЗШёьХЯдПЈ+жСЧПWХмDeepSeek

ЧЇРяПЦММССЯрМЊРћAIжЧФмПЦММЗЂВМЛсЃЌЙВЦєЁАAI+ГЕЁБаТМЭдЊ

ЬьвэдЦCPUЪЕР§ВПЪ№DeepSeek-R1ФЃаЭзюМбЪЕМљ

ОЉЖЋдЦгыБІЕТМЦЫуеНТдЧЉдМЃЌЙВЛцЗжВМЪНДцДЂгыжЧЫуаТЮДРД

АЂРядЦРюЗЩЗЩЃКНЋДѓФЃаЭЃЌзАНјЪ§ОнПтРя

ШЋЧђAIЖЅЛсAAAI 2025 дкУРПЊФЛЃЌВњбЇбаСЊЪжЕФЁАжаЙњЖгЁББэЯжССбл

ТьвЯЪ§ПЦЬсГіДДаТПчгђЮЂЕїПђМмScaleOTШыбЁШЋЧђAIЖЅЛсAAAI 2025