英伟达GPU:聚焦AI超大规模组网

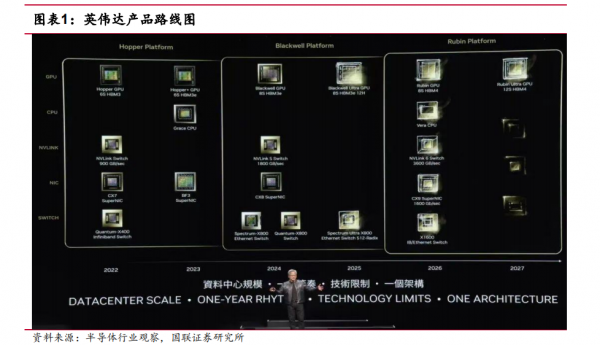

在 2024 年以前,英伟达平均 2 年推出新一代 GPU 架构,目前 Blackwell 芯片已经投产,并预计于 2025 年推出 Blackwell Ultra AI 芯片,2026 年推出下一代 AI 平台“Rubin”,2027 年推出 Rubin Ultra,更新节奏将变为“一年一次”。

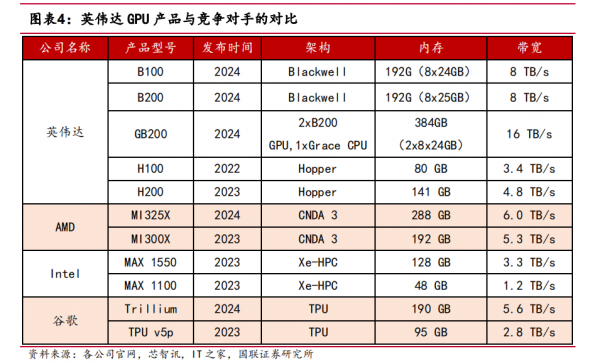

通过加快产品迭代,英伟达保持产品性能优势,且生成单个Token 功耗大幅降低。在各大 GPU 厂商新推出的产品中,英伟达 Blackwell在性能上高于 AMD 的 Instinct MI325X 和谷歌的 Trillium 芯片。

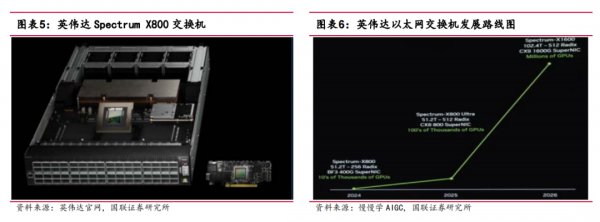

英伟达表达了发力 AI 以太网的决心,其全球首个专为 AI 设计的高性能以太网架构 Spectrum-X,目前正在为多家客户进行量产,公司预计 SpectrumX 将在一年内跃升至数十亿美元的产品线。英伟达推出了适用于以太网的Spectrum X800 交换机。此外,英伟达计划在 2025 年推出 Spectrum X800 Ultra,X800 将支持 10 万卡算力集群互联,而后续的 Spectrum X1600 将支持百万卡算力集群互联。

1 英伟达持续保持 GPU 领先优势

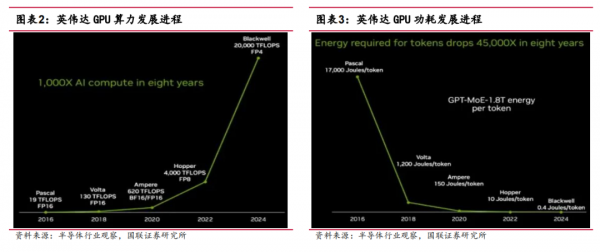

GPU 性能持续提升,生成单个 Token 功耗大幅降低。从“Pascal”P100 GPU 一代到“Blackwell”B100 GPU 一代,8 年间 GPU 的性能提升了 1053 倍,从 19 TFLOPS提升到 20000 TFLOPS。功耗方面,Blackwell 在 Token 生成能耗上大幅降低。在 Pascal时代,每个 Token 消耗的能量高达 1.7 万焦耳,Blackwell 使得生成每个 Token 只需消耗 0.4 焦耳的能量。

通过加快产品迭代,英伟达得以保持明显的产品性能优势。在各大 GPU 厂商 2024年新推出的产品中,英伟达Blackwell系列GPU在性能上高于AMD的Instinct MI325X和谷歌的 Trillium 芯片,叠加 Blackwell 芯片已经量产,英伟达依然维持较大优势。

2 英伟达发力AI以太网,超大规模组网趋势明确

英伟达在财报会上表达了发力 AI 以太网的决心。英伟达推出了适用于以太网的 Spectrum X800 交换机,拥有每秒 51.2 TB 的速度和 256 路径(radix)的支持能力。此外,英伟达计划在 2025 年推出 Spectrum X800Ultra,X800 将支持 10 万卡算力集群互联,而后续的 Spectrum X1600 将支持百万卡算力集群互联,以太网在 AI 集群组网上的应用或将持续增长。

展望 2024 年 H2,英伟达 GPU 芯片的快速迭代,NVLink、InfiniBand、以太网连接方案同步演进。NVIDIA Quantum-X800 是英伟达第一款使用 200Gb/s-per-laneSerDes 方案的交换机设备,通过 72 个 OSPF 1.6T 光模块提供 144 个 800G 端口,明确了 1.6T 光模块需求。

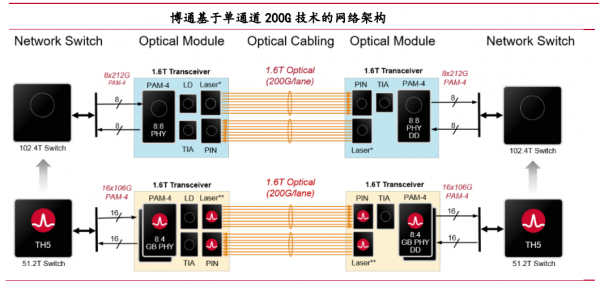

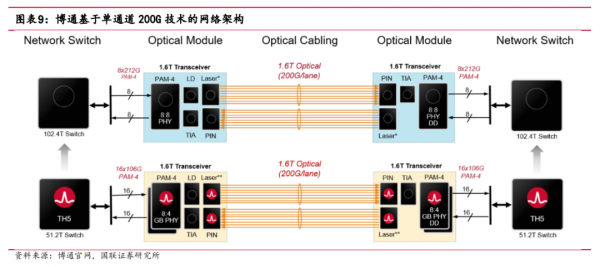

产业链方面,博通在官网给出了基于单通道 200G 光通信技术的网络架构图。根据博通的方案,单通道 200G 光通信技术可以适配 51.2T/102.4T 两个代际的交换机芯片。单通道 200G 光网络包括了 EML、VCSEL、CW 光源、基于单通道 200G 方案的 1.6T光模块、线缆等。

展望 2024H2 至 2025,我们认为 1.6T 光模块的研发和交付能力依然会主导光模块厂商的竞争格局,有利于头部企业强化竞争优势。同时低时延、低成本、低功耗的CPO、LPO、硅光、薄膜铌酸锂方案有望给新的企业带来破局机会。

好文章,需要你的鼓励

苹果48GB M5 Pro MacBook Pro创历史新低,直降300美元

B&H近期对多款M5 Pro MacBook Pro机型推出300美元优惠。14英寸M5 Pro版本(48GB内存+1TB固态硬盘)现售价2299美元,较原价2599美元节省300美元,且该配置在亚马逊无法购买,折扣机会更为难得。此外,16英寸M5 Pro版本(64GB内存+1TB固态硬盘)同样享有300美元折扣。B&H在多款高配MacBook机型上的定价已低于亚马逊,是近期可找到的最优价格。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

Insta360推出GO 3S复古套装,将现代4K运动相机与胶片时代美学结合。套装核心仍是仅重39克的GO 3S,新增复古取景器、胶片风格滤镜、NFC定制外壳及可延长录制时长至76分钟的电池组。复古取景器模仿老式腰平相机设计,鼓励用户放慢节奏、专注构图。相机内置11种色彩预设及负片、正片等滤镜,同时保留FlowState防抖、4K拍摄及10米防水能力,面向热衷复古影像风格的年轻创作者。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。