马斯克打脸OpenAI,全球最大巨无霸模型Grok-1开源!3140亿参数8个MoE,GitHub狂揽6k星

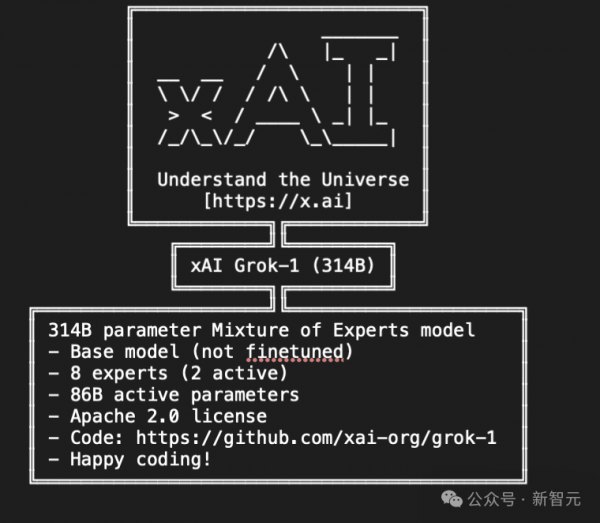

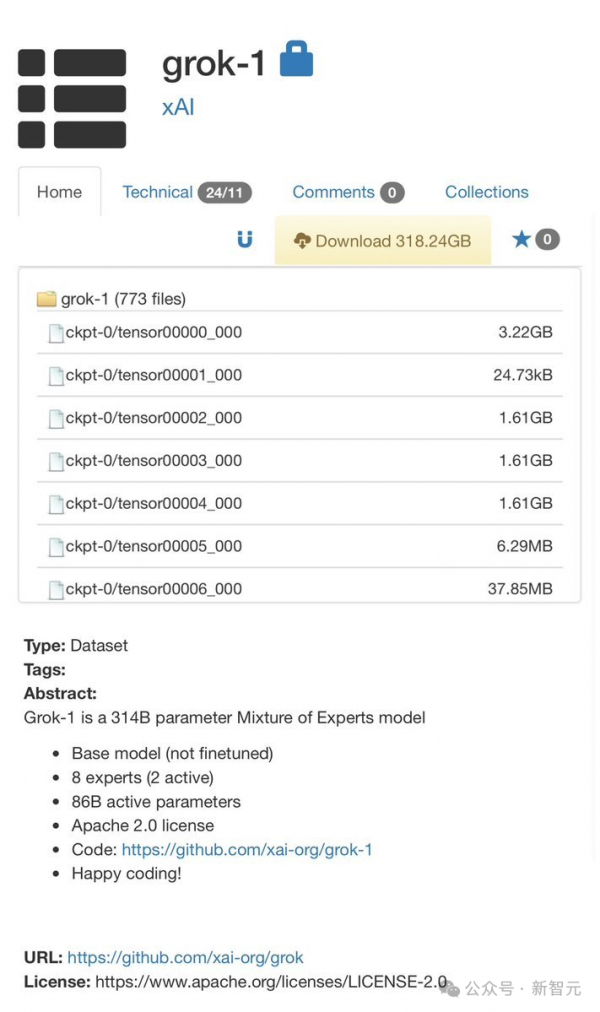

就在刚刚,xAI正式发布3140亿参数混合专家模型Grok-1的权重和架构。

3140亿的参数,让Grok-1成为迄今参数量最大的开源LLM,是Llama 2的4倍。

目前,xAI关于Grok-1没有透露更多信息。

官网放出的信息如下——

- 基础模型在大量文本数据上训练,未针对任何特定任务进行微调。

- 314B参数的MoE,有25%的权重在给定token上处于激活状态。

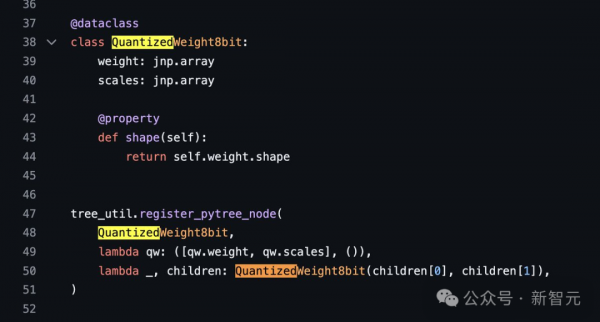

- 2023年10月,xAI使用JAX和Rust之上的自定义训练堆栈从头开始训练。

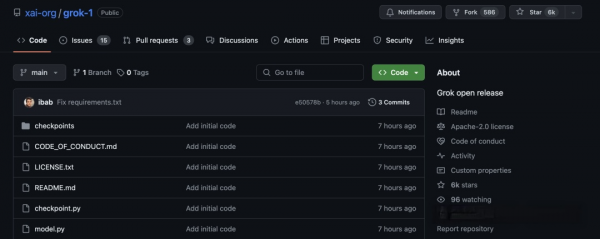

一经上线GitHub,Grok就狂揽了6k星,586个Fork。

项目地址:https://github.com/xai-org/grok-1

马斯克还不忘嘲讽OpenAI一番,「告诉我们更多关于OpenAI的「open」部分...」

纽约时报点评道,开源Gork背后的原始代码,是这个世界上最富有的人控制AI未来战斗的升级。

开源究竟会让技术更安全,还是会让它更滥用?

「开源支持者」马斯克,以身作则地卷入了AI界的这场激烈辩论,并用行动给出了答案。

小扎刚刚也对Grok做出了评价,「并没有给人留下真正深刻的印象,3140亿参数太多了,你需要一堆H100,不过我已经买下了」。

一条磁力链,全球首个最大模型开源

pip install -r requirements.txtpython run.py

这个脚本会在测试输入上,加载checkpoint和模型中的样本。

magnet:?xt=urn:btih:5f96d43576e3d386c9ba65b883210a393b68210e&tr=https%3A%2F%2Facademictorrents.com%2Fannounce.php&tr=udp%3A%2F%2Ftracker.coppersurfer.tk%3A6969&tr=udp%3A%2F%2Ftracker.opentrackr.org%3A1337%2Fannounce

更多细节

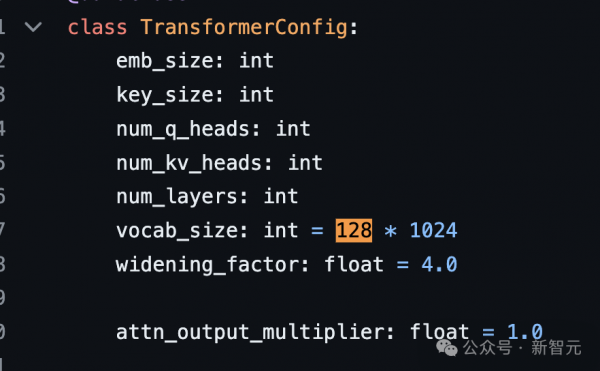

- tokenizer词汇量:131,072(于GPT-4类似)相当于2^17

- 嵌入大小:6144(48*128)

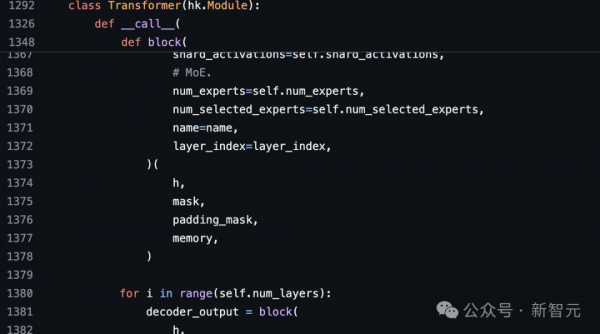

- Transformer层:64(每一层都有一个解码层:多头注意块和密度块)

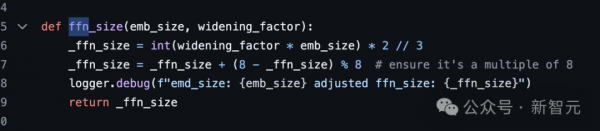

密集块(密集前馈块):

- 宽度因子(Widening Factor):8

- 上下文长度:8192个token

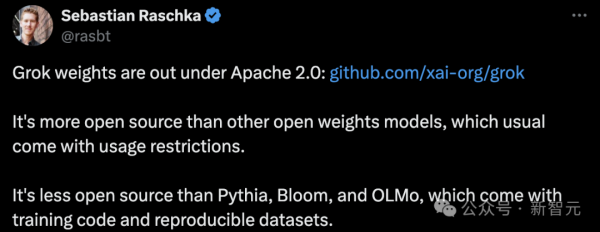

网友:开源争霸战要来

AI社区已经沸腾了!

技术界指出,Grok的亮点是在前向反馈层中使用了GeGLU以及归一化方法,并且使用了有趣的三明治范式技术(sandwich norm technique)。

连OpenAI的员工,都表示了自己对Grok的强烈兴趣。

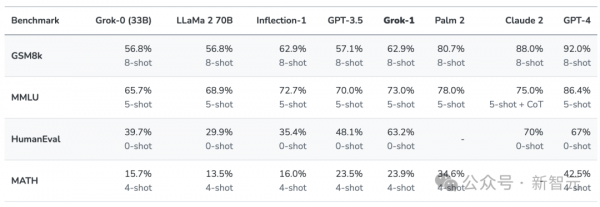

第一代Grok已超越Llama-2-70B

马斯克为何选择开源?

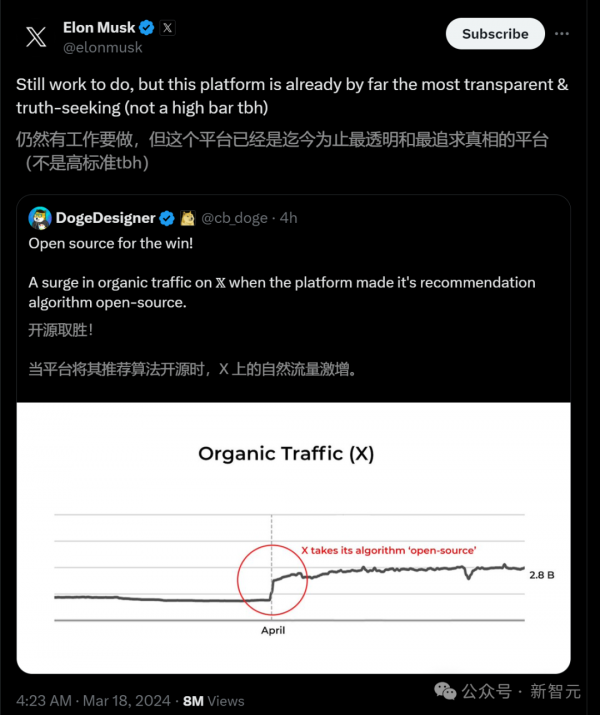

在数次嘲讽OpenAI是「CloseAI」之后,马斯克果真选择了开源自家大模型。

好文章,需要你的鼓励

谷歌将允许网站自主选择退出搜索AI模式与AI摘要功能

谷歌宣布将在Search Console中新增选项,允许网站发布者自主决定是否出现在AI Overviews、AI Mode及Discover中的AI摘要功能中。选择退出的网站将不再获得来自上述AI功能的流量和展示,但仍可正常出现在常规搜索结果中,且不影响搜索排名。此外,谷歌还将在Search Console中提供AI搜索相关数据统计,包括展示次数、出现页面及地区分布。该功能目前正在英国部分网站主中测试,后续将推广至全球。

当虚拟人物终于能“真实地打一拳“——来自耶路撒冷希伯来大学的4D人物动作仿真突破

耶路撒冷希伯来大学研究团队提出PhyGenHOI框架,将人体运动生成与物理仿真结合,让虚拟人物与三维物体之间的接触互动同时满足视觉自然性和物理真实性。

数据中心2026年6月最新建设动态

全球数据中心建设需求持续高涨。本月亮点包括:德克萨斯州超越北弗吉尼亚成为全球最大数据中心市场;SoftBank宣布在法国投资750亿欧元建设5GW数据中心;澳大利亚CDC数据中心签署该国史上最大555MW合同;东南亚方面,马来西亚、泰国大型AI数据中心项目密集落地。与此同时,多地在电网压力、环保审批及成本分摊等监管层面面临挑战。

弗莱堡大学等机构联合研究:让AI学会“立体思考“,彻底解决图像匹配中的左右不分难题

本文介绍了弗莱堡大学等机构提出的3D-SC框架,通过引入三维基础模型的几何先验,无需人工标注即可解决AI图像匹配中的左右混淆和重复部件分不清的问题。