诺贝尔物理学奖的跨界惊喜:当物理学和AI相遇

昨天下午,2024年诺贝尔物理学奖的揭晓,让我有点意外。

约翰·J·霍普菲尔德和杰弗里·E·辛顿这两位人工神经网络领域的先驱获奖,让这个奖项看起来像是“跨界操作”。

按传统观念,物理学奖项不应该颁给那些研究黑洞、超导、量子现象的科学家吗?

如今,却颁给了搞AI的专家,一时间让人觉得,物理学的边界在消失,甚至有人调侃说:“物理学都不存在了。”

不过,稍微回头想想,我觉得这背后其实有更深的含义。

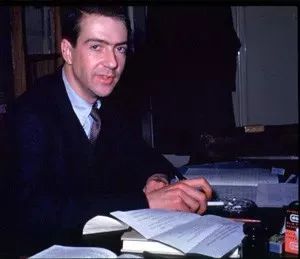

我们先来聊聊辛顿的故事。

他年少时并非什么神童,学习成绩也算不上顶尖,走了一条崎岖坎坷的学术道路。

曾就读于剑桥大学国王学院的他,没过多久就退学了。后来,他尝试过建筑学、哲学,甚至做过一年木匠。

这种对未来的“迷茫探索”我深有体会——不光是学科的选择,我们生活中也有许多这样的时刻,总感觉自己走错了路,觉得身边人都在更顺畅地奔向目标。

辛顿在自己的年轻岁月里四处碰壁,仿佛生活对他开了一个长长的玩笑。

指导他遇到了人工智能领域的导师 —— 神经网络

辛顿开始痴迷于研究“如何让机器像人类一样思考”。

然而在那个年代,人工智能还处在“冷宫”,尤其是神经网络的研究,几乎被学术界放弃,连他的导师都劝他别执着于这条死胡同。

辛顿却偏偏选择了一条少有人走的路——孤身一人守着这块几乎没人看好的研究领域。

说实话,当我读到这里时,我有点心疼辛顿的那份执着。

他一个人默默坚持着,顶着冷嘲热讽和学术界的质疑,一干就是30多年。

而辛顿这次获奖凭借的就是他在这几十年里的成果之一:1985 年提出的 “ 玻尔兹曼机 ” 。

玻尔兹曼机能够像人一样自主学习。比如你给它看不停地看很多狗子的帅照,就能生成一张新的?照。

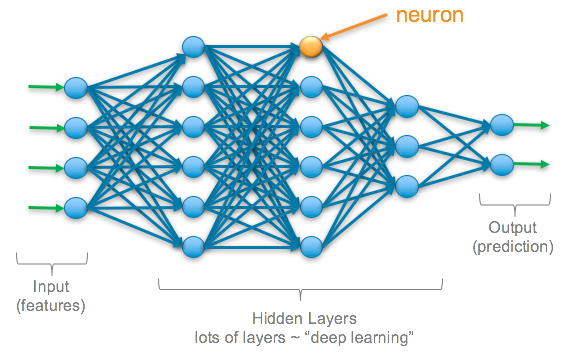

这也就是后来的深度学习、人工神经网络的雏形。

随着研究不断深入,辛顿也逐渐开创了一个新的学术分支:深度学习。

他的坚持,就像我们生活中的那些“偏执”的瞬间,那些不被看好的选择、那些旁人都说“你疯了”的坚持。

但正是这种偏执,最终改变了整个AI领域的格局。

几年后,辛顿的神经网络研究终于迎来了春天,深度学习在他的带领下迅速崛起。看看今天各大科技公司的AI实验室,几乎都是辛顿的弟子在掌舵。

这位被誉为“深度学习之父”的科学家,带着一帮学生们在AI这片领域重新夺回了“高地”,可谓大器晚成。

每次读到这些故事,总让我想起生活中那些曾让我们感到迷茫的选择。

有时,我们的坚持未必会立刻开花结果,但那股不肯放弃的劲头,终会在某个时刻绽放出光芒。

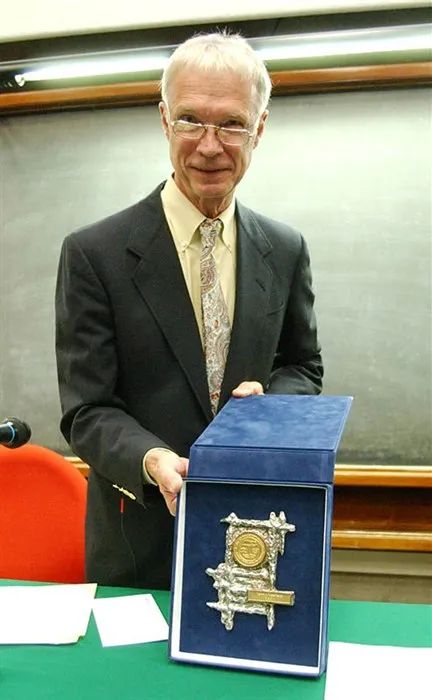

相比之下,霍普菲尔德的学术生涯显得“正统”得多。

他从芝加哥大学物理系一路念到博士,后来在贝尔实验室、NASA等研究机构任职,可谓一步一个脚印地按部就班。

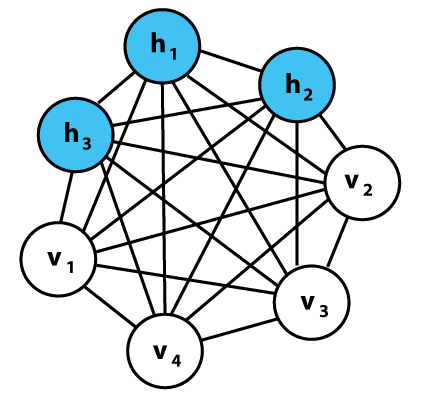

但他并没有因为所谓的“正统路径”而满足,反而在物理学与生物学、神经科学之间不断跨界,最终在1982年提出来的“霍普菲尔德网络”。

让AI变得有点像人脑那样会“想”了。

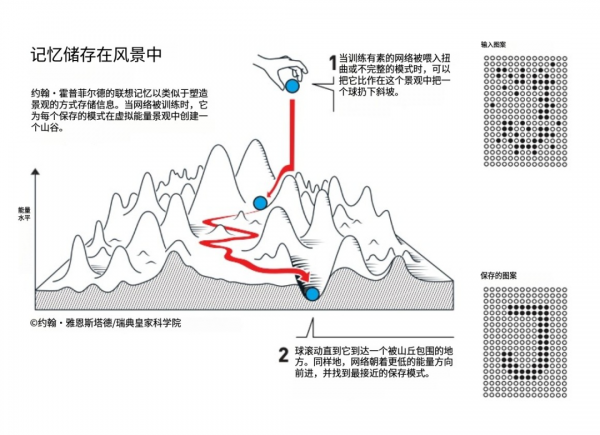

说白了,这玩意儿能让机器像人一样联想和记忆。你可以把它想象成,当你绞尽脑汁回忆某个生僻成语时,脑袋会先冒出它的近义词,然后“啪”的一下想起来完整的词语。

霍普菲尔德网络的原理差不多,给它一个不完整的信息,它就能把最匹配的记忆调出来。

更神奇的是,这东西还可以修复损坏的数据,甚至能去掉照片上的噪点。

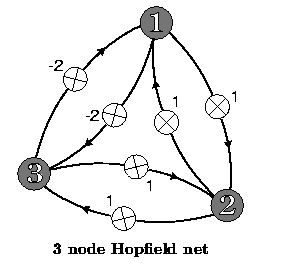

听起来好像和传统的物理学没啥关系,倒有点像纯粹的计算机黑科技。但实际上,霍普菲尔德网络的运行原理深植于物理学,尤其是统计力学。

网络的存储和检索机制利用了材料的物理特性,特别是原子自旋。你可以把原子自旋理解为每个原子都像一个微型小磁铁,它们彼此之间有不同的引力作用。

想象一下,这就像一片高低起伏的山脉,AI接收到新的信息时,就像有个小球在这片山地上滚动。小球会最终停在某个山谷中,而这个山谷对应的正是最接近的记忆或答案。

所以,霍普菲尔德网络的本质是在模拟物理系统中的能量最小化过程。

当AI处理信息时,它的目标是找到系统能量最低的状态,这个状态就代表了最匹配的存储模式。

这种方法不仅使AI更接近于人脑的记忆方式,还把物理学中的数学原理和计算机技术完美结合了起来,为未来的跨学科研究打开了新大门。

这种“跨学科”的尝试正是他获奖的原因,让AI不仅能够像人一样学习,还可以联想和记忆。

想想看,我们日常生活中有多少时候,会感到自己的身份或专业是个“牢笼”?

或许我们习惯了标签化地看待自己:我是理科生,所以搞不懂艺术;我是文科生,所以看不懂编程。

然而,正是霍普菲尔德和辛顿这样的科学家,让我们看到那些被人为设定的学科边界其实完全可以被打破。

物理学不仅仅是研究物质世界的定律,更是一种寻找真理的态度。

物理学不再只是显微镜下的粒子或天文望远镜中的星系,它还包括了我们如何看待信息、处理数据,以及让机器模仿人类的思考。

这种观念的转变,恰恰显示了科学的边界是不断向前推进的。

辛顿曾说,他对AI技术的飞速发展感到不安,因为这种智能有可能失控。

这位为深度学习奠基的科学家,在取得成功后,反而对自己的工作提出了最严厉的质疑。他甚至离开了谷歌,以便能够更自由地讨论AI的风险问题。

听到这里,我不禁感慨,有多少人能像辛顿那样,站在巅峰时仍然保持对未来的敬畏?这份对未知的恐惧与好奇,是他几十年来不曾改变的初心。

或许,这也是诺贝尔奖的真正意义——不仅在于奖励那些为人类做出杰出贡献的人,更在于鼓励每一位探索未知,坚持自我的勇士。

好了,今天就聊到这里。如果你觉得这篇文章有帮助,记得点赞、收藏、分享给朋友们哦!咱们下次见啦!

好文章,需要你的鼓励

腾讯开源混元MT翻译模型系列

腾讯今日开源混元MT系列语言模型,专门针对翻译任务进行优化。该系列包含四个模型,其中两个旗舰模型均拥有70亿参数。腾讯使用四个不同数据集进行初始训练,并采用强化学习进行优化。在WMT25基准测试中,混元MT在31个语言对中的30个表现优于谷歌翻译,某些情况下得分高出65%,同时也超越了GPT-4.1和Claude 4 Sonnet等模型。

如何让AI像电影配乐师一样创作完整的长篇音频故事——腾讯ARC实验室团队AudioStory突破性进展

腾讯ARC实验室推出AudioStory系统,首次实现AI根据复杂指令创作完整长篇音频故事。该系统结合大语言模型的叙事推理能力与音频生成技术,通过交错式推理生成、解耦桥接机制和渐进式训练,能够将复杂指令分解为连续音频场景并保持整体连贯性。在AudioStory-10K基准测试中表现优异,为AI音频创作开辟新方向。

Unity Stoakes谈科技、科学与设计的融合变革全球健康

今年是Frontiers Health十周年。在pharmaphorum播客的Frontiers Health限定系列中,网络编辑Nicole Raleigh采访了Startup Health总裁兼联合创始人Unity Stoakes。Stoakes在科技、科学和设计交汇领域深耕30多年,致力于变革全球健康。他认为,Frontiers Health通过精心选择的空间促进有意义的网络建设,利用网络效应推进创新力量,让企业家共同构建并带来改变,从而有益地影响全球人类福祉。

Meta与特拉维夫大学联手打造VideoJAM:让AI生成的视频动起来不再是奢望

Meta与特拉维夫大学联合研发的VideoJAM技术,通过让AI同时学习外观和运动信息,显著解决了当前视频生成模型中动作不连贯、违反物理定律的核心问题。该技术仅需添加两个线性层就能大幅提升运动质量,在多项测试中超越包括Sora在内的商业模型,为AI视频生成的实用化应用奠定了重要基础。