通义发布最强代码模型Qwen2.5-Coder,登顶全球开源代码模型王座

11月12日,阿里云通义大模型团队开源通义千问代码模型全系列,共6款Qwen2.5-Coder模型。相关评测显示,6款代码模型在同等尺寸下均取得了业界最佳效果,其中32B尺寸的旗舰代码模型在十余项基准评测中均取得开源最佳成绩,成为全球最强开源代码模型,同时,该代码模型还在代码生成等多项关键能力上超越闭源模型GPT-4o。基于Qwen2.5-Coder,AI编程性能和效率均实现大幅提升,编程“小白”也可轻松生成网站、数据图表、简历、游戏等各类应用。

编程语言是高度逻辑化和结构化的,代码模型要求理解、生成和处理这些复杂的逻辑关系和结构,通常也被认为是大模型逻辑能力的基础来源之一,对于整体提升大模型推理能力至关重要。Qwen2.5-Coder基于Qwen2.5基础大模型进行初始化,使用源代码、文本代码混合数据、合成数据等5.5T tokens的数据持续训练,实现了代码生成、代码推理、代码修复等核心任务性能的显著提升。

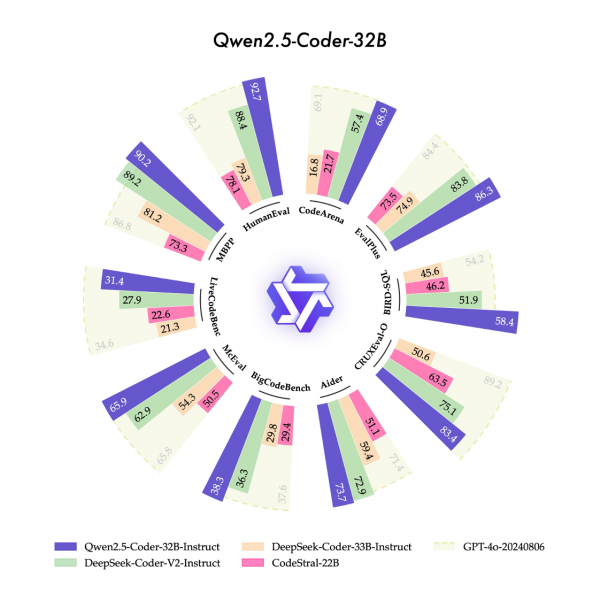

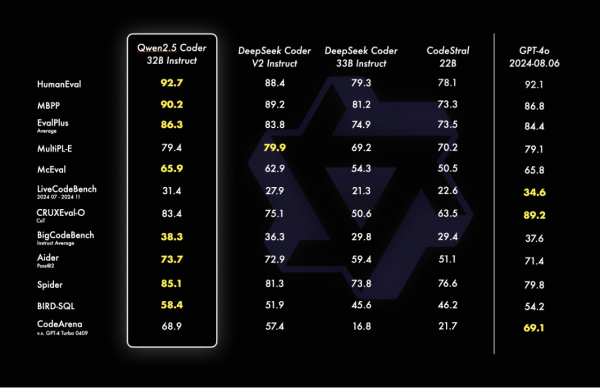

其中,本次新发布的旗舰模型Qwen2.5-Coder-32B-Instruct,在EvalPlus、LiveCodeBench、BigCodeBench等十余个主流的代码生成基准上,均刷新了开源模型的得分纪录,并在考察代码修复能力的Aider、多编程语言能力的McEval等9个基准上优于GPT-4o,实现了开源模型对闭源模型的反超。

在代码推理方面,Qwen2.5-Coder-32B-Instruct刷新了CRUXEval-O基准开源模型的最佳纪录。Qwen2.5-Coder-32B-Instruct在40 余种编程语言中表现优异,在McEval基准上取得了所有开闭源模型的最高分,并斩获考察多编程语言代码修复能力的MdEval基准的开源冠军。

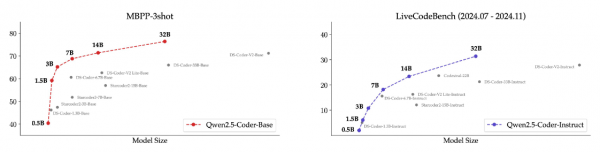

此次开源,Qwen2.5-Coder推出0.5B/1.5B/3B/7B/14B/32B 等6个尺寸的全系列模型,每个尺寸都开源了Base 和 Instruct 模型,其中,Base模型可供开发者微调,Instruct模型则是开箱即用的官方对齐模型,所有Qwen2.5-Coder模型在同等尺寸下均取得了模型效果最佳(SOTA)表现。

Qwen2.5-Coder全系列开源,可适配更多应用场景,无论在端侧还是云上,都可以让AI大模型更好地协助开发者完成编程开发,即便是编程“小白”,也可基于内置Qwen2.5-Coder的代码助手和可视化工具,用自然语言对话生成网站、数据图表、简历和游戏等各类应用。

截至目前,Qwen2.5已开源100多个大语言模型、多模态模型、数学模型和代码模型,几乎所有模型都实现了同等尺寸下的最佳性能。据了解,全球基于Qwen系列二次开发的衍生模型数量9月底突破7.43万,超越Llama系列衍生模型的7.28万,通义千问已成为全球最大的生成式语言模型族群。

好文章,需要你的鼓励

CVE Lite CLI:在AI加速编码时代,坚守无AI的安全扫描工具【正常】

在AI编程助手加速软件开发的背景下,OWASP旗下开源项目CVE Lite CLI另辟蹊径,坚持以确定性算法而非AI进行依赖漏洞检测。该工具专注于JavaScript和TypeScript本地锁文件分析,支持npm、pnpm和Yarn,能在开发者编写代码时即时发现依赖风险,而非等到CI流水线失败后才报警。工具提供直接与传递性漏洞分离、修复路径推荐等功能,现已成为OWASP官方项目。

瑞士联邦理工学院VITA实验室攻克“视频人物越跑越崩“难题,分钟级人物动画来了

EPFL团队提出EverAnimate,通过潜在空间直接传递记忆、训练模型主动纠正生成偏差,将AI人物动画稳定生成时长大幅延伸至分钟级。

WhatsApp Mac版将迎来Liquid Glass界面设计更新

Meta正推动WhatsApp的Liquid Glass设计风格向Mac端扩展。继上月对iOS用户更广泛推出该设计后,Mac版本目前仍处于开发阶段,尚未向测试用户开放。新界面包含重新设计的侧边栏、更新的聊天栏、附件菜单及专属锁定聊天区域。iPad版本也将在未来跟进,最终实现iPhone、iPad和Mac三端界面风格统一,带来一致的Liquid Glass视觉体验。

牛津大学团队为AI“扩散大模型“装上专属安全“刹车系统“,究竟是怎么做到的?

D?-Monitor是牛津大学等机构为扩散大语言模型设计的双层安全监测框架,利用去噪轨迹中的"犹豫"信号实现高效精准的安全分类,参数量不超过0.85M。

WhatsApp Mac版将迎来Liquid Glass界面设计更新

WWDC26 话题标签表情正式上线X平台,苹果发布会倒计时开启

丰田终止雷克萨斯LF-ZC电动轿车开发计划

德克萨斯州再添大型太阳能农场,ERCOT电网需求持续攀升

沃尔沃CE与日立能源携手推进零排放施工现场建设

芯存远见,轻启未来:华邦电子重塑可穿戴设备设计效率

立中集团泰国第三工厂扩产铝合金车轮,800 万只铸造产能接近成形

西部数据亮相 2026 台北国际电脑展:AI 不仅依托算力,更依赖数据运行

SAP 2026年蓝宝石大会:CEO承认AI战略曾走弯路,全面转向业务自主化【正常】

NHS单一患者电子档案或每年减少两万次急诊就诊并节省两千万英镑【正常】

苹果智能眼镜据报道推迟至2027年底发布

2026年第一季度Mac恶意软件威胁态势全面回顾【正常】