国内唯一,阿里千问斩获NeurIPS 2025最佳论文奖

11月27日,人工智能领域顶级会议NeurIPS 2025公布了论文奖,阿里通义千问团队在注意力机制上的研究成果从全球5524篇论文中脱颖而出,被评为最佳论文,是唯一获得该奖项的中国团队。该论文首次在业内揭秘了注意力门控对大模型性能和训练的影响,据悉,该研究成果已应用于Qwen3-Next模型,并显著提升模型的性能与鲁棒性。

阿里通义千问研究成果被评为NeurIPS 2025最佳论文

门控是大模型应用最广泛的技术之一,它可以作为模型的“智能降噪耳机”,帮助模型过滤无效信息从而提升模型性能。近年来,AlphaFold2、Forgetting Transformer等学术界和工业界模型开始探索将门控和注意力机制结合,但都对门控在注意力机制中有效的原因缺乏探索,也没有大规模实践的经验。

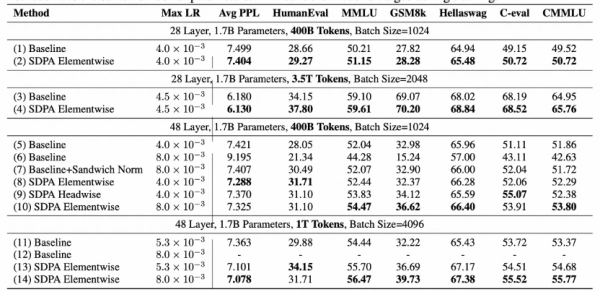

此次,通义千问团队通过在1.7B稠密模型(Dense)与15B混合专家模型(MoE)上训练超过 3.5 万亿 token,并对比 30 余组控制实验,首次清晰揭秘了其背后的原理,并展现了在注意力中使用门控形式最有效的方式及扩展成功实践。

注意力头是注意力机制中的基本计算单元。实验结果显示,对各注意力头的输出进行门控,是提升模型性能最有效的方式。使用该方式,在引入额外1%参数、计算开销增加低于2%的情况下,可以实现0.2以上的困惑度下降、MMLU基准评测2个点的提升。研究还发现,该技术还能在更大规模的模型训练上实现更好的性能。

使用论文方法,在引入额外1%参数、计算开销增加低于2%的情况下,可以实现0.2以上的困惑度下降、MMLU基准评测2个点的提升

更深入的分析发现,注意力门控还解决了大模型长期存在的两大问题:注意力池(Attention Sink),即少量特殊token计算中产生很大的输出值、占据很高的注意力分数;巨量激活(Massive Activation),即模型激活中出现大于中位数数千倍的离群值。上述两个现象都容易在BF16等低精度训练中引发数值误差,影响训练稳定与低精度部署。该研究显示,门控注意力将首token的注意力占比从 46.7%降至4.8%,同时将最大激活值从1053降至94。

目前,该技术方案、实验模型及产品级模型均已开源。NeurIPS评审委员会表示:“我们认为该方法将被广泛采用,这项工作将极大推动社区对大语言模型中注意力机制的理解。”

通义千问团队表示:“对门控机制、模型机制等的深入理解,不仅为大语言模型架构设计提供了新思路,也为构建更稳定、更高效、更可控的大模型奠定了基础。”

据悉,目前阿里千问已开源300多款模型,涵盖全模态、全尺寸,全球下载量突破7亿次,衍生模型超过18万个,位居全球第一。

好文章,需要你的鼓励

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

今天讲的出海案例是明阳电气,这家输配电设备公司在马来西亚投产首个海外生产基地,并以 250 万林吉特子公司承接本地制造。

花大钱买快马,却发现马跑不起来——KAIKAKU研究机构揭露AI推理硬件的“性价比陷阱“

研究发现AI推理中显卡内存带宽并非唯一瓶颈:H100仅发挥27%内存带宽,而L4达81%,量化工具选择比显卡升级更关键。

海亮股份美国得州铜基材料基地扩产,23个生产基地接住AI液冷订单

今天讲的出海案例是海亮股份,这家铜管、铜棒和铜箔企业把美国得州基地做到扭亏,并用全球23个生产基地承接AI液冷和高端铜材需求。

无人机车队“接力跑“——塞浦路斯大学团队如何让多架无人机协同追踪城市车辆、实现近乎完美的身份传递

塞浦路斯大学研究团队提出拓扑感知时空接力框架,利用车辆行驶的物理规律替代外观识别,实现多无人机协同追踪城市车辆时99.8%的全局身份传递成功率。

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

海亮股份美国得州铜基材料基地扩产,23个生产基地接住AI液冷订单

SAP 全球 CEO 柯睿安署名文章:软件正迈入最强大的时代

中国 AI 价值攀升,采用率与智能体 AI 预期双重驱动——《2026 SAP AI 价值报告》

Mac出现卡顿或性能下降?AI照片扫描或是幕后元凶

苹果欧洲首个开发者中心即将亮相,内部抢先看

电动自行车真的能省钱吗?算笔账就清楚了

卡特彼勒BEPU电池电力单元:像换发动机一样轻松完成电动化改装

Meta追赶AI竞争对手的内部努力

苹果需要在WWDC发布下一代Siri,为未来设备提供AI支撑

谷歌测试新功能,允许网站选择退出AI搜索展示

Meta Business智能体现已面向全球WhatsApp商业用户开放