高产的阿里!Qwen1.5系列再次更新:阿里开源320亿参数Qwen1.5-32B,评测超Mixtral MoE,性价比更高!

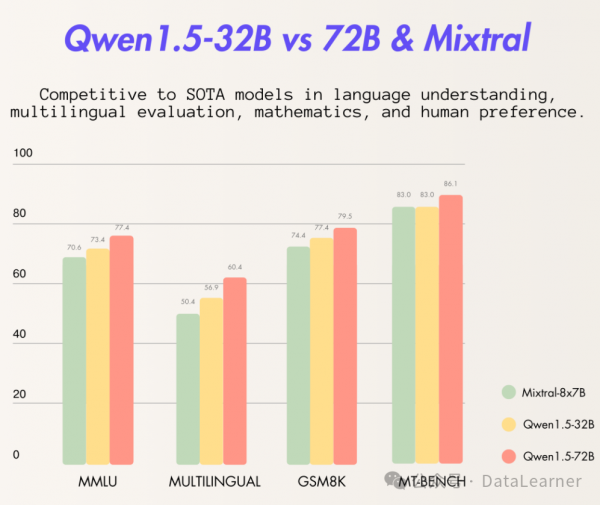

阿里巴巴最新开源了320亿参数的大语言模型Qwen1.5-32B,这个模型在各项评测结果中都略超此前最强开源大模型Mixtral 8×7B MoE,比720亿参数的Qwen-1.5-72B模型略差。但是一半的参数意味着只有一半的显存,这样的性价比极高。

-

Qwen1.5-32B简介

-

Qwen1.5-32B模型的评测结果

-

Qwen1.5-32B模型的上下文长度

-

Qwen1.5-32B模型的开源地址和演示地址

Qwen1.5-32B简介

Qwen系列大语言模型是阿里巴巴开源的一系列大语言模型,在各项评测和应用中都取得了非常好的效果,也引起了非常多的人的关注。而且Qwen系列模型不仅仅是在国内很有名,在全球的大模型开源领域都有着很好的吸引力。本次开源的320亿参数模型是最新的一个。

Qwen1.5可以理解为Qwen2的beta版本,在此前开源了6个不同参数规模的Qwen1.5模型,最小的只有5亿参数,最大的是720亿参数。其中,Qwen1.5-72B是目前MT-Bench测评中仅次于GPT-4的模型,也是开源模型中得分最高的模型(MT-Bench采用了真实的多轮对话数据集)。而在匿名投票评测中(LMSYS推出的Areno评测系统,该评测为用户提供不同模型的匿名回复,由用户投票谁好谁好),Qwen1.5-72B也是开源模型中最强的。

不过720亿参数的Qwen1.5-72B的半精度模型需要144GB显存才能载入,单个显卡无法使用,因此很多人也无法体验。而此次发布的Qwen1.5-32B模型的参数只有Qwen1.5-72B模型参数的一半,显存也只有它的一半。官方提供的Int4版本模型仅需要20G显存,可以在4090显卡上推理,但实测速度较慢!。所以,消费级显卡在做这种规模参数模型的推理上还是比较差的。

而从评测结果看,Qwen1.5-32B比Qwen1.5-72B性能损失很小,而显存降低了一半,所以非常有性价比。

阿里巴巴官方说,最近几个月,通义千问模型在后训练上取得了进展,即在基于人类反馈的强化学习对齐训练方面有了很好的进步。而这个Qwen1.5-32B模型就是这个进步的成果。而Qwen1.5-32B模型本身和其它1.5版本的Qwen模型架构没有区别,不过多了一个 grouped query attention (GQA),因此,推理的效率应该更高。

官方发布的Qwen1.5-32B包含5个版本:

Qwen1.5-32B模型的评测结果

根据官方的描述,Qwen1.5-32B模型在300亿参数规模的模型中评测中非常靠前。虽然不能说第一,但各项成绩都很优秀。

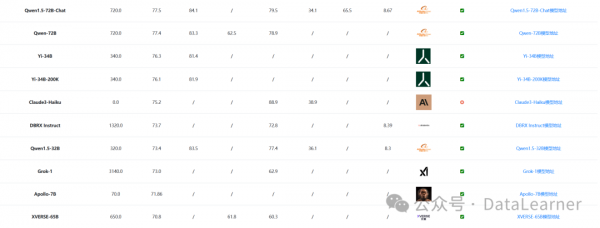

而根据DataLearnerAI收集的全球主流模型评测结果上,Qwen1.5-32B接近此前发布的DBRX模型( https://www.datalearner.com/ai-models/pretrained-models/DBRX-Instruct ),这是一个1320亿参数的MoE模型(激活时使用360亿参数):

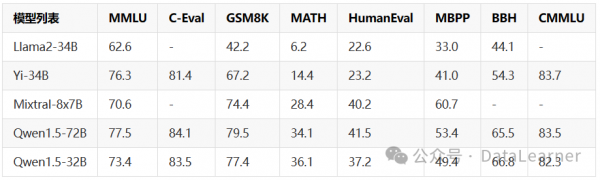

上图是按照MMLU评分从上往下排序的结果。从上图可以看到,Qwen1.5-32B超过了Grok-1,略低于DBRX模型。但是总体上比李开复旗下公司开源的Yi-34B也要略差。详细的数据如下:

尽管综合理解能力MMLU得分,Qwen1.5-32B并不算优秀,但是涉及到推理和数学方面(GSM8K、Math),则比其它300亿参数模型提升明显,只是略低于Qwen1.5-72B模型。

Qwen1.5-32B模型的上下文长度

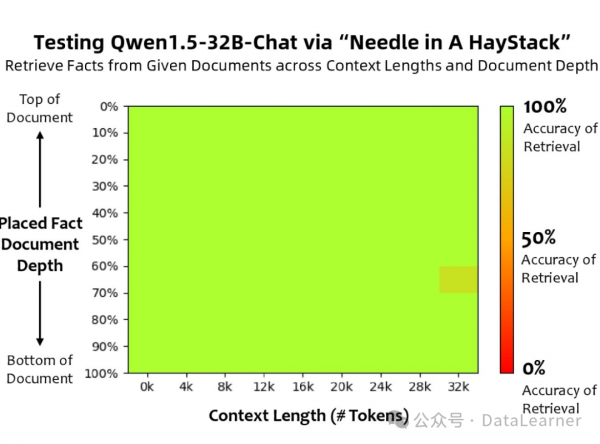

官方提到了它支持32K上下文长度输入,在“大海捞针”测试中表现很好。

Qwen1.5-32B模型的开源地址和演示地址

Qwen1.5-32B模型本身以通义千问的开源协议开源,允许商用,也有在线测试,具体开源地址和在线测试地址参考DataLearnerAI的Qwen1.5-32B模型信息卡:https://www.datalearner.com/ai-models/pretrained-models/Qwen1_5-32B

来源:DataLearner

好文章,需要你的鼓励

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

企业谈AI基础设施时,注意力往往首先集中在模型、GPU和算力集群上。但当大模型应用走向规模化推理,一个瓶颈开始浮现:算力采购完成,并不意味着Token能够被稳定、低成本、可控地交付出去。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。