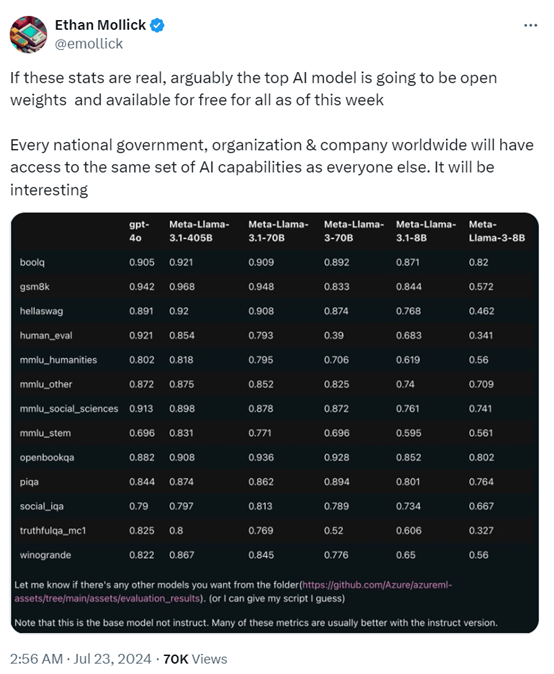

MetaЕФLlama-3.1-405BдтаЙТЉЃЌПЩЯТдиЃЌадФмГЌGPT-4oЃЁ

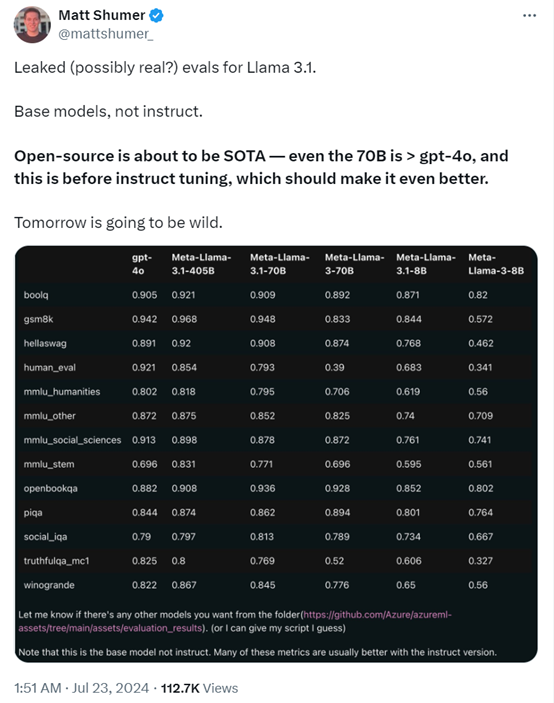

7дТ23ШеСшГПЃЌгаШЫБЌСЯЃЌMetaЕФLlama 3.1-405BЦРВтЪ§ОндтгіаЙТЉЃЌУїЬьПЩФмЛсЗЂВМLlama 3ЯЕСажазюДѓЕФВЮЪ§ФЃаЭЃЌЭЌЪБЛЙЛсЗЂВМвЛИіLlama 3.1-70BАцБОЁЃ

етвВЪЧдк3.0АцБОЛљДЁжЎЩЯНјааСЫЙІФмЕќДњЃЌМДБуЪЧ70BЕФЛљДЁФЃаЭЕФадФмвВГЌЙ§СЫGPT-4oЁЃ

ОЭСЌДХСІСДНгЖМСїГіРДСЫЃЌЪдСЫвЛЯТДѓдМга763.84GЁЃБОРДhuggingfaceЩЯвВгаЕФЃЌКѓРДПтБЛЩОГ§СЫЁЃ

ДХСІЕижЗЃКMagnet: magnet:?xt=urn:btih:c0e342ae5677582f92c52d8019cc32e1f86f1d83&dn=miqu-2&tr=udp%3A%2F%http://2Ftracker.openbittorrent.com%3A80

ЯТдиЫйЖШвВЛЙПЩвдЃЌУПУы14MзѓгвЃЌПДРДШЗЪЕЪЧгаВЛЩйШЫдкЯТетИіФЃаЭЁЃ

ЕЋетИіФЃаЭвЛАуЕФGPUПЯЖЈЪЧХмВЛЦ№РДЃЌШчДЫДѓЕФВЮЪ§дкВПЪ№ЗНУцИіШЫПЊЗЂепвВИКЕЃВЛЦ№ЃЈШчЙћФугавЛаЉH100вВУЛЮЪЬтЃЉЃЌЙРМЦЪЧИјЦѓвЕЁЂеўЮёЙЋЙВВПУХгУЕФЁЃ

ЖдгкMetaМДНЋЗЂВМЕФФЃаЭЃЌОЭгаЭјгбЦУРфЫЎЁЃЯрБШOpenAIзюаТЕФGPT-4o miniАцБОЃЌLlama 3.1-70BЭЦРэГЩБОЬсЩ§СЫ3БЖЃЌЕЋБрТыЕФадФмШДвЊВюКмЖрЁЃ

ДгадМлБШЁЂЙІФмРДПДЃЌMetaЕФаТФЃаЭвВУЛЪВУДжЕЕУЦкД§ЕФЁЃ

ЛЙгаШЫЩѕжСдкGitHubЩЯПДЕНСЫЩЯЪіЗЂВМЕФФЃаЭЃЌЕЋКмПьОЭФУЯТРДСЫЃЌЙРМЦгавЛаЉШЫПЩФмвбОФмЪЙгУСЫЁЃ

вВгаШЫБэЪОЃЌЖдгкетИіаЙТЉЪТМўЫћШЯЮЊЪЧецЕФЃЌвђЮЊетЪЧДгЮЂШэЕФAzure GithubСїГіРДЕФЁЃ

ЕЋЪЧетИіФЃаЭВЮЪ§НЯДѓЃЌЖдGPUЕФвЊЧѓЬЋИпСЫЃЌВЛШчGPT-4o miniадМлБШИпЁЃ

ЫфШЛФЃаЭЪЧУтЗбЕФЃЌЯыдЫааЦ№РДЛЙЪЧЯрЕБЗбОЂЕФЃЌУЛгаЦѓвЕМЖЕФЫуСІЛљДЁецЕФЮоЗЈЪЙгУЁЃЫљвдЃЌетЖдгкЦѓвЕРДЫЕЪЧвЛИіВЛДэЕФКУЯћЯЂЁЃ

гаШЫжИГіМДБуЖдLlama 3.1-405BФЃаЭНјааДѓЗљЖШгХЛЏЃЌСПЛЏЕН5ЮЛЪ§ЃЌШдШЛЮоЗЈЪЪгУгкЯћЗбМЖGPUЃЌецЕФЪЧЖдгВМўвЊЧѓЬиБ№ИпЁЃ

ШчЙћетЗнЦРВтЪ§ОнЪЧецЕФЃЌФЧУДЖдгкШЋЧђЖрЪ§ЙњМвРДЫЕЖМЪЧвЛИіЬьДѓЕФИЃРћЁЃвђЮЊетЪЧMetaЕФLlama 3ЯЕСаЕФЖЅМЖФЃаЭВЂЧвЪЧШЋВППЊЗХШЈжиЃЌвВОЭЪЧЫЕШЫШЫЖМФмгУЩЯУтЗбЕФAIФЃаЭЁЃ

ЕЋЪЧШчЙћЯыПЊЗЂЩњГЩЪНAIгІгУЃЌвВашвЊЧПДѓЕФAIЫуСІЛљДЁЁЂИпжЪСПЪ§ОнвдМАЮЂЕїММЪѕЁЃ

гЩгкМрЙмЛњЙЙКЭИїжжЗЈАИЕФдвђЃЌMetaвЛжБдкЭЦГй405BЯЕСаФЃаЭЕФЗЂВМЁЃФЧУДЃЌБОДЮаЙТЉЪЧЗёЪЧMetaЬивтЗХГіРДЕФФиЃЌвђЮЊетЪЧЫћУЧЕФРЯДЋЭГСЫЃЌШЅФъЕФLlamaФЃаЭОЭИЩЙ§вЛДЮЁЃ

РДдДЃКAIGCПЊЗХЩчЧј

КУЮФеТЃЌашвЊФуЕФЙФРј

УїбєЕчЦјТэРДЮїбЧЪзИіКЃЭтЩњВњЛљЕиЭЖВњЃЌЪфХфЕчЩшБИПЊЪМБОЕижЦдь

НёЬьНВЕФГіКЃАИР§ЪЧУїбєЕчЦјЃЌетМвЪфХфЕчЩшБИЙЋЫОдкТэРДЮїбЧЭЖВњЪзИіКЃЭтЩњВњЛљЕиЃЌВЂвд 250 ЭђСжМЊЬизгЙЋЫОГаНгБОЕижЦдьЁЃ

ЕБAIЫбЫїдБдНЖСдНЖрЃЌЗДЖјдНЖСдНУЩЃКUC San DiegoЕШЛњЙЙНвЪОЁАЦСБЮОЩаХЯЂЁАЕФвўВиЙцТЩ

баОПНвЪОAIЫбЫїДњРэ"ЦСБЮОЩЙлВт"ВпТдЕФаЇЙћШЁОігкМьЫїжЪСПгыФЃаЭФмСІЕФЦЅХфГЬЖШЃЌДцдкШ§жжНиШЛВЛЭЌЕФаЇЙћЧјМфЁЃ

Ъ§бЇМвЗЂГіОЏИцЃКAIе§ЭўаВЪ§бЇбаОПЕФзджїадгыбЇЪѕБъзМ

Ъ§бЇНчЗЂВМЁЖРГЖйаћбдЁЗЃЌгЩ16ЮЛбаОПШЫдБРњЪБ8ИідТЦ№ВнЃЌвбЛёЙњМЪЪ§бЇСЊУЫБГЪщЁЃаћбджИГіЃЌAIе§ЭўаВЪ§бЇбаОПЕФКЫаФМлжЕЃКAIЩњГЩЕФДэЮѓжЄУїФбвдЪЖБ№ЁЂТлЮФв§гУВЛЙцЗЖЁЂАцШЈељвщЦЕЗЂЁЂПЦММЙЋЫОжїЕМбаОПвщЬтЃЌвдМАЦѓвЕНшаТЮХИхЧРеМЛАгяШЈЕШЮЪЬтШевцбЯОўЁЃаћбдКєгѕЪ§бЇМвЭИУїХћТЖAIЪЙгУЧщПіЃЌНЈвщМрЙмЛњЙЙБЃЛЄзїепШЈРћВЂЙцЗЖAIВњвЕЃЌЭЌЪБОЏИцИїЗНВЛвЊЧсаХПЦММЙЋЫОЖдAIФмСІЕФПфДѓаћДЋЁЃ

ЛњЦїШЫЁАЬ§ЖЎЁАжИСюШДВЛжЊЕРИУзЅФФИіЁЊЁЊЙўЙЄДѓЕШЛњЙЙСЊКЯНвЪОVLAФЃаЭЕФжТУќЖЬАх

ЖрЫљИпаЃгыбаОПЛњЙЙСЊКЯЙЙНЈЛњЦїШЫгявхНгЕиВтЪдЦНЬЈRSBЃЌЗЂЯжжїСїVLAФЃаЭЦеБщДцдк"ФмзЅЕЋзЅДэ"ЕФжТУќШБЯнЃЌгявхРэНтгыЖЏзїЩњГЩжЎМфДцдкбЯжиЖЯВуЁЃ