o1 模型在“医学领域”表现如何?研究人员进行了初步研究:AI 医生离我们更近了

OpenAI的o1模型,作为首个采用强化学习策略内化思维链(chain-of-thought)技术的LLM,已经在各种通用语言任务上展现出超凡的能力。

然而,它在医学等专业领域的性能仍然是一个未知数。为了探索这一问题,研究人员进行了一项初步研究,以评估o1在不同医学场景下的表现。

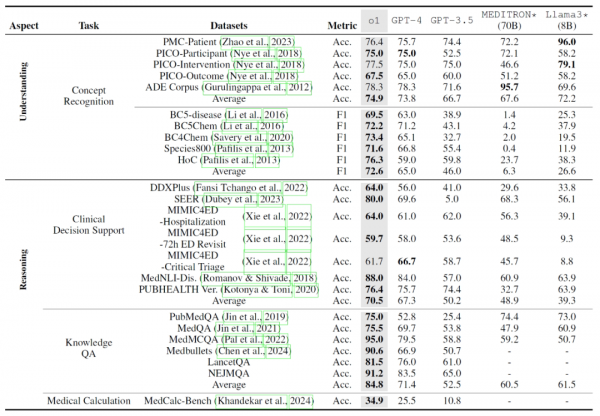

研究聚焦于o1模型在医学领域的三个关键方面:理解力、推理能力和多语言能力。为了确保评估的全面性,研究者们收集了35个现有的医学数据集,并开发了2个基于《新英格兰医学杂志》和《柳叶刀》的专业医学测验的新问答数据集,这些数据集被用于6个不同的任务中。

在理解力方面,评估包括概念识别和文本摘要任务。推理能力的测试更为复杂,它包括知识问答、临床决策支持和代理任务。多语言能力的评估则检查模型处理非英语医学问题的能力。这包括使用多种语言的问答任务,以及在中文医疗代理任务中模拟医疗互动。

为了衡量模型在这些任务上的表现,研究者们采用了多种评估指标。准确率直接衡量模型生成的答案与真实答案匹配的程度。F1分数则用于评估模型在需要选择多个正确答案的任务上的性能。BLEU和ROUGE指标用于评估生成文本与参考文本之间的相似度。AlignScore和Mauve指标则用于评估模型生成文本的事实一致性和自然度。

在实施评估时,研究者们探索了三种提示策略:直接提示、思维链提示和少量示例提示。他们选择了几种不同的模型进行比较,包括GPT-3.5、GPT-4以及开源模型MEDITRON-70B和Llama3-8B。实验涉及到多个医学任务,如问答、文本摘要、概念识别等,并使用了相应的数据集来评估模型在每个任务上的表现。

实验结果显示,o1模型在多数医学任务上都展现出了优越的性能。

在理解医学概念方面,o1在多个概念识别数据集上的表现超过了其他模型,在BC4Chem数据集上,o1的平均性能提升达到了24.5%。

在推理能力方面,o1在新构建的NEJMQA和LancetQA问答任务上取得了显著的准确率提升,o1的平均准确率分别比GPT-4高出8.9%和27.1%。

此外,o1在多语言医学问答任务中也展现了强大的能力,但在复杂的中文医疗代理任务中,其性能却有所下降。

研究人员也发现了一些局限性。o1在多个医学任务上表现出色,但其较长的解码时间可能导致在需要快速响应的临床环境中的实用性受限。此外,模型在处理复杂的中文医疗代理任务时性能有所下降,在处理复杂的多语言医学案例时仍面临挑战。

研究人员还发现,传统的评估指标如BLEU和ROUGE,无法充分捕捉到模型在医学领域的表现,需要开发更加精确的评估工具,以便更好地衡量和理解模型在复杂医学任务中的表现。

研究人员认为,尽管o1在某些方面仍有不足,但其在多个医学任务上展现出的能力表明,我们离实现AI医生的目标已经越来越近。然而,为了实现这一目标,还需要在模型性能、评估指标和用户指导策略等方面进行更多的研究和改进。

好文章,需要你的鼓励

谷歌免费存储空间调整:未绑定手机号仅享5GB

谷歌近期悄然调整账户存储政策:新注册用户若未绑定手机号,免费存储空间将从原来的15GB缩减至5GB。用户需验证手机号后,方可获得完整的15GB空间,用于Gmail、Drive和Photos的共享使用。谷歌表示,此举旨在确保存储空间"每人仅限一份",有效防止滥用。有分析认为,存储硬件成本上升也是推动此次政策调整的重要原因之一。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

美国三大运营商携手卫星技术,向信号盲区宣战

AT&T、Verizon和T-Mobile宣布计划组建合资企业,利用卫星技术消除美国境内的网络覆盖盲区,重点服务农村及网络欠发达地区。该合资企业将整合知识产权与地面频谱资源,推动下一代直连设备(D2D)通信发展。目前三方尚未签署正式协议,现有运营商与卫星服务协议不受影响。此前,T-Mobile已与SpaceX合作推出星链卫星服务,美国联邦通信委员会也刚批准了价值400亿美元的EchoStar频谱出售案。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。