蚂蚁数科 CTO 王维:更好的通用 AGI 仍在路上,AI 亟待提升专业性和可信性

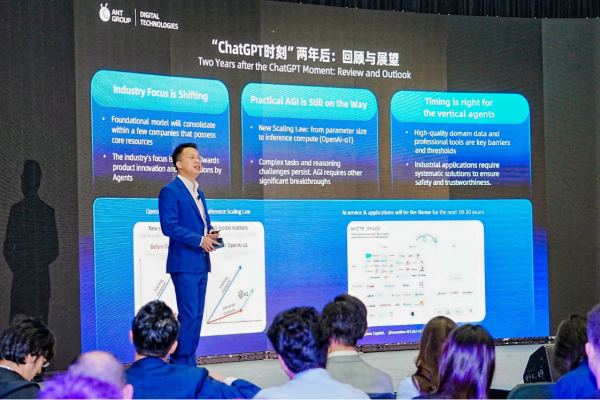

“大模型的应用从‘上新品’逐渐进入‘强应用’阶段,更好的通用人工智能仍在路上。”10 月 29 日,蚂蚁数科CTO王维在香港金融科技周2024 分享时指出。

两年前,大语言模型(LLM)的出现,引发了全球科技从业者的普遍关注和行业热潮。ChatGPT 月活用户数以史上最快速度达到 1 亿,AI 行业迎来“ChatGPT时刻”。经过一段时间的狂奔,LLM性能阶段性趋于饱和,大模型底层推动力逐渐收敛到少数拥有核心数据及算力资源的公司,行业注意力也更多转到了以Agent为代表的行业应用侧。

如何解放 LLM 应用的局限性。王维强调,高质量的行业数据和专业工具是 AI 继续发展的关键壁垒和门槛,行业应用需要系统性地解决专业严谨和安全可信等问题。蚂蚁数科“蚁天鉴”产品,集大模型安全测评与防御为一体,让大模型在生产和使用过程中更安全、可控、可靠。

他认为,高质量数据可以更好地模拟客观世界,提升模型的准确性和稳定性。过去十年,伴随着AI发展的范式转移,对数据的要求也在持续改变。机器学习从“以模型为中心”转向“以数据为中心”。在当下的 LLM时代,行业应用要做到安全可信,其核心是如何结合专业人工+AI算法的高效标注,产生高质量的标注数据。

而面向未来的AGI时代,随着互联网公开数据逐步耗尽,以及GPT-o1带来的强化学习训练新范式,都预示着数据合成的重要性进一步提升。王维指出,如何通过仿真引擎、自博弈(self-play)强化学习的方式,合成出更多互联网所不覆盖的高质量、高价值领域数据,将是到达AGI时代的关键。

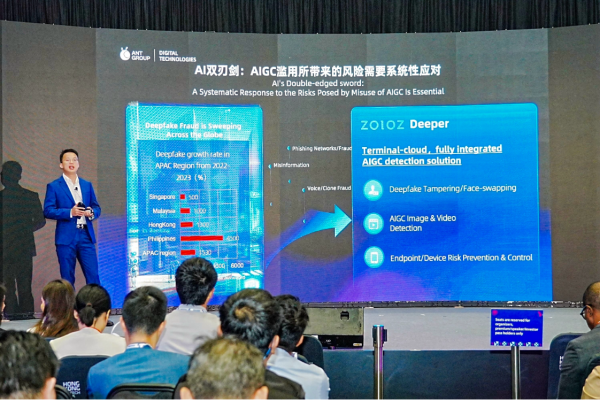

他也提醒道,AI 是把双刃剑,AIGC滥用所带来的风险需要系统性应对。不久前,“AI 教父” 杰弗里·辛顿(Geoffrey E. Hinton)在采访中再次强调了其对AI安全问题的强烈担忧。他与另外两位图灵奖得主约书亚·本吉奥(Yoshua Bengio)、姚期智及来自世界各地的几十位科学家共同签署了一封公开信——“AI 安全国际对话威尼斯共识”,呼吁为推动人工智能的发展制定更好的保障措施。

他们在公开信中警告道,“随着人工智能的快速发展,这些‘灾难性的结果’随时可能发生。”究其问题根源,在于 AIGC 的滥用不仅会产生虚假信息和网络钓鱼攻击,还可能引发全球性的诈骗活动。其中,值得关注的一大风险来源便是Deepfake, 即基于深度学习算法,从大量的视频和图像数据中学习,伪造出逼真的面部动画和语音。

王维介绍,蚂蚁数科旗下身份安全品牌 ZOLOZ 为此专门研发了综合防控产品 ZOLOZ Deeper,以应对在开户、登录、支付等各种场景的深度伪造风险。在服务印尼某头部银行后,产品上线一个月时间内实现了 Deepfake 风险“0 漏过”。

好文章,需要你的鼓励

Aqara Hub M200为HomeKit带来Matter支持和新自动化选项

Aqara Hub M200是进入Aqara生态系统的新入口,作为支持Matter的Zigbee 3.0中枢,可将传感器、开关、按钮等配件通过Matter共享到HomeKit。相比Hub M3设计更紧凑,支持2.4和5GHz双频Wi-Fi。M200充分利用Zigbee协议的低成本优势,让用户以更实惠的价格构建智能家居,同时享受完整的HomeKit功能。对于HomeKit用户来说,这是一个稳定可靠的桥接方案。

腾讯AI实验室新突破:让AI像专家一样精准理解和编辑复杂图片

腾讯AI实验室联合港校提出RePlan框架,解决复杂图像编辑中的指令理解和精确定位难题。该方法采用"计划-执行"架构,让视觉语言模型先推理制定区域级编辑计划,再通过创新的注意力机制精确执行。仅用1000个样本训练就超越了大规模数据训练的模型,在新建的IV-Edit基准上表现出色。

LG智能电视强制安装Copilot快捷方式引发用户不满

LG电视通过系统更新强制安装微软Copilot快捷方式引发争议。虽然LG承诺将允许用户删除该图标,但仍计划在webOS系统中深度整合Copilot功能。三星等厂商也在推进类似AI功能。专家指出,智能电视内置聊天机器人会增加隐私追踪的复杂性,加剧系统臃肿问题。当前智能电视行业正通过用户追踪和广告实现软件盈利,消费者应关注隐私保护问题。

AI机器人终于学会了“立体视觉“:香港科技大学团队让计算机像人类一样理解3D世界

这项由香港科技大学等机构联合完成的研究首次让AI获得了原生的3D空间理解能力。N3D-VLM系统能够像人类一样准确感知物体的立体位置关系,先精确定位物体的3D边界框,再进行空间推理。研究团队还开发了巧妙的数据生成方法,将2D标注转换为278万个3D样本,并构建了全新的N3D-Bench测试基准。实验显示该系统在空间推理任务上准确率超过90%,远超现有方法,为机器人、自动驾驶等领域提供了重要技术突破。

千问C端事业群成立后首推平价AI眼镜:低至1999元,搭载千问AI助手

Aqara Hub M200为HomeKit带来Matter支持和新自动化选项

LG智能电视强制安装Copilot快捷方式引发用户不满

Palo Alto Networks与谷歌云签署数十亿美元AI合作协议

OpenAI 获百亿美元融资与AI投资热潮持续升温

Meta计划2026年发布新一代图像视频AI模型

数字孪生联盟推出四个全新测试平台

BT:英国量子技术发展下一阶段取决于网络建设

Kodiak AI利用自动驾驶技术和物联网连接变革货运行业

Oracle和OpenAI数据中心项目获密歇根州监管机构批准

Optera室温光谱烧孔光学存储技术突破

英特尔助火山引擎“优化”AI云技术内核

最热门的 AI 模型:它们的功能和使用方法

这款古怪的 AI 智能手机可以创建你的数字分身

Faireez 获 750 万美元融资,为租赁市场提供 AI 驱动的酒店式管家服务

Broadcom 大获全胜:70% 大型 VMware 客户购买其最全面解决方案

Peer 获得1050万美元元宇宙引擎投资,推出3D个人星球功能

获 3000 万美元融资,Crogl 发布面向安全分析师的全新 AI "钢铁侠战衣"

Turing 获得 1.11 亿美元融资,估值达到 22 亿美元,为 OpenAI 等大语言模型公司提供关键代码支持

Tavus 推出系列 AI 模型,实现实时人脸交互技术突破

Welevel 获得 570 万美元融资,革新程序化游戏开发

AI 驱动的卓越运营:企业如何通过人人可及的流程智能提升成功