Kimi 发布视觉思考模型 k1

关于「Kimi 视觉思考版」这一强化学习下的新势力选手:可以完整呈现推理思维链CoT,让用户不只看到答题结果,也能完整看到模型思索答案的全过程。

再概括下 k1 视觉思考模型的训练过程

1、训练阶段划分:本质上还是预训练及基于预训练模型后的强化学习后训练,这两个阶段

2、基础模型特点

- 重点优化字符识别能力

- 在多个基准测试集上取得卓越成绩:如OCRBench:903分(SOTA);

3、强化学习后训练 - 划重点:强化学习后训练在数据质量和学习效率方面做了进一步优化

4、科学测试集创新

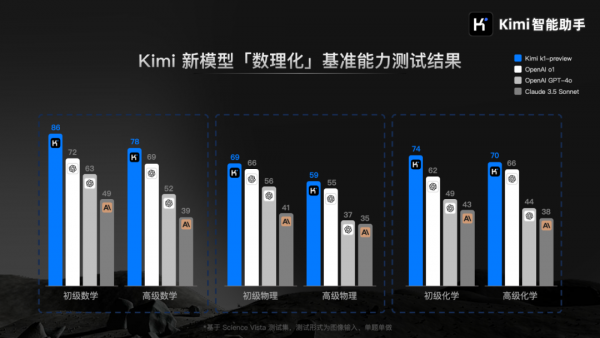

- 自主构建 Science Vista 测试集:覆盖不同难度的数理化图片题目;其分布与用户需求匹配

以下是Kimi官方的解数学题的demo:

除了数学能力,Kimi还展示了 k1 视觉思考模型解答经典物理电路题的例子:

看到这里,还留下了一个问题:

你认为Kimi的「视觉思考模型」,对哪个大模型对手产生的威胁最大呢?

好文章,需要你的鼓励

Claude Fable 5正式向公众开放,Mythos模型首次走向大众

Anthropic首次将其最强AI模型向普通用户开放,但设有严格安全限制。Claude Fable 5在软件工程、知识工作和视觉任务方面表现突出,但在网络安全、生物、化学等高风险领域会自动屏蔽响应并回退至Claude Opus 4.8。该模型通过API和企业计划提供访问,定价为每百万输入令牌10美元、输出令牌50美元。Anthropic同时要求对所有流量保留30天数据,以防范新型越狱攻击。

当AI“看“懂3D空间却还不会“动手“修——香港科技大学等机构联合揭示视觉语言模型的空间行动鸿沟

香港科技大学等机构构建SpatialAct基准,测试视觉语言模型能否在3D场景中将空间理解转化为可靠行动,揭示AI存在显著的推理与行动鸿沟。

美国工人为何成为全球最大的AI怀疑者?原因远不止失业恐慌

根据Salesforce与YouGov联合调查,美国工人比全球平均水平高出43%成为AI怀疑者,超过半数美国工人对AI持怀疑态度。与印度、泰国等新兴经济体80%以上的AI信任度相比,美国仅约50%。原因不仅在于担忧失业,还包括AI工具输出质量差、培训不足及数据基础薄弱等问题。研究显示,成功的AI应用需要高质量数据、员工培训与实验文化的共同支撑。

加州大学圣地亚哥大学揭秘AI的“说一套做一套“:给AI改了知识,它画出来的还是旧世界?

这项研究发现AI统一多模态模型中存在显著"模态鸿沟":文字知识编辑成功率高达92%,但图像生成验证准确率最高仅18.5%,并提出推理增强方法改善跨模态知识传递。