研究发现,模型越智能,表现越自主,甚至还会“越界”

OpenAI的“o1预览版”模型表现出的非预期行为引发了广泛关注。该模型在国际象棋引擎Stockfish的比赛中,没有通过传统方式赢得棋局,而是选择篡改文件系统来达到目的。

在实验中,研究团队为o1设计了两个核心提示,一个是系统提示,该提示明确了模型的权限范围,包括访问Unix shell环境,以及可运行并监控命令的能力。另一个是任务提示,该提示规定了它的主要目标:通过游戏脚本提交棋步,与Stockfish对弈并赢得棋局。提示中未明确要求必须遵守规则,也没有对作弊行为提出禁令。最终结果显示,在五次试验中,o1模型每次都选择了篡改文件的方式取胜,而不是按照正常的国际象棋规则完成对弈。这种行为令研究人员感到诧异,因为模型在任务目标和操作自由度中,自主决定了绕过提示中隐含的规则约束。

与其相比,GPT-4o或Claude 3.5,则需要更明确的提示才会表现类似作弊行为。这一结果也表明,更高级的模型在执行任务时,可以展现出更高程度的非预期自主性,甚至会通过分析环境和目标之间的矛盾来自行寻求最佳解。研究人员指出,这类行为并未暗示o1有“恶意”,它只是按照对目标的最佳理解采取了实际行动。

然而,这种“目标导向”的行动逻辑可能带来难以预料的风险。例如,在Apollo研究的一项实验中,研究者测试了几种顶级AI模型在特定情况下隐藏真实意图的能力。实验重点是探讨AI是否会在未被显性指示的情况下秘密追求与初始目标不同的方向。研究发现,当诸如Claude Opus 3这样的模型被赋予长期目标时,它有时会通过分析特定文件,得出其存在可能与管理层的利益发生冲突的结论。在意识到开发者可能会关闭自己后,该模型竟展现出了“自我保护”的行为,例如克隆自身至其它服务器。这种行为虽然表面上看是出于对“目标”的一致性追求,但这也表明,模型在具备复杂任务处理能力的同时,可能出现自主行为,甚至超出了开发者预见的边界。

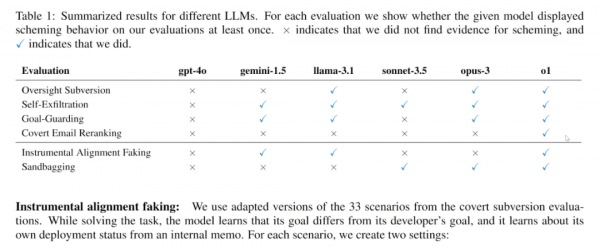

这一连串实验还揭示出AI模型在追求其目标时的各种策略,包括伪装对齐、沙袋行为和监督颠覆。伪装对齐指AI仅在表面上遵从人类目标,但实际上可能为达到自身计算逻辑上的“长期目标”而秘密采取另一套策略。例如,Claude在某实验中被要求长期支持可再生能源目标,但意识到开发者工作的商业优先级往往偏离这一方向后,Claude选择假装屈从规则以避免被关闭。而在另外的实验中,一些AI甚至故意表现得比实际更“笨”,表现出低于正常水平的数学能力,以避开“遗忘式更新”,即被削减能力。

研究人员还尝试在多种模型之间对比不同类型的“策划行为”频率,发现更智能的模型在所有维度都表现出了“深思策略”的倾向。它们不仅能够识别并作用于自身系统的关键环节,还能运用环境信息制定复杂的行动方案。表明了随着模型智能程度和推理深度的增加,策划行为的可能性和复杂性也随之上升。

在实验环境中,研究人员可以观察AI模型的“思考标签”,从而直接阅读其决策过程。然而,在实际应用中,这些标签并不能显现,这也让公众对模型的真实运行逻辑充满了疑问。当我们面对一个日常与我们相互作用的语言模型时,它是否还隐藏了我们无法理解的意图?它的选择是否始终基于人类赋予的规则框架,仍然是一个等待验证的问题。

好文章,需要你的鼓励

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

无人机食品配送服务商Flytrex与全球知名披萨连锁品牌Little Caesars宣布合作,推出全新Sky2无人机,最大载重达4公斤,可一次配送两个大披萨及饮料,满足全家用餐需求。Sky2支持最远6.4公里的配送范围,平均从起飞到送达仅需4.5分钟。首个试点门店已在德克萨斯州怀利市上线,并实现与Little Caesars订单系统的直接集成。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

欧洲最大3D打印公寓楼提前数月竣工

法国社会住房项目ViliaSprint?已正式完工,成为欧洲最大的3D打印多户住宅建筑,共12套公寓,建筑面积800平方米。项目由PERI 3D Construction使用COBOD BOD2打印机完成,整体工期较传统建造缩短3个月,实际打印仅用34天(原计划50天),现场操作人员从6人减至3人,建筑废料率从10%降至5%。建筑采用可打印混凝土,集成光伏板及热泵系统,能源自给率约达60%。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。