夸克发布首个可生成完整志愿报告的Agent

6月12日,夸克发布国内首个为高考志愿填报场景开发的高考志愿大模型,并同步上线“高考深度搜索”、“志愿报告”、“智能选志愿”三大核心功能。该模型具备专家级决策能力,能够为每位考生提供精准、个性化的志愿填报服务。

让每位考生都有自己的AI志愿顾问

高考志愿大模型驱动的夸克“志愿报告”以Agent方式运行,目前已开放试用。它能像经验丰富的志愿填报专家一样,为考生提供个性化的规划建议。基于“任务规划—执行—检查—反思”的链式推理流程,夸克志愿报告会自动输出涵盖冲稳保策略、志愿表、院校专业推荐等内容的完整报告。

“志愿报告”Agent以考生的成绩、兴趣偏好、家庭背景和地域倾向等为基础,会首先制定个性化任务规划(如定位成绩段、筛选专业方向、制定填报策略等);随后将任务转化为指令,基于高质量数据完成任务执行。

每轮执行结果模型经过自动检查,会判断是否存在逻辑冲突、数据缺漏、排序异常等问题,并将结果反馈至“反思”模块。通过评估结果与需求的差异不断优化后续策略,从而实现动态修正与智能迭代。

例如,当考生倾向选择省内且要求985院校时,模型在执行任务后,面对省内985院校较少的情况,会像志愿专家一样尝试推荐适合的外省985高校。

夸克高考志愿大模型支撑的另一个功能是“高考深度搜索”,当用户输入如“江苏物理组考生584分,性格内向,想找稳定工作”这类复杂查询时便会触发。为提升回答的准确性与专业性,模型会将考生的真实需求精细化拆解,每一类需求都对应定制化的回答范式与要点,确保回复兼具针对性与深度。

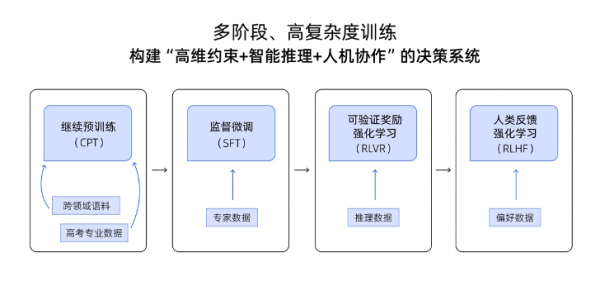

训练机制揭秘:多阶段、高复杂度训练,实现像专家一样思考与决策

以通义千问为基座,夸克高考志愿大模型基于领域数据优势,通过专项训练具备对复杂规则与用户需求的理解与推理能力,让模型真正“像志愿专家一样思考与决策”。

夸克高考志愿大模型通过一个多阶段、高复杂度的训练范式构建流程,融合了自监督语义建模、监督式对齐调优、由专家判别价值引导的策略精化机制。

在指令微调阶段,夸克高考志愿大模型将数百名资深高考志愿规划师的沟通、决策过程进行结构化。围绕他们与考生或家长的多轮真实对话,提取出完整分析路径与语言风格。通过将上万条真实专家“推理链”转化为高质量监督数据,夸克高考志愿大模型得以深度学习人类专家的分析过程。

夸克高考志愿大模型还在复杂推理任务中生成了中间可验证结构,显著降低幻觉率、增强跨模态演绎能力,并实现分布外泛化鲁棒性,解决各种需要专业知识的复杂问题。

最后通过基于人类偏好强化学习(RLHF)精化策略层,夸克高考志愿大模型构建了一个闭环优化机制,将“模拟填报 → 专家反馈 → 策略评分”引入到模型迭代过程中。

模型会基于模拟的考生档案生成志愿填报方案,随后这些方案将被提交给多位高考志愿专家进行评估。评估标准包括:专业建议是否准确易懂、排序逻辑是否贴合考生特征、是否兼顾分数与兴趣、是否充分提示风险并给出可行应对策略等。

夸克团队已完成对数千份志愿报告的专家标注与打分,通过“人类挑刺 + 模型修正”的方式,使模型输出在专业度与匹配度上持续逼近专家的真实判断标准。

构建最大高考知识库,夯实智能决策基础

与常见通用大模型多依赖网络文章或过往年份数据不同,夸克高考志愿大模型搭载了一套国内最大的实时更新、结构严谨的高考知识库。该知识库对高考相关权威站点实现近100%覆盖,涵盖全国2900多所高校、近1600个本科专业,系统整合了院校分数线、专业设置、课程体系等核心教学信息。

夸克高考知识库还投入海量资源对每个省份的高考政策及权威解读进行梳理、实时更新。通过OCR提取、多源交叉比对与人工抽检等多重机制,实现高可信度的数据引入与结构化治理,确保模型所依赖的数据具备权威性和可验证性。

此外考虑到志愿填报与未来就业强相关,夸克高考知识库还进一步将高校毕业生就业相关信息、产业趋势规划、就业报告等纳入。丰富、准确的数据为模型在“冲—稳—保”排序、就业前景评估等环节提供了有力支撑。

夸克算法负责人蒋冠军表示:“高考志愿填报是一个信息密集、决策复杂的场景。我们希望通过高考志愿大模型在信息处理和需求理解方面的专业优势,让每一个考生、每一个家庭都能够获得全面的参考。”

好文章,需要你的鼓励

Allen AI团队推出SAGE:首个能像人类一样“想看多长就看多长“的智能视频分析系统

Allen AI研究所联合多家顶尖机构推出SAGE智能视频分析系统,首次实现类人化的"任意时长推理"能力。该系统能根据问题复杂程度灵活调整分析策略,配备六种智能工具进行协同分析,在处理10分钟以上视频时准确率提升8.2%。研究团队创建了包含1744个真实娱乐视频问题的SAGE-Bench评估平台,并采用创新的AI生成训练数据方法,为视频AI技术的实际应用开辟了新路径。

联想推出DE6600系列:更智能的存储解决方案

联想推出新一代NVMe存储解决方案DE6600系列,包含全闪存DE6600F和混合存储DE6600H两款型号。该系列产品延迟低于100微秒,支持多种连接协议,2U机架可容纳24块NVMe驱动器。容量可从367TB扩展至1.798PiB全闪存或7.741PiB混合配置,适用于AI、高性能计算、实时分析等场景,并配备双活控制器和XClarity统一管理平台。

AI视觉模型真的能看懂长篇文档吗?中科院团队首次揭开视觉文本压缩的真相

中科院团队首次系统评估了AI视觉模型在文本压缩环境下的理解能力,发现虽然AI能准确识别压缩图像中的文字,但在理解深层含义、建立关联推理方面表现不佳。研究通过VTCBench测试系统揭示了AI存在"位置偏差"等问题,为视觉文本压缩技术的改进指明方向。

数智时代,openGauss Summit 2025即将发布哪些技术创新破局

“算力+储能”深度融合:超智算发布分布式算力超级节点储能解决方案

联想推出DE6600系列:更智能的存储解决方案

创业公司如何在严格监管行业中实现生死攸关的创新

OpenAI发布GPT-5.2-Codex模型,软件工程自动化能力大幅提升

Waterfox浏览器宣布拒绝AI功能,瞄准Firefox忠实用户

TikTok美国业务出售交易将于下月完成

破局AI数据中心安全瓶颈:Fortinet联合NVIDIA引领隔离式加速新航向

智算中心进化论,科华数据如何做到“更懂”

更高负载、更快建设:2026年数据中心六大趋势

Snowflake数据库更新引发全球大规模服务中断

AI编程初创公司Lovable融资3.3亿美元,英伟达等科技巨头支持