2024年AI服务器和AI PC趋势

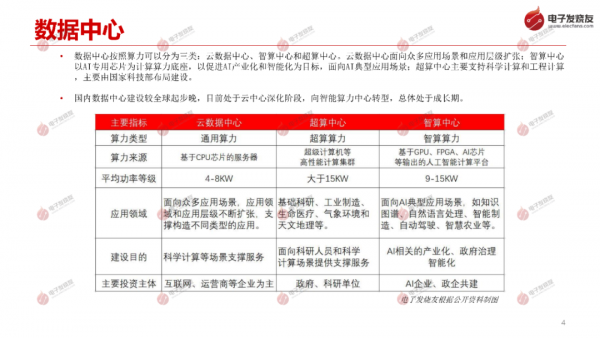

数据中心按照算力可以分为三类:云数据中心、智算中心和超算中心。云数据中心面向众多应用场景和应用层级扩张;智算中心 以AI专用芯片为计算算力底座,以促进AI产业化和智能化为目标,面向AI典型应用场景;超算中心主要支持科学计算和工程计算 ,主要由国家科技部布局建设。

国内数据中心建设较全球起步晚,目前处于云中心深化阶段,向智能算力中心转型,总体处于成长期。

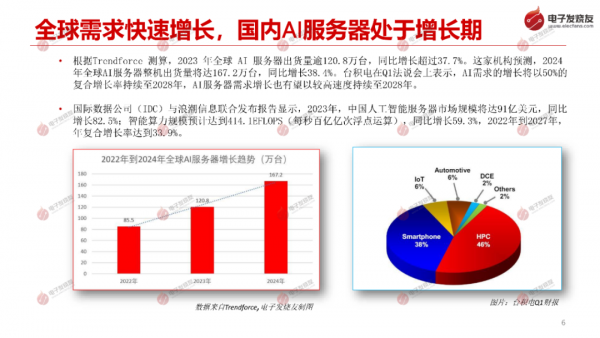

根据Trendforce 测算, 2023 年全球 AI 服务器出货量逾120.8万台,同比增长超过37.7%。这家机构预测, 2024 年全球AI服务器整机出货量将达167.2万台,同比增长38.4%。台积电在Q1法说会上表示,AI需求的增长将以50%的 复合增长率持续至2028年,AI服务器需求增长也有望以较高速度持续至2028年。

2023年,中国人工智能服务器市场规模将达91亿美元, 同比 增长82.5%;智能算力规模预计达到414.1EFLOPS (每秒百亿亿次浮点运算),同比增长59.3%,2022年到2027年, 年复合增长率达到33.9%。

按照用途区分, AI服务器分为训练和推理两大类别。训练用服务器对存储空间、带宽和算力的要求较高, 主要采用8-GPU 设计;推理用服务器对算力、存储和带宽的要求相对较低,取决于业务场景, 可以采用 GPU、NPU、CPU 等不 同芯片承担推理任务,可以采用PCLe接口的AI加速器实现推理任务。

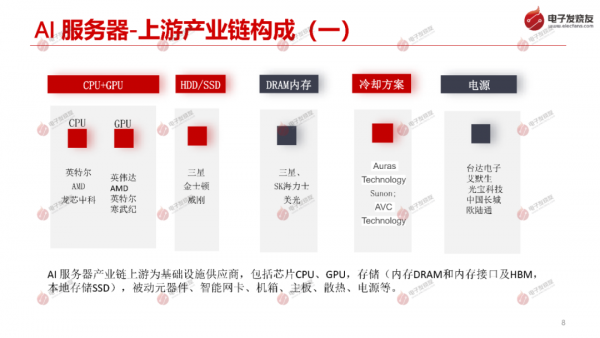

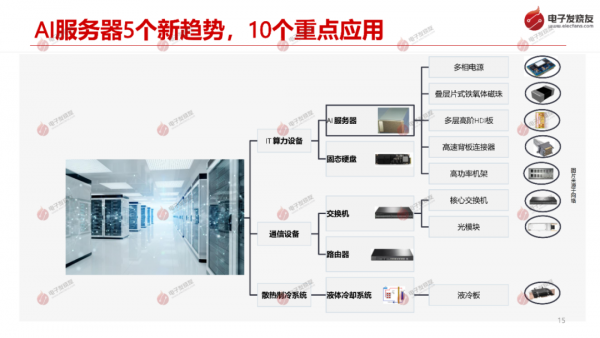

服务器随场景需求经历通用服务器-云服务器-边缘服务器-AI服务器四种模式,AI服务器采用GPU增强其并行计算能力。CPU+GPU是AI服务器的核心部件。机柜级解决方案有望成为未来 AI 服务器出货主流形式之一。

1、半导体行业系列专题:刻蚀—半导体制造核心设备,国产化典范

2、半导体行业系列专题:碳化硅—衬底产能持续扩充,加速国产化机会 3、半导体行业系列专题:直写光刻篇,行业技术升级加速应用渗透 4、半导体行业系列专题:先进封装—先进封装大有可为,上下游产业链受益

好文章,需要你的鼓励

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

本期《Quick Charge》播客涵盖多个热点话题:特斯拉疑似试图删除FSD欺诈相关证据以规避巨额赔付;卡特彼勒持续推进建筑领域电气化布局;住宅太阳能30%税收抵免即将到期。此外,嘉宾Tom Pacheco就高压系统与电池技术培训展开探讨,强调电动车技术人才培养的紧迫性。节目同时提醒有意安装太阳能的用户尽快行动,可通过EnergySage平台比较多家安装商报价。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。