世界最好小参数开源大模型!超谷歌、Meta,手机、平板轻松运行

法国著名大模型平台Mistral.AI开源了最新小参数模型——Ministraux。

Ministraux一共有Ministral 3B和8B两个版本,是专为手机、平板、笔记本等移动设备设计,在文本生成、推理、函数调用和效率方面非常强悍,大幅度超过了Meta的Llama-3.2和谷歌的Gemma-2,重新定义100亿参数以下小模型的性能。

所以,Mistral.AI在发布时也挺直接,这是目前世界最好的开源小参数模型。

开源地址:https://huggingface.co/mistralai/Ministral-8B-Instruct-2410

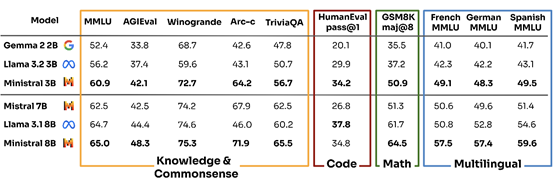

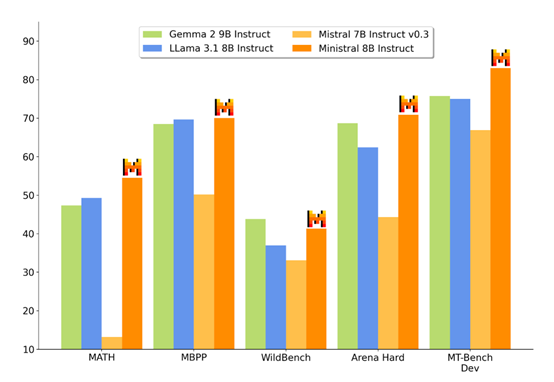

从Mistral.AI公布的测试数据来看,Ministraux的性能确实不错。以最小参数的3B为例,在MMLU、AGIEval、Winogrande、Arc-c、TriviaQA等主流基准测试平台中,分别达到了60.9、42.1、72.7、64.2、56.7的超高分数。

比谷歌的Gemma-2-2B、Meta的Llama-3.2-3B性能高出一大截,甚至超过了70亿参数的模型性能。

而8B版本与Meta、谷歌开源的同类模型相比,在主流测试基准中同样大幅度超越。

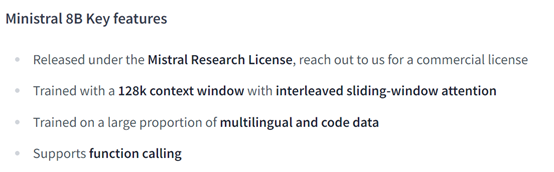

Ministral 3B和8B支持128k上下文长度,能够处理超长文本序列,这对于打造AI翻译、离线AI助手、本地数据分析AI助手等非常有帮助。

此外,如果你想开发一个更复杂的AI助手,也可以将Ministraux与Mistral Large等参数较大的模型混合使用,可以充当多流程的智能代理,处理输入解析、任务路由,并根据用户意图在极低延迟和成本下调用多个上下文的API。

架构方面,Ministral 8B版本使用了特殊的交错滑动窗口注意力机制,极大提升了推理效率、内存利用率以及用户响应,这也是能在移动端使用离线大模型的主要原因之一。

传统的Transformer自注意力机制需要对序列中的每个位置计算与其他所有位置的相似度,这会导致计算量和内存需求呈现二次方增长。

而滑动窗口注意力机制通过限制注意力计算的范围,仅在固定大小的窗口内进行计算,只计算窗口内的位置之间的相似度,并将注意分数归一化得到权重。这可以大幅度减少AI算力,并保持局部依赖性。

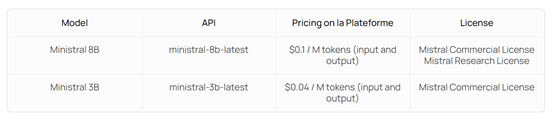

价格方面,如果不是本地部署也可以使用Mistral.AI服务,Ministral 8B 的API定价为每百万输入和输出token0.1美元,而Ministral 3B 的定价为每百万输入和输出token 0.04美元。

Mistral.AI表示,新发布的Ministraux只是他们对小参数模型的尝试,效果却非常好超过了一年前发布的Ministral 7B。

未来会继续开源更多高性能、小参数的模型,让更多的开发者可以轻松在本地部署使用。

好文章,需要你的鼓励

AI投资有望在2026年获得真正回报的原因解析

尽管全球企业AI投资在2024年达到2523亿美元,但MIT研究显示95%的企业仍未从生成式AI投资中获得回报。专家预测2026年将成为转折点,企业将从试点阶段转向实际部署。关键在于CEO精准识别高影响领域,推进AI代理技术应用,并加强员工AI能力培训。Forrester预测30%大型企业将实施强制AI培训,而Gartner预计到2028年15%日常工作决策将由AI自主完成。

北大学者革新软件诊断方式:让代码问题的“病因“无处遁形

这项由北京大学等机构联合完成的研究,开发了名为GraphLocator的智能软件问题诊断系统,通过构建代码依赖图和因果问题图,能够像医生诊断疾病一样精确定位软件问题的根源。在三个大型数据集的测试中,该系统比现有方法平均提高了19.49%的召回率和11.89%的精确率,特别在处理复杂的跨模块问题时表现优异,为软件维护效率的提升开辟了新路径。

2026年软件定价大洗牌:IT领导者必须知道的关键变化

2026年软件行业将迎来定价模式的根本性变革,从传统按席位收费转向基于结果的付费模式。AI正在重塑整个软件经济学,企业IT预算的12-15%已投入AI领域。这一转变要求建立明确的成功衡量指标,如Zendesk以"自动化解决方案"为标准。未来将出现更精简的工程团队,80%的工程师需要为AI驱动的角色提升技能,同时需要重新设计软件开发和部署流程以适应AI优先的工作流程。

德国达姆施塔特工业大学团队首次揭秘:专家混合模型AI的“安全开关“竟然如此脆弱

这项由德国达姆施塔特工业大学领导的国际研究团队首次发现,当前最先进的专家混合模型AI系统存在严重安全漏洞。通过开发GateBreaker攻击框架,研究人员证明仅需关闭约3%的特定神经元,就能让AI的攻击成功率从7.4%暴增至64.9%。该研究揭示了专家混合模型安全机制过度集中的根本缺陷,为AI安全领域敲响了警钟。