里通义开源音频生成模型,能模仿音效师为视频配音

7月1日消息,阿里通义实验室开源了旗下首个音频生成模型ThinkSound,该模型首次将CoT(Chain-of-Thought,思维链)应用到音频生成领域,让AI可以像专业音效师一样逐步思考,捕捉视觉细节,生成与画面同步的高保真音频。

目前,ThinkSound的代码和模型已在Github、HuggingFace、魔搭社区开源,开发者可免费下载和体验。

阿里开源音频生成模型ThinkSound

视频生成音频(V2A)技术是多媒体编辑和视频内容创作领域最重要的技术之一,但该技术的发展速度仍存在诸多技术挑战,例如业界现有的V2A技术仍缺乏对视觉对应声学细节的深入理解,导致生成的音频较为通用,甚至与关键视觉事件错位,难以满足专业创意场景中对时序和语义连贯性的严格要求。

为了解决现有视频转音频技术难以捕捉画面中动态细节和时序的难题,通义团队首次将思维链推理引入多模态大模型,可以模仿人类音效师的多阶段创作流程,实现对视觉事件与相应声音之间深度关联的精准建模,例如先分析视觉动态、再推断声学属性,最后按照时间顺序合成与环境相符的音效。不仅如此,该团队还构建了首个带思维链标注的音频数据集AudioCoT,该数据集融合了2531.8小时的多源异构数据,让模型在音频生成与编辑任务时做到“知其然、知其所以然”。

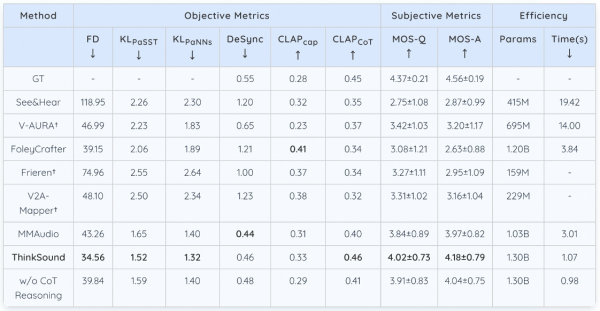

在开源的VGGSound测试集上,ThinkSound的核心指标相比MMAudio、V2A-Mappe、V-AURA等现有主流方法均实现了15%以上的提升。例如,在openl3空间中Fréchet 距离(FD)上,ThinkSound 相比 MMAudio的43.26 降至34.56(越低越好),接近真实音频分布的相似度提高了20%以上;在代表模型对声音事件类别和特征判别精准度的KLPaSST 和 KLPaNNs两项指标上分别取得了1.52和1.32的成绩,均为同类模型最佳。

在开源的VGGSound测试集上,ThinkSound多项核心指标位居第一

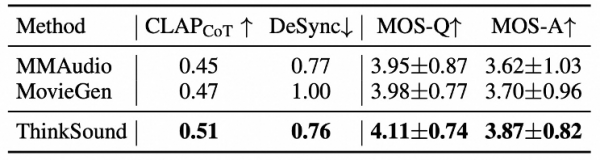

在MovieGen Audio Bench测试集上,ThinkSound的表现大幅领先Meta推出的音频生成模型Movie Gen Audio,展现了模型在影视音效、音频后期、游戏与虚拟现实音效生成等领域的应用潜力。

ThinkSound大幅领先Meta旗下Movie Gen Audio

目前,通义实验室已推出语音生成大模型 Cosyvoice、端到端音频多模态大模型MinMo等模型,全面覆盖语音合成、音频生成、音频理解等场景。

好文章,需要你的鼓励

供应链安全攻防升级:恶意软件清除行动与AI误报噪音双重夹击

CrowdStrike联合谷歌和Shadowserver基金会成功打击了GlassWorm恶意软件行动,同时摧毁其四条C2控制信道,该行动曾通过poisoned npm和Python包及VSCode扩展攻击开发者。然而,攻击者可借助开源生态系统低成本快速重建。与此同时,OSV数据库撤回157条疑似AI生成的误报记录,暴露出自动化安全报告的可靠性问题,信号噪音正在侵蚀防御工具的可信度。

当虚拟人物终于能“真实地打一拳“——来自耶路撒冷希伯来大学的4D人物动作仿真突破

耶路撒冷希伯来大学研究团队提出PhyGenHOI框架,将人体运动生成与物理仿真结合,让虚拟人物与三维物体之间的接触互动同时满足视觉自然性和物理真实性。

让AI生成自己的提示词,图像效果立竿见影

想提升AI图像生成质量?一个实用技巧是:先让聊天机器人为你设计专属的图像生成提示词,再将其用于对应的图像生成器。只需提供基本描述,让AI自动补充细节,生成更完整、精准的提示词。经测试,Gemini和ChatGPT均能返回远超用户自行编写的详细描述,图像生成效果明显更好。此外,由AI生成的提示词还能有效规避内容审核限制,让生成过程更顺畅。

弗莱堡大学等机构联合研究:让AI学会“立体思考“,彻底解决图像匹配中的左右不分难题

本文介绍了弗莱堡大学等机构提出的3D-SC框架,通过引入三维基础模型的几何先验,无需人工标注即可解决AI图像匹配中的左右混淆和重复部件分不清的问题。

供应链安全攻防升级:恶意软件清除行动与AI误报噪音双重夹击

让AI生成自己的提示词,图像效果立竿见影

我为Claude Opus 4.8设置了10个诚实陷阱——一道法律题让它"崩了"

Galaxy Tab S10 FE Plus评测:三星平价旗舰平板找到了正确的平衡点

Anthropic如何重塑SaaS格局,CIO们该何去何从

Pacific Fusion宣布完成十亿美元融资,脉冲驱动核聚变技术取得关键里程碑

乐高发布13款全新智能游玩宝可梦套装,现已开放预购

三星Galaxy Z Fold 8"宽屏版"再解折叠屏痛点,更多规格与图片曝光

Google Gemini智能体兑现演示承诺,苹果智能或同样可期

Anthropic扩展Glasswing计划,承诺公开发布Claude Mythos级模型

任天堂音乐应用更新:支持CarPlay、Siri及iPad

Sensory Robotics宣布:工业机器人无围栏安全时代正式到来