谷歌:将利用TCAV技术解决人工智能及机器学习模型偏差

谷歌首席执行官Sundar Pichai表示,谷歌正在努力使旗下的人工智能和机器学习模型更加透明,以此抵御系统的偏差。

Pichai提及一系列人工智能增强技术(https://blog.google/technology/developers/io19-helpful-google- everyone /)以及将更多的机器学习模型放在设备上的举动,而对于开发人员和数据科学家而言他说的重点则在于TCAV。 TCAV是概念激活向量测试(Testing with Concept Activation Vectors)的英文缩写(https://ai.google/research/pubs/pub47077)。简而言之,TCAV是一种可解释性的方法,可用于了解神经网络模型用来预测的信号。

理论上,TCAV具有理解信号可能表现出偏差的能力(https://github.com/tensorflow/tcav),因为这些信号会强调男性是否是有别于女性,信号还会表现出其他的问题,如种族、收入和位置。计算机科学家利用TCAV就可以看到价值概念到底有多高的价值(https://arxiv.org/abs/1711.11279)。

偏差是人工智能里的一个重要概念,一些学者呼吁引进更多的自我监管和法例(https://www.zdnet.com/article/why-businesses-will-have-to-audit-algorithms-ai-and-account-for-risk/)。此外,诸如IBM一类的行业参与者也在推动更大的透明度和具有监控算法层的软件,以达到了解算法是如何产生偏见的目的(https://www.zdnet.com/article/ibm-launches-tools -to-detect-ai-fairness-bias-and-open-sources-some-code /)。而与此同时,一些企业也在向着可解释人工智能方向努力(https://www.zdnet.com/article/capital-one-ai-chief-sees-path- to-explainable-ai /)。对于谷歌来说,透明度很重要,因为谷歌的技术包括Duplex和下一代谷歌智能助理(https://www.zdnet.com/article/google-sees-next-gen-duplex- assistant-as-next-step-in-taking-over-your-tasks/ )。这些工具现在为用户执行任务时的功能越来越多。模型的透明度可能意味着对谷歌技术的更多信任和使用。

最关键的一点:透明度和防范偏差对于企业以及为我们提供大多数模型即服务的所有云提供商都至关重要(https://www.zdnet.com/article/top-cloud- providers -2019-aws-microsoft-azure-google-cloud-ibm-makes-hybrid-move-salesforce-dominates-saas/)。

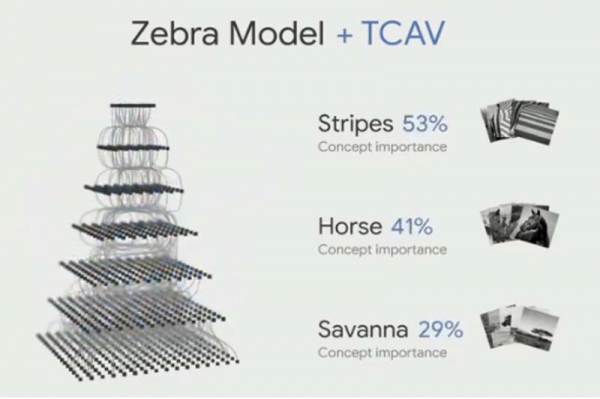

TCAV的使用不需要重新训练模型,TCAV做的是解剖模型即说明模型为何做出某种决定。例如,识别斑马的模型可以使用更高级别的概念来识别斑马。来看一个示例:

Pichai表示,“要为每个人建立一个更有帮助的谷歌就意味着解决偏差问题。你需要知道模型是如何工作的,并且清楚其中可能存在偏差。为此,我们将提高模型的透明度。”

他补充表示,谷歌的人工智能团队正在开发TCAV,这项技术可以允许模型使用更多的高级概念。TCAV的目标是将支撑模型的变量表现出来。“还有做很多的工作,但我们奉行的原则是打造适合所有人的人工智能。”Pichai表示。

由于谷歌能够将模型的大小缩小到可以驻留在设备上,谷歌现在正朝着降低延迟及使用联合学习等技术减少数据使用并增强用户隐私的方向努力。

好文章,需要你的鼓励

谷歌Project Genie新增街景功能,带你探索真实世界

谷歌宣布为旗下互动世界构建工具Project Genie新增Google街景功能,用户可基于真实地点生成可探索的游戏世界。只需选定美国境内的地图位置,描述角色形象,并选择"沙漠"或"石器时代"等风格,系统即可生成与现实街景绑定的沉浸式虚拟场景。每次游玩时长限60秒,支持WASD操控,目前仅向AI Ultra订阅用户开放,后续将逐步扩展覆盖范围。

新加坡国立大学发布首个视频“潜台词“理解基准测试:AI究竟能不能读懂视频背后的弦外之音?

新加坡国立大学构建了首个视频隐喻理解基准ViMU,含588段视频与2352道题,测试16个主流AI模型均未超过50%,揭示AI在视频潜台词理解上的系统性短板。

手机上的“氛围编程“时代正式来临

随着AI编程工具的普及,越来越多的非开发者开始尝试自己构建应用。谷歌在I/O大会上宣布,AI Studio新增功能可让用户通过提示词快速生成原生Android应用,并直接导出到手机。此外,谷歌还推出了基于Gemini的自定义小组件功能,并提出"生成式UI"概念,让手机界面根据需求实时生成。与此同时,苹果据报道也在探索通过提示词创建快捷指令的功能,手机个性化体验或将迎来新突破。

浙江大学联合多所顶校:让AI真正“看懂“360度全景图,机器人导航和视觉搜索迎来新突破

浙江大学等机构联合提出PanoWorld,通过球面空间交叉注意力和57万张全景图训练数据,让AI能直接理解360度全景图的空间结构,在导航和视觉搜索任务中大幅超越现有方法。

最热门的 AI 模型:它们的功能和使用方法

这款古怪的 AI 智能手机可以创建你的数字分身

Faireez 获 750 万美元融资,为租赁市场提供 AI 驱动的酒店式管家服务

Broadcom 大获全胜:70% 大型 VMware 客户购买其最全面解决方案

Peer 获得1050万美元元宇宙引擎投资,推出3D个人星球功能

获 3000 万美元融资,Crogl 发布面向安全分析师的全新 AI "钢铁侠战衣"

Turing 获得 1.11 亿美元融资,估值达到 22 亿美元,为 OpenAI 等大语言模型公司提供关键代码支持

Tavus 推出系列 AI 模型,实现实时人脸交互技术突破

Welevel 获得 570 万美元融资,革新程序化游戏开发

AI 驱动的卓越运营:企业如何通过人人可及的流程智能提升成功