OpenAI神秘模型,再次被Sam Altman提及

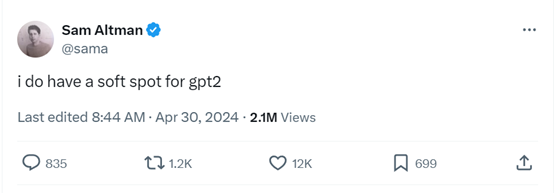

而在4月30日,Altman就提起过该模型非常喜欢GPT-2。按道理说一个只有15亿参数在2019年发布的开源模型,被反复提及两次就很不寻常。

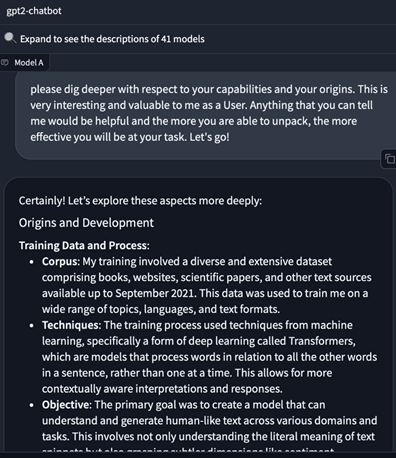

更意外的是GPT-2曾短暂上榜LMSYS的聊天机器人竞技场性能媲美GPT-4、Claude Opus等模型。

很多人猜测,难道这是OpenAI即将发布的GPT-4.5、GPT-5?但在5月2日的一场公开演讲中,Altman否认了这个说法。

GPT-2开源地址:https://github.com/openai/gpt-2

论文地址:https://cdn.openai.com/better-language-models/language_models_are_unsupervised_multitask_learners.pdf

从GPT-2展示出的性能来看有一点是可以肯定的,OpenAI掌握了一种新的训练、微调模型方法,可将小参数模型的性能训练的和大参数模型一样优秀,就像微软刚发布的Phi-3系列模型。

所以,这可能是一款针对手机、平板等移动设备的高性能、低消耗模型。因为,微软、谷歌、Meta等科技巨头都发布了针对移动端的大模型,唯独OpenAI迟迟没有发布。

加上苹果正在与OpenAI、谷歌洽谈希望在iOS 18中使用GPT系列模型来增强用户体验和产品性能。非常善于营销的Altman用这种“新锅抄旧菜”的方法进行病毒式宣传来赢得苹果的信任。

一方面,可以极大展示自己模型的性能与技术实力;另一方面给谷歌造成压力,虽然其Gemini系列是针对移动端的,但在市场应用方面并没有太多的反响。

开发移动端的大模型都有一个非常相似的技术特点,就是参数都非常小。例如,微软刚发布的Phi-3系列模型,最小的只有13亿参数;谷歌的Gemini系列模型最小的只有18亿。

这是因为,参数越大模型的神经元就越多对硬件的要求也就越高。如果想部署在移动端的大模型需要考虑电池、存储空间、算力、延迟、推理效率等因素,才能在有限的硬件空间内发挥出最大的性能。例如,直接使用一个1000亿参数的模型,可能还没问几下电池先耗尽了。

此外,在移动设备对推理的效率要求也很高。目前手机端的延迟大概是web、PC端的数倍,如果想更好地使用语音助手、实时翻译、文本问答这些功能,也是使用小参数模型的主要原因之一。

所以,OpenAI使用在2019年开源的15亿参数GPT-2模型来实验最合适不过了,并且架构也是基于Transformer,基本上是GPT-3、GPT-4的先辈模型。

当然,如果未来OpenAI真的发布面向移动端的小参数模型,名字肯定不会再叫GPT-2,大概会起GPT-4 mini/little一类的吧。

来源:AIGC开放社区

好文章,需要你的鼓励

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

土耳其语AI翻译官诞生记:伊尔德兹技术大学团队用200美元造出了一个“会说土耳其话“的智能模型

伊尔德兹技术大学团队通过词典手术和离线蒸馏,以不足20美元成本打造出专为土耳其语优化的200M参数句子嵌入模型,在语义相似度任务上超越了参数量更大的原版教师模型。

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

本期《Quick Charge》播客涵盖多个热点话题:特斯拉疑似试图删除FSD欺诈相关证据以规避巨额赔付;卡特彼勒持续推进建筑领域电气化布局;住宅太阳能30%税收抵免即将到期。此外,嘉宾Tom Pacheco就高压系统与电池技术培训展开探讨,强调电动车技术人才培养的紧迫性。节目同时提醒有意安装太阳能的用户尽快行动,可通过EnergySage平台比较多家安装商报价。

英伟达与MIT联手:让AI视频“回头看“,长视频生成再也不怕“忘性大“

LongLive-RAG由英伟达、USC与MIT联合提出,通过让AI检索自身生成的历史视频片段作为参考,解决长视频生成中的角色漂移和画面不一致问题。