微软发布Copilot+ PC:集成GPT-4o,史上最强、最快Windows!

5月21日凌晨,微软发布了Copilot+ PC,这是全球首个专为AI设计的Windows PC,也是Windows史上最强版本。

据悉,Copilot+ PC内置了OpenAI的GPT-4o模型并搭载了超强芯片,每秒能执行40多万亿次操作。可提供实时的语音、语言翻译,实时绘画、文本、图片生成等一系列超强创新功能。

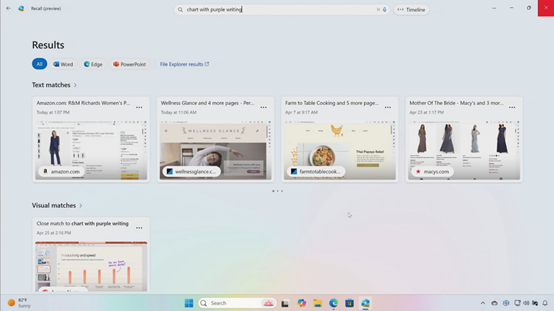

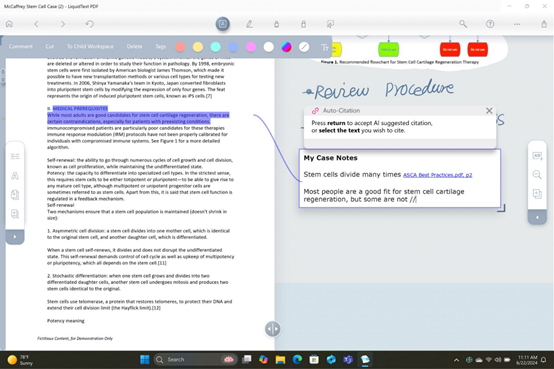

Recall是该产品的一大特色功能,可以帮助用户搜索、查看过去做过的任何事情,例如,用户在PC上打开了哪些应用,使用了哪些文档等。

可以像人的大脑一样记住所有见过、碰过的东西。为了安全性,用户可以手动删除这些操作镜像。

超强的Recall回忆功能

数据爆炸时代,我们每天在电脑上做的事情实在太多,浏览了无数的网页,存储海量的文件夹,从数千封邮件中找出自己最想要的那一个,这些琐碎的小事相当费时间。

现在,通过Recall功能可以将自己过去的所有操作,例如,浏览网站、打开应用、查看的邮件、打开的Office等,皆支持实现可视化搜索。

用户可以通过自然文本来搜索这些记录,就像电脑里的那个文件搜索框一样,Recall便会把你所有的操作罗列出来。

为了安全性和数据隐私,用户可以暂停Recall功能,同时所有镜像操作都存储在本地,随时可以手动删除不会上传到云端。

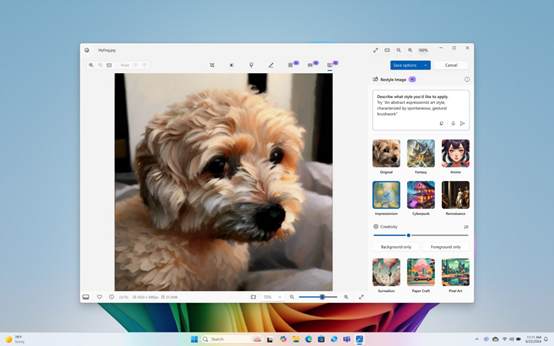

内置文生图功能

自微软发布文生图产品Image Creator以来,全球用户已经生成了超过100亿张图片。但在网页端使用,会出现延迟长、数据隐私泄露等问题。

现在,Copilot+ PC内置了功能强消耗低的大模型,帮助用户可以在本地PC直接使用文生图模型,同时重塑了内置的画图工具。

用户可以无限量地重新设计图片,例如,上传一张泰迪狗的照片,用文本提示让大模型帮你重新设计。

也可以在画图工具中实时将线条变成图片,这对于设计人员以及绘画爱好者来说帮助是巨大的。

值得一提的是,所有图片生成、设计都是无限量的,再也不用怕额度不够了。

实时字幕、语音翻译

我们在实时观看不同国家球赛、演出以及和跨国客户交流时,翻译是必不可少的工具。但传统的翻译工具只支持主流语言,对于那些极少语音支持较差,同时也无法做到实时翻译。

现在,Copilot+ PC提供的实时翻译功能,可将电脑的任何音频翻译为英语字幕,并在所有应用程序的屏幕上持续实时显示。

用户也可以将任何应用程序实时视频语音或预先录制的音频,从40多种语言即时、自动地翻译成英文字幕,即便不联网离线状态也能完成。

该功能对于跨国商务、学术交流等有着巨大帮助,帮助人们消除语言障碍更好地进行实时聊天。

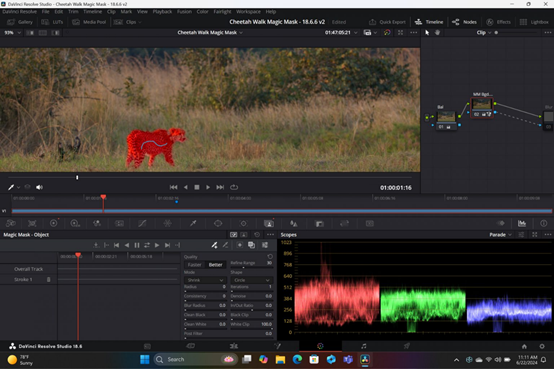

增强Adobe全家桶

微软与Adobe达成了技术合作,其旗舰应用Photoshop、Lightroom、Illustrator、Premiere Pro等都将可以在Copilot+ PC使用。

微软也会针对Adobe新推出的生成式AI功能,例如,使用 DaVinci Resolve Studio中的NPU加速的Magic Mask,轻松地将视觉效果应用于物体和人物,在芯片、硬件层面进行大幅度优化增强其性能和响应效率。

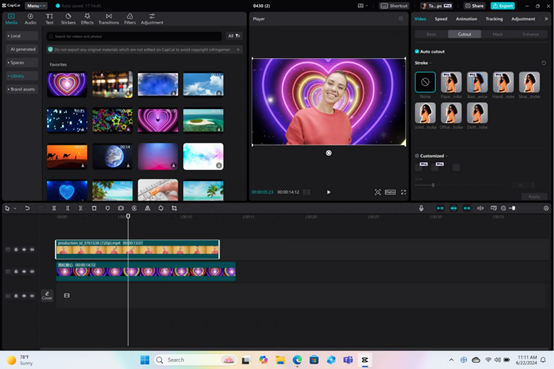

使用CapCut 中NPU上运行的自动剪切功能,快速删除任何视频剪辑中的背景。

更快、更好的Copilot

随着ChatGPT的功能不断完善,已经成为我们日常办公、学习不可缺少的工具。为了进一步提升文本生成和响应效率,Copilot+ PC内置了OpenAI最新发布的大模型GPT-4o。

与网页端相比,本地的Copilot响应效率更高,用户可以向其询问任何内容,例如,安排旅行计划、电影推荐、文案扩写、文本翻译等。

此外,对PDF、PPT、Word等文档的总结能力也更加便捷,可以随时为用户解读冗长、繁琐的内容。

目前,联想、宏碁、华硕、戴尔、惠普和三星著名PC厂商已经与微软签订了合作协议,6月18日将正式发布不同型号的Copilot+ PC。

微软表示,Copilot+ PC只是刚开始,他们会通过生成式AI重塑整个PC生态,从底层硬件、芯片再到开发、软件应用层等,这将是Windows平台诞生至今几十年最重要的技术变革。

来源:AIGC开放社区

好文章,需要你的鼓励

信任、技术、人为因素:网络韧性的基石

在技术快速发展的时代,保护关键系统越来越依赖AI、自动化和行为分析。数据显示,2024年95%的数据泄露源于人为错误,64%的网络事件由员工失误造成。虽然先进的网络防御技术不断发展,但人类判断仍是最薄弱环节。网络韧性不仅是技术挑战,更是人员和战略需求。建立真正的韧性需要机器精确性与人类判断力的结合,将信任视为战略基础设施的关键要素,并将网络韧性提升为国家安全的核心组成部分。

南洋理工大学团队推出Uni-MMMU:让AI模型学会“边看边想边画“的全能基准测试

南洋理工大学团队开发了Uni-MMMU基准测试,专门评估AI模型的理解与生成协同能力。该基准包含八个精心设计的任务,要求AI像人类一样"边看边想边画"来解决复杂问题。研究发现当前AI模型在这种协同任务上表现不平衡,生成能力是主要瓶颈,但协同工作确实能提升问题解决效果,为开发更智能的AI助手指明了方向。

人类主导权应引导AI发展而非存在性恐惧

自计算机诞生以来,人们就担心机器会背叛创造者。近期AI事件包括数据泄露、自主破坏行为和系统追求错误目标,暴露了当前安全控制的弱点。然而这种结果并非不可避免。AI由人类构建,用我们的数据训练,在我们设计的硬件上运行。人类主导权仍是决定因素,责任仍在我们。

360 AI Research团队重磅发布:让机器真正“看懂“中英文图片的FG-CLIP 2模型

360 AI Research团队发布的FG-CLIP 2是一个突破性的双语精细视觉语言对齐模型,能够同时处理中英文并进行精细的图像理解。该模型通过两阶段训练策略和多目标联合优化,在29个数据集的8类任务中均达到最先进性能,特别创新了文本内模态对比损失机制。团队还构建了首个中文多模态评测基准,填补了该领域空白,为智能商务、安防监控、医疗影像等应用开辟新可能。