英特尔携手生态伙伴共筑边缘AI生态,加速具身智能应用落地

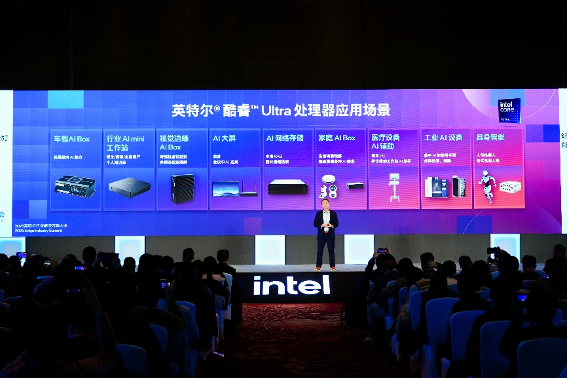

11月19日,在2025英特尔行业解决方案大会上,英特尔展示了基于英特尔® 酷睿™ Ultra平台的最新边缘AI产品及解决方案,并预览了针对边缘侧的英特尔® 酷睿™ Ultra处理器(第三代),面向具身智能和机器人应用提供强大算力支持。会上,英特尔携手普联技术、海石商用、海信医疗、阿丘科技等众多的生态伙伴,共同分享了丰富的行业应用成果,携手勾勒出端侧AI领域的未来发展新蓝图。

英特尔副总裁兼中国区软件工程和客户端产品事业部总经理高嵩表示,“边缘计算凭借其极其丰富的应用场景,以万象更新之势,为AI带来了新的发展机遇。立足于x86系统的生态优势、AI PC的领导力与技术创新,英特尔正通过更强大、高度集成的软硬一体AI解决方案,为客户提供更具成本效益的边缘算力,加速机器人、智慧教育、智慧交通、智能制造等关键应用场景的落地。我们与广泛的生态合作伙伴紧密协作,共同帮助客户降本增效,推动创新成果更快地走向市场,以卓越的总体拥有成本(TCO)优势,加速产业智能化转型。”

软硬件协同,以AI加速引擎实现更优TCO效益

从智能零售的自助结账系统、工业个人电脑,到医疗影像的核磁共振设备,乃至优化交通与公共安全的边缘服务器,边缘计算正以前所未有的速度重塑企业运营和日常生活。生成式AI与机器视觉的融合催生了新的可能,但同时也面临行业应用碎片化、传统基础设施复杂、AI工作负载集成困难等挑战。因此,衡量边缘AI解决方案不应仅限于理论性能(如TOPS),更应高效整合软硬件资源,提供适配多样化场景的创新方案,并综合考量端到端系统性能与TCO,追求整体价值最大化。

英特尔以动态的边缘AI路线图,通过自上而下的可扩展性、集成AI加速能力的SoC以及广泛开放的软件生态系统,为边缘AI带来卓越的TCO优势。当前,英特尔酷睿Ultra 200H系列处理器在同等功耗和尺寸下,通过架构创新可提供99 TOPS的AI算力。其将AI工作负载高效整合至单颗芯片,显著降低了对独立显卡的需求,从而减少系统功耗,并优化散热与电源设计。这使得酷睿Ultra处理器在超声诊断、制造质检和AI医疗影像等场景中,能在五年部署周期内为客户带来可观的成本节省。

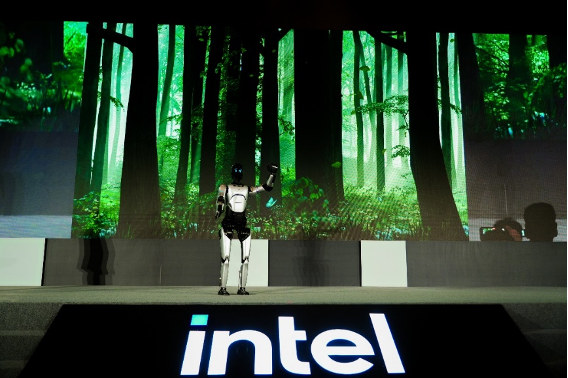

新一代酷睿Ultra处理器,打造机器人“芯”动脉

边缘AI与具身智能技术的飞速发展,正推动机器人市场迎来新的高潮。从工厂里的机械臂到协作机器人、从自主移动机器人(AMR)以及人形机器人,更多创新应用正在走进真实的生活场景。基于Intel 18A制程的英特尔酷睿Ultra处理器(第三代),将实现AI处理和边缘特定功能的突破性改进,实现更快的AI推理速度、更精准的控制能力以及工业级的可靠性,完美响应严苛的边缘计算和物理AI的需求。其核心亮点包括:

- 强大AI算力:集成近180 TOPS的强大AI算力,同时显著提升计算与图形处理性能。

- 卓越环境适应性:具备卓越的工业级耐用性和灵活性,能够从容应对工厂车间、户外交通、物流分拣及各类具身智能应用等严苛复杂的环境挑战。

- XPU架构创新:采用混合CPU架构,融合强大的CPU核心、增强型GPU和先进的集成NPU,使得AI计算能力相较前代提升高达1.8倍。1

- 实时性能保障:原生支持英特尔时序协调运算(TCC)和时间敏感网络(TSN),为机器人等关键任务提供超低延迟的实时AI支持。

同时,为进一步加速物理AI解决方案的早期开发,英特尔推出了全新的机器人AI软件套件和机器人参考主板。这些工具基于英特尔在机器人控制解决方案方面的深厚积累,可以帮助客户快速创新、降低开发门槛,打造更具成本效益的机器人。该软件套件不仅支持开放标准(如ROS 2)、VLA模型和先进视觉算法,还允许在单个CPU上同时支持控制器和AI功能,从而进一步优化TCO。

以持续的产品创新,携手推动边缘AI普及

此外,英特尔通过广泛而开放的边缘生态系统,为上下游企业提供全方位便利,加速产品上市进程,共同推动边缘AI的普及。其中的重要举措如下:

- 面向OEM和ODM: 提供AI边缘系统,助力交付AI就绪的解决方案,并已合作认证了40+边缘AI系统。

- 面向ISV、系统集成商和解决方案开发商: 提供边缘AI套件,包含参考应用、示例代码和基准测试,加速AI应用开发和规模化。

- 面向OSV、ISV和系统集成商: 提供开放边缘软件,包含工具包、AI库和英特尔最新的软硬件性能优化,并通过GitHub社区分享代码,助力开发者充分利用硬件优势。

通过协同整个价值链的紧密协同,英特尔致力于加速AI在边缘的发展速度,与生态伙伴共同塑造一个更加智能、高效和互联的未来,创造更多价值。

好文章,需要你的鼓励

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

企业谈AI基础设施时,注意力往往首先集中在模型、GPU和算力集群上。但当大模型应用走向规模化推理,一个瓶颈开始浮现:算力采购完成,并不意味着Token能够被稳定、低成本、可控地交付出去。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

米拉·穆拉提重返公众视野,谨慎发声

穆拉蒂时隔18个月首次接受重大媒体采访,介绍其创立的Thinking Machines Lab正在开发的"交互模型"。该模型能以200毫秒间隔处理音频、文本和视频流,捕捉人类交流中的中断、修正和停顿。她还谈及OpenAI"政变周"经历,强调行业决策权过于集中的担忧,并回应了公司近期研究人员离职问题,表示这是初创实验室的正常波动。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

Meta智能眼镜被曝含"人脸识别"追踪代码,隐私风险引发警示

Gemini企业智能体平台的智能体RAG如何实现可靠响应

麻省理工学院AI与计算研讨会:技术进步中不可或缺的人文因素

亚马逊全新数据中心路由架构降低AWS网络能耗40%

iOS 27即将发布,多款iPhone应用将迎来全新设计升级

连接性已成为与计算和存储同等重要的AI基础设施核心要素

开发者仍在等待Meta最新AI模型的API访问权限

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

米拉·穆拉提重返公众视野,谨慎发声

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议