千问APP接入Qwen-Image新模型,一句话换视角、打光、精准改图

12月2日,阿里巴巴发布了图片生成及编辑模型Qwen-Image的重磅更新。新模型在图像编辑中维持了更高的一致性,并在多视角转换、多图像融合、多模态推理等方面取得突破进展,可广泛用于概念创意、工业设计、日常修图等诸多场景。目前,新版本Qwen-Image已首发接入千问APP,用户可无限次免费使用。

Qwen-Image-Edit 基于20B的 Qwen-Image 模型进一步训练,相较于上个版本,新的Qwen-Image-Edit模型还进行多项关键性能增强:在图片编辑中,新模型大幅减轻了主体偏移问题,生图不模糊、更稳定;同时提升了主体一致性,使得多张图片中的人物可顺畅融合为一张合照。Qwen-Image-Edit新模型在工业设计场景着重进行了优化,轻松实现变颜色、变视角、局部修改、材质替换等常用功能;新模型的推理能力也有大幅提升,特别是在几何推理方面,可直接在几何图上生成新的辅助线等效果。

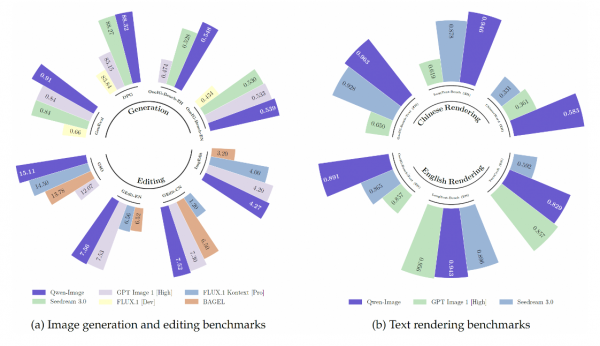

此前,Qwen-Image基础版在用于通用图像生成的GenEval、DPG和OneIG-Bench,以及用于图像编辑的GEdit、ImgEdit和GSO等多个基准测试中均取得了最先进的性能,展现出其在图像生成与图像编辑方面的强大能力。此外,在用于文本渲染的LongText-Bench、ChineseWord和TextCraft上的结果表明,Qwen-Image在文本渲染方面表现尤为出色。

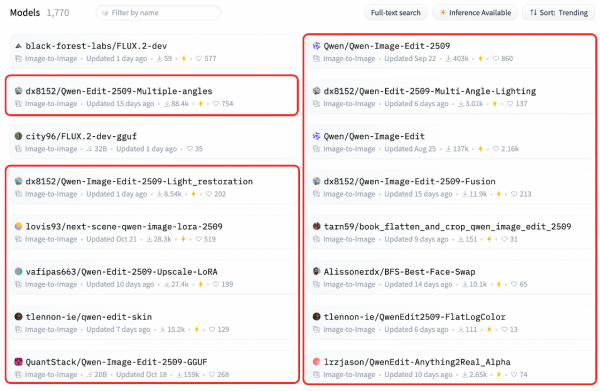

Qwen-Image系列模型自开源发布以来,即刻成为全球AI社区最火热的开源视觉基础模型,当前总下载量已突破300万次。在全球最大的AI开源社区HuggingFace的“图生图”榜单前15中,有13个都是Qwen-Image的原生或衍生模型,网友们纷纷基于Qwen-Image魔改出各种新版本等,比如镜头控制lora效果,可实现图片的多角度重新编辑,目前仍高居HuggingFace的演示空间(Space)榜单第一。如今,开源社区的优秀创意也已吸纳到新改版的Qwen-Image-Edit模型中,基模上就可实现打光、换视角等特色效果。

Qwen-Image衍生模型霸榜开源社区

目前,Qwen-Image-Edit最新模型已经在千问App全面上线,普通用户也可免费使用这一新模型。用户只需在千问APP对话界面输入指令,即可自动调用Qwen-Image系列模型的强大能力,实现生图、修图、多图融合等操作。例如,输入“生成图1和图2的人物合照”,模型能高效、精准地生成符合语义的图像,效果直观且富有创意。

此外,结合千问App上接入的万相Wan2.5视频生成能力,用户还可实现生图、生视频的无缝串联:先生成人物图像,再一键实现“一张照片就跳舞”或“对口型唱歌”等功能,瞬间将静态画面转化为动态视频,真正实现从图像生成到创意表达的全新创作方法。

好文章,需要你的鼓励

Replit携手RevenueCat,助力“氛围编程“开发者实现应用变现

Replit与RevenueCat达成合作,将订阅变现工具直接集成至Replit平台。用户只需通过自然语言提示(如"添加订阅"),即可完成应用内购和订阅配置,无需离开平台。RevenueCat管理超8万款应用的订阅业务,每月处理约10亿美元交易。此次合作旨在让"氛围编程"用户在构建应用的同时即可实现商业变现,月收入未达2500美元前免费使用,超出后收取1%费用。

北京大学携手北邮,教AI“感知光线“——让生成视频真正懂得光影的秘密

LiVER是由北京大学、北京邮电大学等机构联合提出的视频生成框架,核心创新是将物理渲染技术与AI视频生成结合,通过Blender引擎计算漫反射、粗糙GGX和光泽GGX三种光照图像构成"场景代理",引导视频扩散模型生成光影物理准确的视频。框架包含渲染器智能体、轻量化编码器适配器和三阶段训练策略,支持对光照、场景布局和摄像机轨迹的独立精确控制。配套构建的LiVERSet数据集含约11000段标注视频,实验显示该方法在视频质量和控制精度上均优于现有方法。

所有人都在谈AI护栏,但真正在构建它的人在哪里?

所有人都说AI需要护栏,但真正在构建它的人寥寥无几。SkipLabs创始人Julien Verlaguet深耕这一问题已逾一年,他发现市面上多数"护栏"不过是提示词包装。为此,他打造了专为后端服务设计的AI编程智能体Skipper,基于健全的TypeScript类型系统与响应式运行时,实现增量式代码生成与测试,内部基准测试通过率超90%。他认为,编程语言的"人类可读性时代"正走向终结,面向智能体的精确工具链才是未来。

米拉-魁北克AI研究所教会小模型“聪明干活“:用更少数据超越GPT-4o的网页智能体训练秘诀

这项由蒙特利尔学习算法研究所(Mila)与麦吉尔大学联合发布的研究(arXiv:2604.07776,2026年4月)提出了AGENT-AS-ANNOTATORS框架,通过模仿人类数据标注的三种角色分工,系统化生成高质量网页智能体训练轨迹。以Gemini 3 Pro为教师模型,仅用2322条精选轨迹对90亿参数的Qwen3.5-9B模型进行监督微调,在WebArena基准上达到41.5%成功率,超越GPT-4o和Claude 3.5 Sonnet,并在从未见过的企业平台WorkArena L1上提升18.2个百分点,验证了"数据质量远比数量重要"这一核心结论。

Replit携手RevenueCat,助力"氛围编程"开发者实现应用变现

所有人都在谈AI护栏,但真正在构建它的人在哪里?

Chrome版Gemini新增"技能"功能,支持保存并复用常用AI提示词

OpenAI推出药物研发专属AI模型GPT-Rosalind

NanoClaw携手Vercel,为AI智能体敏感操作打造一键审批机制

SaySo:专为重建新闻信任而生的短视频应用

Loop完成9500万美元C轮融资,用AI预测并化解供应链风险

使用MacBook Neo一个月后,我发现了它的性能极限

服务器机房的门锁形同虚设,安全认证险些露馅

Isabelle/HOL:驱动Nitro隔离引擎背后的形式化证明工具

鹏鼎控股泰国建厂:全球PCB龙头如何用42.97亿元押注AI服务器

Agent赋能保险理赔:从“人工苦海”到“智能闭环”